Robust Graph Representation Learning via Neural Sparsification

概

自动稀疏化图的, 思想很简单, 就是学一个概率分布然后用 Gumbel-softmax 采样.

符号说明

- 个结点的图;

- , 图;

- , 每一行是对应结点的特征;

- , 邻接矩阵, 若存在边 ;

- , 表示边 所对应的边的特征.

NeuralSparse

-

图上的任务可以归结为估计概率分布:

如果是 node-level 的分类任务, 则 , 若是 graph-level 的分类任务, 则 .

-

作者认为:

即, 稀疏化后的 graph 包含了大部分预测 所需的信息.

-

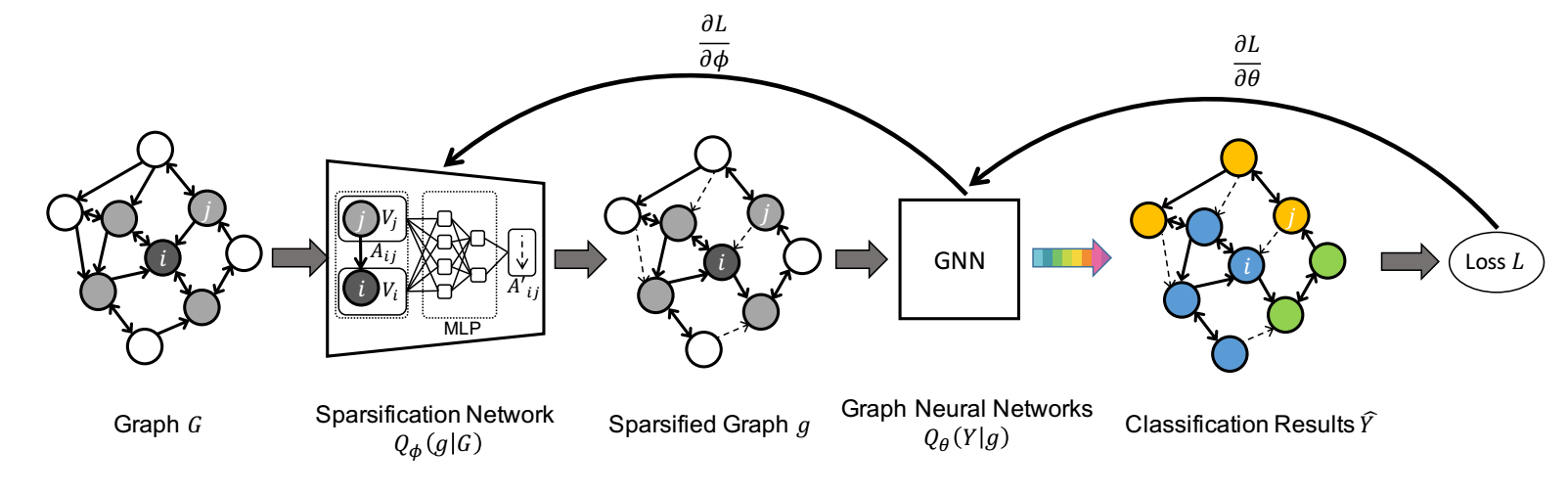

作者的想法很简单, 就是用:

实际上是一个稀疏化网络, 实际上是在空间 上的一个分类网络.

-

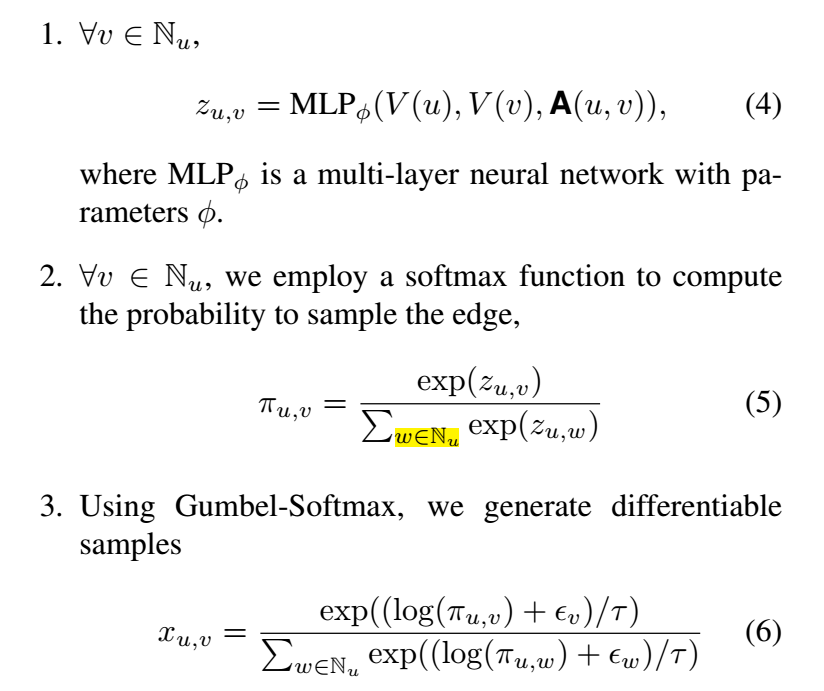

针对稀疏化, 作者首先选择了一个非常简单的 , 作者假设稀疏化后的图每个结点只有 个邻居, 整体的稀疏化过程如下:

-

即, 通过一个简单的 MLP 来预测出边 的 logit, 然后通过 gumbel-softmax 进行采样.

-

就是一般的图网络.

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· 没有Manus邀请码?试试免邀请码的MGX或者开源的OpenManus吧

· 园子的第一款AI主题卫衣上架——"HELLO! HOW CAN I ASSIST YOU TODAY

· 【自荐】一款简洁、开源的在线白板工具 Drawnix

2022-10-18 Interpreting and Unifying Graph Neural Networks with An Optimization Framework

2019-10-18 On the Optimization of Deep Networks: Implicit Acceleration by Overparameterization