Root Mean Square Layer Normalization

Zhang B. and Sennrich R. Root mean square layer normalization. NIPS, 2019.

概

RMSNorm 节省时间.

RMSNorm

-

假设输入为 , 然后

其中 是 element-wise 的激活函数.

-

LayerNorm 采取的是如下的方式 (注意, 下面的 是 element-wise 的):

其中

-

RMSNorm 采用的是如下的方式:

其中

-

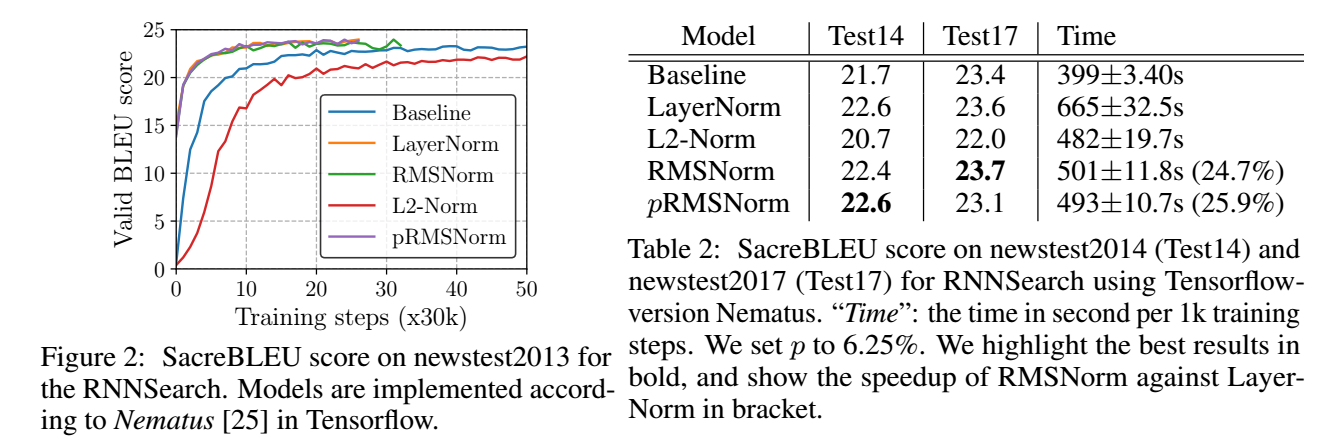

由于不用计算均值, RMSNorm 所需的计算时间会少一点, 但是效果是差不多的:

-

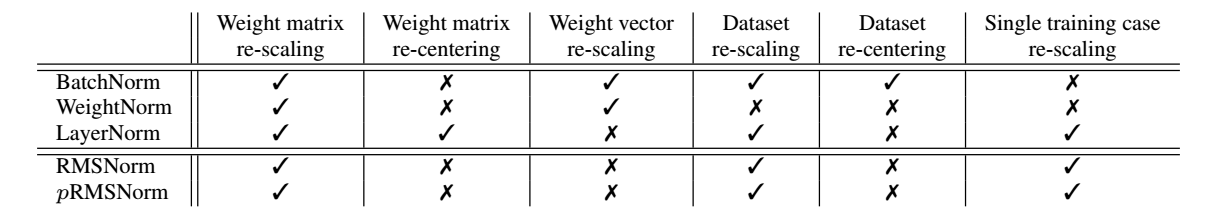

此外, RMSNorm 保留了一些重要的不变性:

代码

[official]

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· TypeScript + Deepseek 打造卜卦网站:技术与玄学的结合

· Manus的开源复刻OpenManus初探

· AI 智能体引爆开源社区「GitHub 热点速览」

· 三行代码完成国际化适配,妙~啊~

· .NET Core 中如何实现缓存的预热?

2022-07-24 Commute Time Distance

2022-07-24 HOP-Rec: High-Order Proximity for Implicit Recommendation