Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

概

Chain of Thought (CoT).

CoT

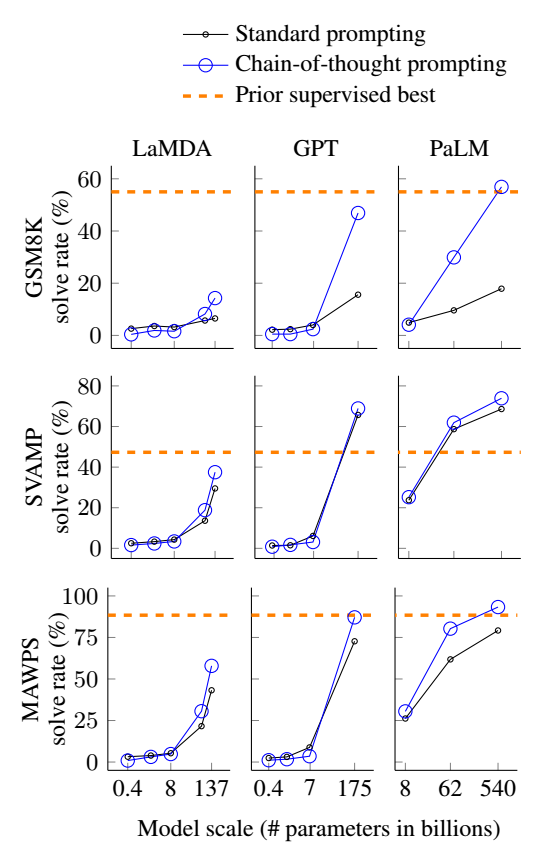

- 标准的 Prompt 如上左图所示, 而 CoT 则如右图所示. 不同之处在于, CoT 会给出一个 step by step 推理的例子, 这有助于激发模型的潜能 (当然, 前提是模型确实有这方面的潜能, CoT 比标准的 prompt 效果好通常要求模型规模 > 10B).

- 这篇文章 here 给了一个理论解释, 即为什么涉及到推理的问题是非常依赖 CoT 来分解问题并逐步回答的.

浙公网安备 33010602011771号

浙公网安备 33010602011771号