Sparse Principal Component Analysis

目录

背景:

sparse PCA 较 PCA来说更具可解释性,泛化性。

部分符号

假设样本已经中心化(每一个行为一个样本)

为主成分(PCs)

创新点

1.将PCA问题转化为一个回归问题,利用最小角回归,可以高效求解Lasso问题。

2.二重迭代求解,sparse PCA问题。

文章梗概

The LASSO AND THE ELASTIC NET

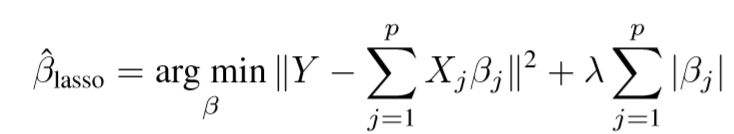

普通的Lasso

这个方法的问题在于,当的时候,最多有n个非零项(这是为什么呢?)

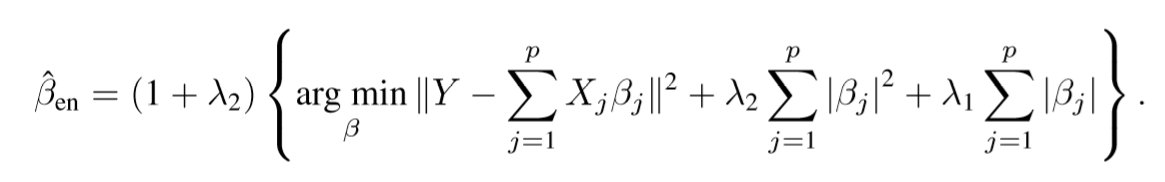

The elastic net

将PCA改造为回归问题

定理一 考虑单个向量(需要先进行SVD)

定理二 单个向量(无需进行SVD版本)

定理三 多个向量(无需进行SVD, 非LASSO,非elastic net)

目标函数(最终版)

俩步求解

定理四 A given B的理论支撑(存疑)

算法一

方差计算

因为稀疏化后的向量,既不具有空间上(往往)的正交性,也不具有概率上()的正交性。这里,Zou 考虑的是概率上的正交性,将得到的向量正交化,把余量相加得最后的方差。

复杂度

: #m是迭代次数

算法改进

简单来说,就是把step2改进下,原来需要求解一个elastic net问题,现在直接进行截断,自然会减轻不少负担。

数值实验(pitprops)

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 开发者必知的日志记录最佳实践

· SQL Server 2025 AI相关能力初探

· Linux系列:如何用 C#调用 C方法造成内存泄露

· AI与.NET技术实操系列(二):开始使用ML.NET

· 记一次.NET内存居高不下排查解决与启示

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· 没有Manus邀请码?试试免邀请码的MGX或者开源的OpenManus吧

· 园子的第一款AI主题卫衣上架——"HELLO! HOW CAN I ASSIST YOU TODAY

· 【自荐】一款简洁、开源的在线白板工具 Drawnix