zero-shot、one-shot、few-shot

总结对比

zero-shot是一种机器学习方法,指的是模型能够处理从未在训练数据中见过的任务或类别,即模型在面对新任务时不需要额外的训练和微调也能做出合理的决策。

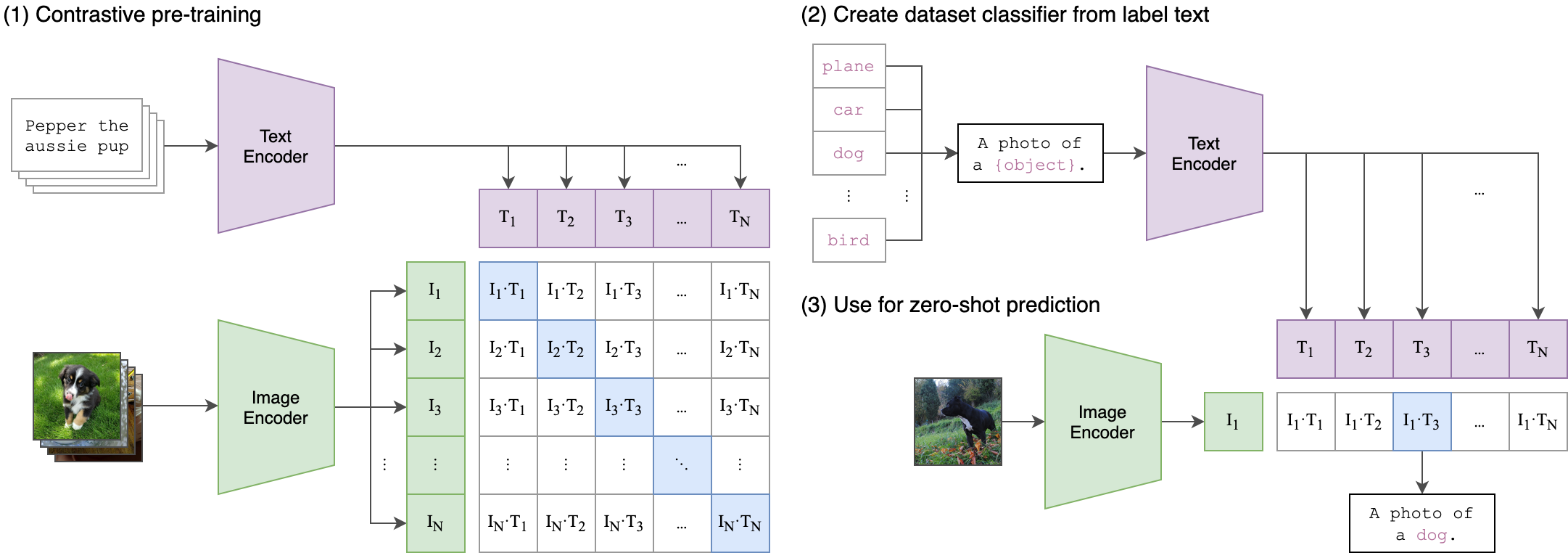

以视觉场景为例,如CLIP(Contrastive Language-Image Pre-Training),它将图像和文本嵌入到同一个语义空间中,使得模型能够理解并关联图像和文本之间的关系。

在训练过程中,CLIP使用了大量的图像文本对进行学习,通过对比损失(contrastive loss)来使相匹配的图像和文本对在向量空间中更接近,不匹配的图像和文本对更远离。

在推理过程中,CLIP的操作为”多项选择题“,会给出一系列的prompt(提示词)去和当前的图像进行匹配,摆脱了传统分类网络需要修改网络结构擦能实现其他类别分类的问题。

也就是说对于视觉任务,通常需要依赖文本描述来实现zero-shot,单纯的掩膜不足以支持zero-shot。

浙公网安备 33010602011771号

浙公网安备 33010602011771号