人脸生成:Beyond Face Rotation: Global and Local Perception GAN

Beyond Face Rotation: Global and Local Perception GAN for Photorealistic and Identity Preserving Frontal View Synthesis

Motivation

基于单幅人脸图像的真实感正视图合成在人脸识别领域有着广泛的应用,主要方法有两种:

- 提取不变的特征进行映射

- 从大姿态人脸进行恢复(拟合3D模型然后投影回2D正脸、深度学习的数据驱动方法)

这些方法存在的问题:

- 第一种方法受特征一致性与可分辨性的约束,对于大姿态的旋转处理不好

- 深度学习方法输出图片细节不好,容易模糊

Contribution

-

提出双路径生成对抗网络(TP-GAN),可同时感知全局结构和局部细节。

-

增加约束,引入对抗性损失、对称性损失和身份保持损失的组合。

-

输出不是中间特征,而是保留身份的合成图像。可进行人脸识别和属性估计等后续任务。

Approach

双路径生成对抗网络(TP-GAN)

- 局部网络聚焦人脸各个属性细节,逐一生成然后进行Fusion

- 全局网络注重全局结构

设计原因是作者认为单一生成器不能既学习全局结构,又能很好地学习到细节部分,因为这两个任务对于生成器来说权重共享,实际上是不能兼顾平衡的。

多约束损失

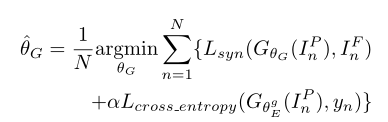

生成器的损失为交叉熵+综合损失,

I

n

P

I_n^P

InP与

I

n

F

I_n^F

InF是统一身份的侧正面图像对,

y

n

y_n

yn为

I

n

P

I_n^P

InP的真实的身份

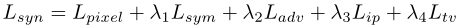

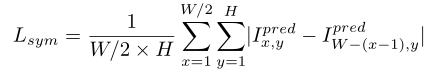

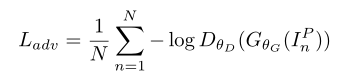

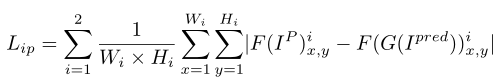

综合损失:

具体的:

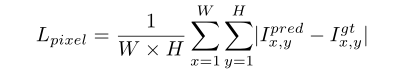

- Pixel-wise Loss

L1距离像素损失,用于身份保持

- Symmetry Loss

这里利用了生成人脸的先验知识,生成的人脸应该对称

- Adversarial Loss

保持图片真实性,尽量使鉴别器无法鉴别生成的图片

- Identity Preserving Loss

在Pixel-wise Loss上进一步加强个人身份特征,保持图片身份肉眼感知的一致,用的是基于Light CNN的感知损失,只用了最后两层

最后的网络结构

Experiments

分为四个部分,进行定性,定量比较

-

人脸合成效果

直观与SOTA方法比较,并特别说明了大视角恢复的性能 -

身份保留效果

将合成的人脸用于身份匹配与性别分类 -

特征提取效果

说明生成图片特征区分良好 -

算法效果

这部分为消融实验,说明算法各部分的贡献

Discussion

个人总结本文的主要贡献在于:

- 全局和局部思想的考量,并应用在了生成器而不是鉴别器上

- 考虑了人脸的先验知识,引入对称损失

References

Huang, R., Zhang, S., Li, T., & He, R. (2017). Beyond face rotation: Global and local perception GAN for photorealistic and identity preserving frontal view synthesis. ArXiv, 2439–2448.

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 单元测试从入门到精通

· 上周热点回顾(3.3-3.9)

· winform 绘制太阳,地球,月球 运作规律