Spark RDD算子之关联操作 -- join、fullOuterJoin、leftOuterJoin、rightOuterJoin、subtractByKey

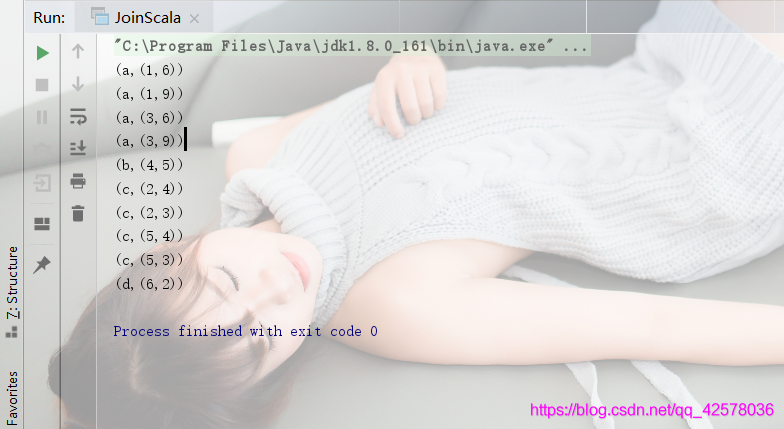

join

函数定义

def join[W](other: RDD[(K, W)]): RDD[(K, (V, W))]

def join[W](other: RDD[(K, W)], numPartitions: Int): RDD[(K, (V, W))]

def join[W](other: RDD[(K, W)], partitioner: Partitioner): RDD[(K, (V, W))]

可以把RDD1,RDD2中的相同的 key 给连接起来,类似于 sql 中的 join 操作;若有多个相同的 key 则连接多次,仔细查看比较运行结果

Scala版本

val conf = new SparkConf().setAppName("JoinScala").setMaster("local[*]") val sc = new SparkContext(conf) val rdd1 = sc.parallelize(List(("a",1),("c",2),("a",3),("b",4),("c",5),("d",6))) val rdd2 = sc.parallelize(List(("b",5),("c",4),("a",6),("a",9),("c",3),("d",2))) val join = rdd1.join(rdd2) join.collect.foreach(println)

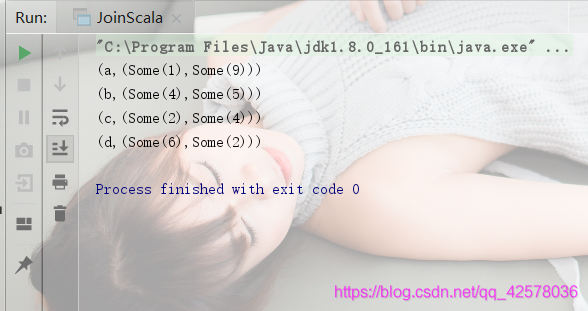

fullOuterJoin

Scala版本

val conf = new SparkConf().setAppName("fullOuterJoin").setMaster("local[*]") val sc = new SparkContext(conf) val rdd1 = sc.parallelize(List(("a",1),("c",2),("b",4),("d",6))) val rdd2 = sc.parallelize(List(("b",5),("c",4),("a",9),("d",2))) val fullOut = rdd1.fullOuterJoin(rdd2) fullOut.collect.foreach(println)

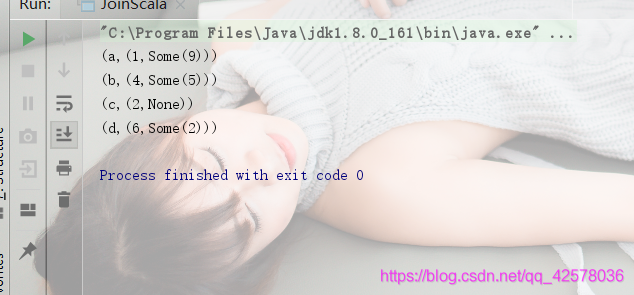

leftOuterJoin

对两个 RDD 进行连接操作,类似于sql中的左外连接,仔细查看比较运行结果

Scala版本

val conf = new SparkConf().setAppName("leftOuterJoin").setMaster("local[*]") val sc = new SparkContext(conf) val rdd1 = sc.parallelize(List(("a",1),("c",2),("b",4),("d",6))) val rdd2 = sc.parallelize(List(("b",5),("a",9),("d",2))) val left = rdd1.leftOuterJoin(rdd2) left.collect.foreach(println)

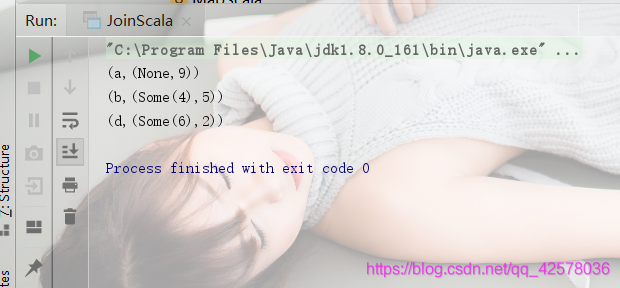

rightOuterJoin

对两个 RDD 进行连接操作,类似于sql中的右外连接,存在的话,value用的Some, 不存在用的None,仔细查看比较运行结果

Scala版本

val conf = new SparkConf().setAppName("rightOuterJoin").setMaster("local[*]") val sc = new SparkContext(conf) val rdd1 = sc.parallelize(List(("c",2),("b",4),("d",6))) val rdd2 = sc.parallelize(List(("b",5),("a",9),("d",2))) val right = rdd1.rightOuterJoin(rdd2) right.collect.foreach(println)

subtractByKey

类似于 subtrac,删掉 RDD1 中键与 RDD2 中的键相同的元素,仔细查看比较运行结果

Scala版本

val conf = new SparkConf().setAppName("subtractByKey").setMaster("local[*]") val sc = new SparkContext(conf) val rdd1 = sc.parallelize(List(("a",6),("c",2),("b",4),("d",6))) val rdd2 = sc.parallelize(List(("b",5),("a",9),("d",2))) val sub = rdd1.subtractByKey(rdd2) sub.collect.foreach(println)

故乡明

浙公网安备 33010602011771号

浙公网安备 33010602011771号