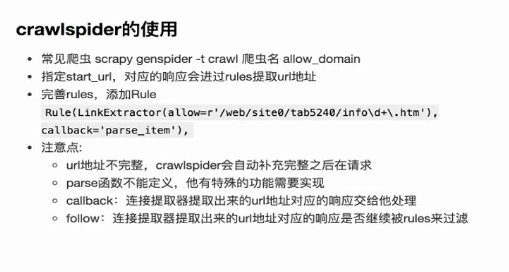

crawlspider的使用

CrawlSpider继承于Spider类,除了继承过来的属性外(name、allow_domains),还提供了新的属性和方法:

rules

在rules中包含一个或多个Rule对象,每个Rule对爬取网站的动作定义了特定操作。如果多个rule匹配了相同的链接,则根据规则在本集合中被定义的顺序,第一个会被使用。

-

link_extractor:是一个Link Extractor对象,用于定义需要提取的链接。 -

callback: 从link_extractor中每获取到链接时,参数所指定的值作为回调函数,该回调函数接受一个response作为其第一个参数。注意:当编写爬虫规则时,避免使用parse作为回调函数。由于CrawlSpider使用parse方法来实现其逻辑,如果覆盖了 parse方法,crawl spider将会运行失败。

-

follow:是一个布尔(boolean)值,指定了根据该规则从response提取的链接是否需要跟进。 如果callback为None,follow 默认设置为True ,否则默认为False。 -

process_links:指定该spider中哪个的函数将会被调用,从link_extractor中获取到链接列表时将会调用该函数。该方法主要用来过滤。 -

process_request:指定该spider中哪个的函数将会被调用, 该规则提取到每个request时都会调用该函数。 (用来过滤request)

Link Extractors 的目的很简单: 提取链接。

每个LinkExtractor有唯一的公共方法是 extract_links(),它接收一个 Response 对象,并返回一个 scrapy.link.Link 对象。

Link Extractors要实例化一次,并且 extract_links 方法会根据不同的 response 调用多次提取链接。

主要参数:

-

allow:满足括号中“正则表达式”的值会被提取,如果为空,则全部匹配。 -

deny:与这个正则表达式(或正则表达式列表)不匹配的URL一定不提取。 -

allow_domains:会被提取的链接的domains。 -

deny_domains:一定不会被提取链接的domains。 -

restrict_xpaths:使用xpath表达式,和allow共同作用过滤链接。

一个小例子:

1 # -*- coding: utf-8 -*- 2 import scrapy 3 from scrapy.linkextractors import LinkExtractor 4 from scrapy.spiders import CrawlSpider, Rule 5 import re 6 7 class CfSpider(CrawlSpider): 8 name = 'cf' 9 allowed_domains = ['circ.gov.cn'] 10 start_urls = ['http://bxjg.circ.gov.cn/web/site0/tab5240/module14430/page1.htm'] 11 12 #定义提取url地址规则 13 rules = ( 14 #LinkExtractor 链接提取器,提取url地址 15 #callback 提取出来的url地址的response会交给callback处理 16 #follow 表示当前url地址的响应是否重新经过Rules来提取url地址 17 Rule(LinkExtractor(allow=r'/web/site0/tab5240/info\d+\.htm'), callback='parse_item'), 18 Rule(LinkExtractor(allow=r'/web/site0/tab5240/module14430/page\d+\.htm'),follow=True), 19 20 ) 21 22 def parse_item(self, response): 23 item = {} 24 item['title'] = re.findall("<!--TitleStart-->(.*?)<!--TitleEnd-->",response.body.decode())[0] 25 item['publish_date'] = re.findall("发布时间:(20\d{2}-\d{2}-\d{2})",response.body.decode())[0] 26 print(item)

浙公网安备 33010602011771号

浙公网安备 33010602011771号