尚硅谷Nginx学习笔记(二)

六、Nginx配置实例(反向代理准备工作)

1、实现效果

打开浏览器,在浏览器地址栏输入地址 www.my123.com,跳转到Linux系统 tomcat主页面中

2、准备工作

(1)在 Linux系统安装 tomcat,使用默认端口 8080

-

tomcat 安装文件放到 Linux系统中,解压

-

进入 tomcat 的 bin 目录中,./startup.sh 启动 tomcat 服务器

(2)对外开放访问的端口

firewall-cmd --add-port=8080/tcp --permanent

firewall-cmd –reload

查看已经开放的端口号

firewall-cmd --list-all

(3)在 windows 系统中通过浏览器访问 tomcat 服务器

3、访问过程的分析

4、具体配置

①、第一步 在 windows 系统的 host 文件进行域名和 ip 对应关系的配置

添加内容在 host 文件中

②、第二步 在 nginx 进行请求转发的配置(反向代理配置)

配置文件

5、最终测试

七、Nginx配置实例(反向代理实例二)

1、实现效果

使用Nginx反向代理,根据访问的路径跳转到不同端口的服务中

Nginx监听端口为 9001,

访问 http://127.0.0.1/edu/,直接跳转到 127.0.0.1:8081

访问 http://127.0.0.1/vod/,直接跳转到 127.0.0.1:8082

教程与测试效果不一样,两个都试一下

2、准备工作

准备两个Tomcat 服务器,一个 8080 端口,一个 8081 端口Windows上同时运行两个Tomcat(记得在server.xml修改端口号)

分别为两个Tomcat服务器创建简单文件夹和简单页面。

①、在webapps路径下创建edu文件夹

②、在edu路径下创建简单页面

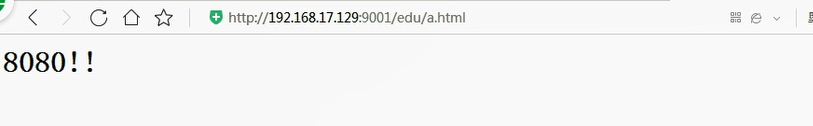

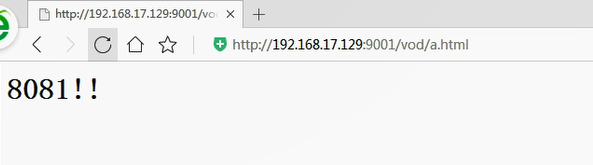

③、简单测试

④、另外一个服务器的页面

3、具体配置

①、找到Nginx配置文件,进行反向代理配置

②、开放对外访问的端口号9001 8080 8081

参考前面的做法

4、最终测试

5、location 指令说明

该指令用于匹配 URL,语法如下:

location [ = | ~ | ~* | ^~ ] uri {

}

= :用于不含正则表达式的 uri 前,要求请求字符串与 uri 严格匹配,如果匹配成功,就停止继续向下搜索并立即处理该请求。

~:用于表示 uri 包含正则表达式,并且区分大小写。

~*:用于表示 uri 包含正则表达式,并且不区分大小写。

^~:用于不含正则表达式的 uri 前,要求 Nginx 服务器找到标识 uri 和请求字符串匹配度最高的 location 后,立即使用此 location 处理请求,而不再使用 location块中的正则 uri 和请求字符串做匹配。

注意:如果uri包含正则表达式,则必须要有 ~ 或者 ~* 标识。

八、Nginx配置实例(负载均衡)

1、实现效果

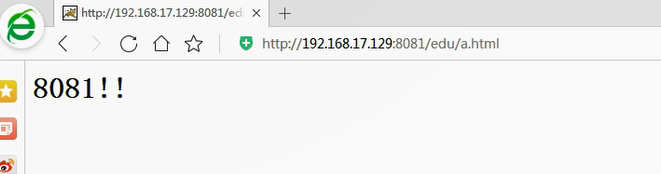

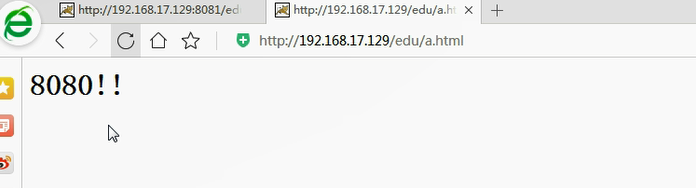

浏览器地址栏输入地址http://192.168.17.129/edu/a.html,负载均衡效果,平均 8081和 8082 端口中。

2、准备工作

准备两台 tomcat 服务器,一台 8080,一台 8081。

在两台 tomcat 里面 webapps 目录中,创建名称是 edu文件夹,在edu文件夹中创建a.html页面,用于测试。

3、修改配置文件

在 Nginx 的配置文件中进行负载均衡的配置

# 负载用到的配置

upstream myserver{

server 192.168.17.129:8080;

server 192.168.17.129:8081;

}

server {

listen 80;

server_name 192.168.17.129;

#charset koi8-r;

#access_log logs/host.access.log main;

location / {

# 负责用到的配置

proxy_pass http://myserver;

root html;

index index.html index.htm;

}

}

4、最终测试:

重启Nginx,输入192.168.17.129/edu/a.html,刷新几次,看看页面效果

5、负载均衡分配策略

负载均衡(load balance)即是将负载分摊到不同的服务单元,既保证服务的可用性,又保证响应足够快,给用户很好的体验。

快速增长的访问量和数据流量催生了各式各样的负载均衡产品,很多专业的负载均衡硬件提供了很好的功能,但却价格不菲,这使得负载均衡软件大受欢迎,nginx 就是其中的一个,在 linux 下有 Nginx、 LVS、 Haproxy 等等服务可以提供负载均衡服务,而且 Nginx 提供了几种分配方式(策略)

①、轮询

这是Ngnix负载均衡默认分配策略。每个请求按时间顺序逐一分配到不同的后端服务器,如果后端服务器 down 掉,能自动剔除。

②、加权

weight 代表权重,默认为 1,权重越高被分配的客户端越多。指定轮询几率,weight和访问比率成正比,用于后端服务器性能不均的情况。例如:

upstream myserver{

server 127.0.0.1:8081 weight=8;

server 127.0.0.1:8082 weight=2;

}

③、ip_hash

每个请求按访问 ip 的 hash 结果分配,这样每个访客固定访问一个后端服务器,可以解决 session 的问题。 例如:

upstream myserver{

ip_hash;

server 127.0.0.1:8081;

server 127.0.0.1:8082;

}

④、fair(第三方)

这是Ngnix负载均衡第三方分配策略。按后端服务器的响应时间来分配请求,响应时间短的优先分配。

upstream myserver{

server 127.0.0.1:8081;

server 127.0.0.1:8082;

fair;

}

九、Nginx配置实例(动静分离准备工作)

1、什么是动静分离

Nginx 动静分离简单来说就是把动态跟静态请求分开,不能理解成只是单纯的把动态页面和静态页面物理分离。严格意义上说应该是动态请求跟静态请求分开,可以理解成使用 Nginx 处理静态页面, Tomcat 处理动态页面。动静分离从目前实现角度来讲大致分为两种:

一种是纯粹把静态文件独立成单独的域名,放在独立的服务器上,也是目前主流推崇的方案;

另外一种方法就是动态跟静态文件混合在一起发布,通过 nginx 来分开。

通过 location 指定不同的后缀名实现不同的请求转发。通过 expires 参数设置,可以使浏览器缓存过期时间,减少与服务器之前的请求和流量。具体 Expires 定义:是给一个资源设定一个过期时间,也就是说无需去服务端验证,直接通过浏览器自身确认是否过期即可,所以不会产生额外的流量。此种方法非常适合不经常变动的资源。(如果经常更新的文件,不建议使用 Expires 来缓存)

若将其设置 3d,表示在这 3 天之内访问这个 URL,发送一个请求,比对服务器该文件最后更新时间没有变化,则不会从服务器抓取,返回状态码304,如果有修改,则直接从服务器重新下载,返回状态码 200。

2、准备工作

在Linux系统中准备静态资源,用于进行访问

3、具体配置

在Nginx配置文件中进行配置

4、最终测试

①、浏览器中输入地址

http://192.168.17.129/image/01.jpg

因为配置autoindex on(列出当前文件的内容)

②、在浏览器地址栏输入地址

http://192.168.17.129/www/a.html

十、Nginx配置高可用的集群

为什么要配置nginx高可用?以防单一nginx挂了,另一个nginx能担当重任。

1、什么是Nginx高可用

需要两台 nginx 服务器

需要 keepalived

需要虚拟 ip

2、配置高可用的准备工作

需要两台服务器 192.168.17.129 和 192.168.17.131

在两台服务器安装 Nginx

在两台服务器安装 keepalived

3、在两台服务器安装 keepalived

使用 yum 命令进行安装yum install keepalived –y

安装之后,使用命令rpm -q -a keepalived查看是否安装成功

在 etc 里面生成目录 keepalived,有文件 keepalived.conf

4、完成高可用配置(主从配置)

修改/etc/keepalived/keepalivec.conf配置文件

①、主服务器

global_defs {

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 192.168.17.129

smtp_connect_timeout 30

router_id LVS_DEVEL

}

vrrp_script chk_http_port {

script "/usr/local/src/nginx_check.sh"

interval 2 #(检测脚本执行的间隔)

weight 2

}

vrrp_instance VI_1 {

state MASTER # 备份服务器上将 MASTER 改为 BACKUP

interface ens33 //网卡名称(用ifconfig命令查看)

virtual_router_id 51 # 主、备机的 virtual_router_id 必须相同

priority 100 # 主、备机取不同的优先级,主机值较大,备份机值较小

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.17.50 // VRRP H 虚拟地址

}

}

②、从服务器

global_defs {

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 192.168.17.129

smtp_connect_timeout 30

router_id LVS_DEVEL

}

vrrp_script chk_http_port {

script "/usr/local/src/nginx_check.sh"

interval 2 #(检测脚本执行的间隔)

weight 2

}

vrrp_instance VI_1 {

state BACKUP # 备份服务器上将 MASTER 改为 BACKUP

interface ens33 //网卡名称(用ifconfig命令查看)

virtual_router_id 51 # 主、备机的 virtual_router_id 必须相同

priority 90 # 主、备机取不同的优先级,主机值较大,备份机值较小

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.17.50 // VRRP H 虚拟地址

}

}

③、在/usr/local/src 添加检测脚本

主从服务器都一样的配置

#!/bin/bash

A=`ps -C nginx – no-header |wc -l`

if [ $A -eq 0 ];then

/usr/local/nginx/sbin/nginx

sleep 2

if [ `ps -C nginx --no-header |wc -l` -eq 0 ];then

killall keepalived

fi

fi

5、把两台服务器上 Nginx 和 keepalived 启动

启动 Nginx: ./nginx

启动 keepalived: systemctl start keepalived.service

6、最终测试

在浏览器地址栏输入 虚拟 ip 地址 192.168.17.50

把主服务器(192.168.17.129) Nginx 和 keepalived 停止,再输入 192.168.17.50

十一、nginx的原理解析

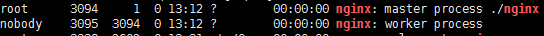

1、mater 和 worker

2、mater 和 worker两个进程

3、worker 如何进行工作的

4、master-workers 的机制的好处

首先,对于每个 worker 进程来说,独立的进程,不需要加锁,所以省掉了锁带来的开销,同时在编程以及问题查找时,也会方便很多。

其次,采用独立的进程,可以让互相之间不会影响,一个进程退出后,其它进程还在工作,服务不会中断, master 进程则很快启动新的worker进程。

当然, worker 进程的异常退出,肯定是程序有 bug 了,异常退出,会导致当前 worker 上的所有请求失败,不过不会影响到所有请求,所以降低了风险。

5、需要设置多少个 worker

Nginx 同 redis 类似都采用了 io 多路复用机制,每个 worker 都是一个独立的进程,但每个进程里只有一个主线程,通过异步非阻塞的方式来处理请求, 即使是千上万个请求也不在话下。每个 worker 的线程可以把一个 cpu 的性能发挥到极致。

所以 worker 数和服务器的cpu数相等是最为适宜的。设少了会浪费 cpu,设多了会造成 cpu 频繁切换上下文带来的损耗。

#设置 worker 数量。

worker_processes 4

#work 绑定 cpu(4 work 绑定 4cpu)。

worker_cpu_affinity 0001 0010 0100 1000

#work 绑定 cpu (4 work 绑定 8cpu 中的 4 个) 。

worker_cpu_affinity 0000001 00000010 00000100 00001000

6、连接数 worker_connection

本文来自博客园,作者:暗影月色程序猿,转载请注明原文链接:https://www.cnblogs.com/Geneling/p/15249067.html

浙公网安备 33010602011771号

浙公网安备 33010602011771号