中文词频统计

中文词频统计

1. 下载一长篇中文小说。

2. 从文件读取待分析文本。

3. 安装并使用jieba进行中文分词。

pip install jieba

import jieba

ljieba.lcut(text)

4. 更新词库,加入所分析对象的专业词汇。

jieba.add_word('天罡北斗阵') #逐个添加

jieba.load_userdict(word_dict) #词库文本文件

5. 生成词频统计

6. 排序

7. 排除语法型词汇,代词、冠词、连词

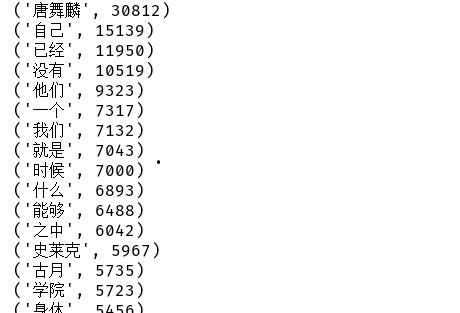

8. 输出词频最大TOP25,把结果存放到文件里

9. 生成词云。

代码:

import jieba import wheel import pip if __name__ == '__main__': #停用词表 stop = [line.strip() for line in open("stop.txt", 'r', encoding='utf-8').readlines()] #导入文章文本 fo = open('duo3.txt','r',encoding='utf-8') tk = fo.read() fo.close() #替换停用词 for s in stop: tk = tk.replace(s, "") #中文分词 wordlist = jieba.lcut(tk) print(tk) #导入词汇 jieba.load_userdict('duoluo.txt') #生成字典 wcdict = {} for word in wordlist: if len(word)==1: continue else: wcdict[word]= wcdict.get(word,0)+1 #排序 wcls = list(wcdict.items()) wcls.sort(key = lambda x:x[1],reverse=True) #输出前二十五词 for i in range(25): print(wcls[i]) wl_split=''.join(wordlist) #生成词云 from wordcloud import WordCloud import matplotlib.pyplot as plt mywc = WordCloud().generate(wl_split) plt.imshow(mywc) plt.axis("off") plt.show()

结果截图

词云生成:

浙公网安备 33010602011771号

浙公网安备 33010602011771号