《机器学习》第二次作业——第四章学习记录和心得

目录

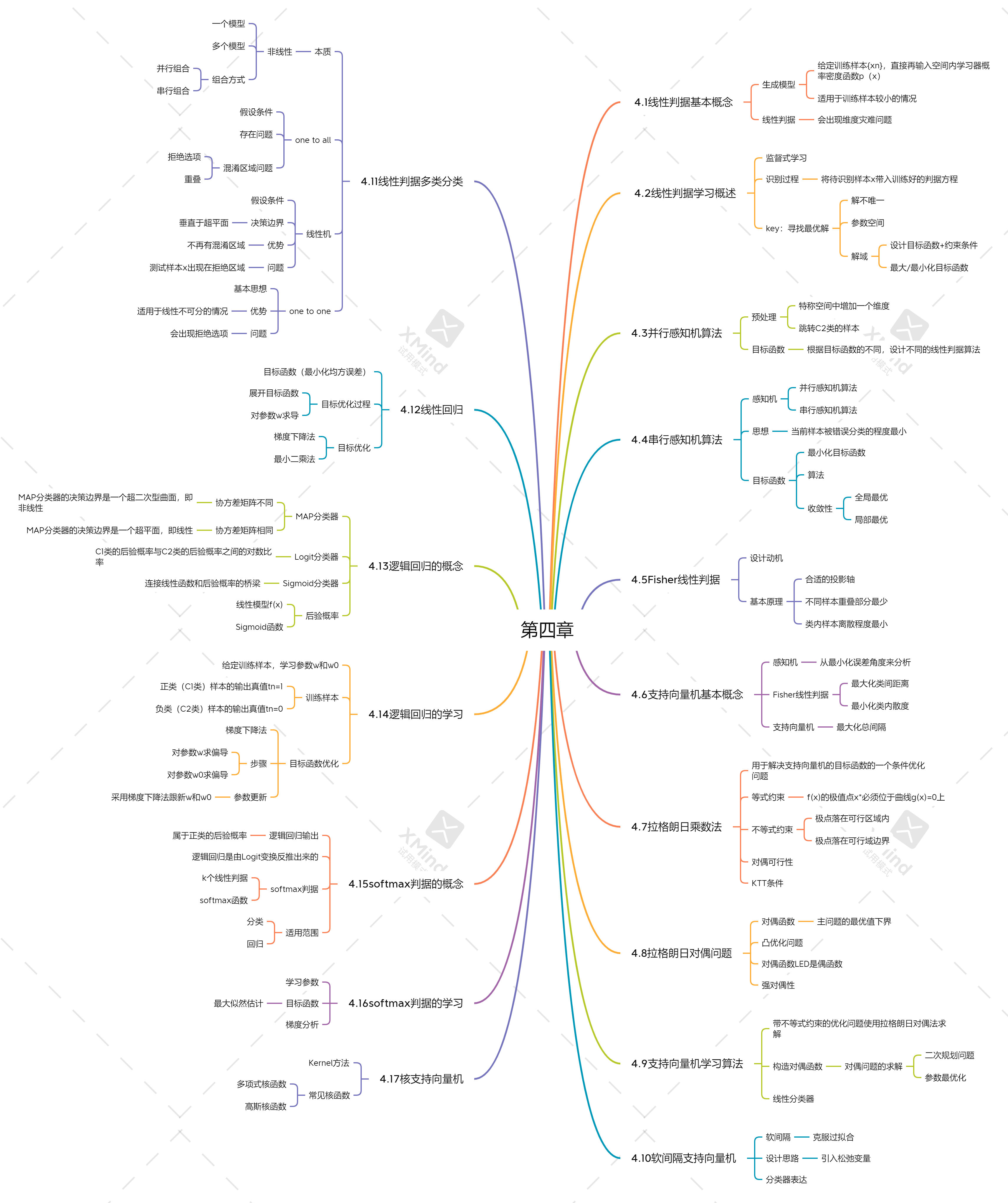

思维导图

第四章 线性判据与回归

4.1、 线性判据基本概念

定义

- 如果判别模型f(x)是线性函数,则f(x)为线性判据。

- 可以用于两类分类

- 也可以用于多类分类,相邻两类之间的决策边界也是线性的。

优势 - 计算量少:在学习和分类过程中,线性判据方法都比基于学习概率分布的方法计算量少。

- 适用于训练样本较少的情况。

劣势

-如果是高维的x,需要大量训练样本才能准确的估计p(x),否则,会出现维度灾难问题

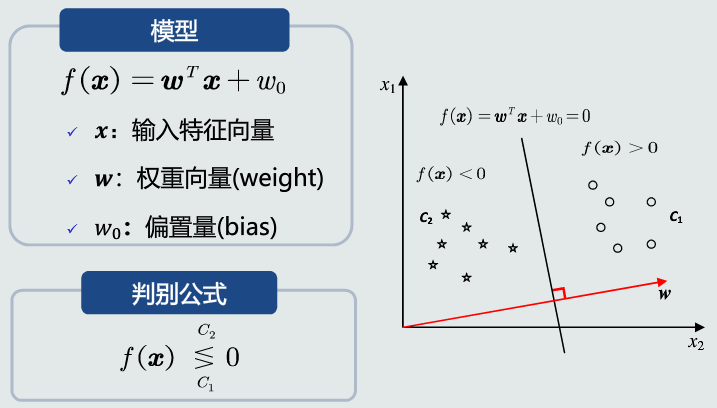

数学表达

4.2、 线性判据学习概述

- 监督式学习(训练)过程:基于训练样本{𝒙1, 𝒙2, … , 𝒙𝑁}及其标签{𝑡1, 𝑡2, … , 𝑡𝑁} ,设计目标函数,学习𝐰和𝑤0。

- 识别过程:将待识别样本𝒙带入训练好的判据方程。

- 解不唯一:训练样本个数通常远大于参数个数,故线性判据满足条件的解不唯一。

- 参数空间:由各个参数维度构成的空间。

- 解域:在参数空间内,参数的所有可能解所处的范围

- 如何从解域中找到最优解:设计目标函数并求解;在算法中加入约束条件,提高泛化能力。

4.3并行感知机算法

- 预处理:参数合一,负类样本取反

- 目标函数是被错误分类的所有训练样本的输出取反求和。

- 目标函数求偏导后不含参数w和w0,故使用梯度下降迭代求解最优,需要设置步长、阈值,和初始化w和w0,当目标函数小于阈值或者大于等于0后,停止。

算法流程:

4.4串行感知机算法

- 串行感知机的适用情况:训练样本是一个一个串行给出的。

- 目标函数:如果当前训练样本被错误分类,最小化其输出值取反。

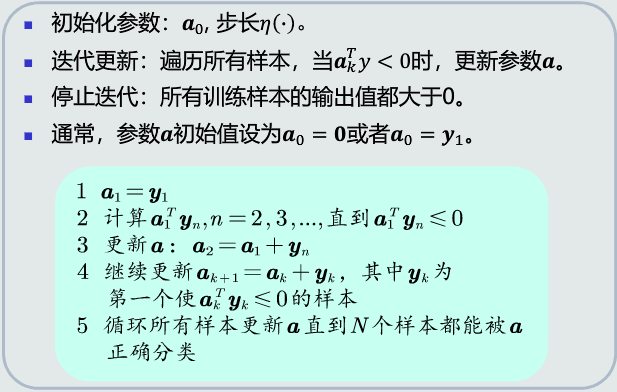

- 串行感知机算法流程:初始化参数->迭代更新->停止迭代->参数a初始值设为0或y1。

- 当样本位于决策边界边缘时,对该样本的决策有很大的不确定性->加入margin约束条件,提高泛化能力。

- 最小化目标函数:取关于参数向量a的偏导。

算法路程:

4.5Fisher线性判据

- 设计动机:线性判据的模型可以看做是把原空间各点x投影到新的一维空间y。y=wT+w0

- 基本原理:找到一个最合适的投影轴,使两类样本在该轴上投影的重叠部分最少,从而使分类效果达到最佳。

Fisher判据训练过程

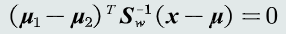

决策边界方程

4.6 支持向量机基本概念

- 设计思想:给定一组训练样本,使得两个类中与决策边界最近的训练样本到决策边界之间的间隔最大。

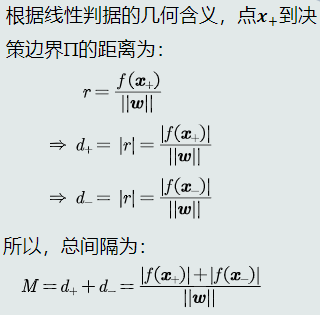

- 间隔的数学定义:在两个类的训练样本中,分别找到与决策边界最近的两个训练样本,记作x+和x-。

- 间隔的计算

- 支持向量机(SVM):最大化总间隔。

4.7 拉格朗日乘数法

- 拉格朗日乘数法:用于解决支持向量机的目标函数的一个条件优化问题。

- 等式约束:f(x)的极值点x∗必须位于曲线g(x)=0上。

- KTT条件:最小化问题;多个约束问题

4.8 拉格朗日对偶问题

- 对偶函数:主问题的最优值下界

- 对偶函数LD是拉格朗日函数L的逐点最小值函数。

- 逐点最小值函数min是凹函数。

- 由于逐点最大化函数是凹函数,且拉格朗日函数可以看做关于对偶变量的仿射组合,故对偶函数LD是凹函数。

- 由于目标函数LD是凹函数,约束条件是凸函数,所以对偶问题是凸优化问题。

- 强对偶性:如果强对偶性成立,则对偶问题获得主问题的最优下界。

4.9 支持向量机学习算法

- 带不等式约束的优化问题使用拉格朗日对偶法求解。

- key:构造对偶函数。

- 对偶问题的求解:二次规划问题+参数最优化。

- w的最优解

- 决策过程:𝒘 和 𝑤0 的学习过程实际上是从训练样本中选择一组支持向量,并将这些支持向量存储下来,用作线性分类器。

4.10 软间隔支持向量机

- 软间隔:克服过拟合。

- 软间隔克服过拟合的原理:可以将SVM的硬间隔(hard margin)放宽到软间隔(soft margin),允许一些训练样本出现在间隔区域内,从而具备一定的克服过拟合的能力)

- 设计思想:引入松弛变量。

- 分类器表达

4.11 线性判据多类分类

- 多类分类的本质:非线性

- 实现非线性分类的途径:一个模型:能刻化非线性的决策边界。

- 多个模型:多个模型(线性/非线性)组合成非线性决策边界。

- 组合方式:并行组合、串行组合。

4.12 线性回归

- 线性回归模型表达

- 线性回归模型学习过程:学习参数(给定学习样本学习参数w)->给定N个训练样本->目标函数(最小化均方误差)

- 目标优化过程:展开目标函数->对参数w求偏导->目标优化(梯度下降法)->最小二乘法

4.13 逻辑回归的概念

- MAP分类器

- 如果两个类别数据分布的协方差矩阵不同(即Σ𝑖 ≠ Σ𝑗),则MAP分类器的决策边界是一个超二次型曲面,即非线性。

- 如果两个类别数据分布的协方差矩阵相同(即Σ𝑖 = Σ𝑗 ),则MAP分类器的决策边界是一个超平面,即线性。

- Logit变换:𝐶1类的后验概率与𝐶2类的后验概率之间的对数比率

- 对于二类分类,MAP分类器通过比较后验概率的大小来决策。

- 在每类数据是高斯分布且协方差矩阵相同的情况下,由于Logit变换等同于线性判据的输出,所以在此情况下Logit(z) 是线性的。

- Sigmoid函数:连接线性模型和后验概率的桥梁

- 线性模型𝑓(𝒙) + Sigmoid函数 = 后验概率

- 逻辑回归:线性模型𝑓(𝒙) + sigmoid函数。

- 决策边界:单个逻辑回归可以用于二类分类;给定两个类,逻辑回归的决策边界仍然是线性的超平面。

- 逻辑回归总结:

- 逻辑回归本身是一个非线性模型。

- 逻辑回归用于分类:仍然只能处理两个类别线性可分的情况。但是,sigmoid函数输出了后验概率,使得逻辑回归成为一个非线性模型。因此,逻辑回归比线性模型向前迈进了一步。

- 逻辑回归用于拟合:可以拟合有限的非线性曲线。

4.14 逻辑回归的学习

- 学什么:给定训练样本,学习参数𝒘和𝑤0。

- 训练样本:

- 正类(𝐶1类)样本的输出真值𝑡𝑛 = 1;

- 负类(𝐶2类)样本的输出真值𝑡𝑛 = 0。

- 注意:这种真值取值方式与SVM不一样。

- 最大似然估计法:给定单个输入样本𝒙,模型输出的类别标签𝑙可以看做一个随机变量。

- 交叉熵:交叉熵可以用来度量两种分布的差异程度。

- 目标函数:给定𝑁个训练样本,把每个训练样本的交叉熵求和,得到最终的目标函数:

- 目标函数优化:梯度下降法;

- 步骤:对参数w求偏导;对参数w0求偏导;参数更新:采用梯度下降法更新w和w0;

4.15 Softmax判据的概念

- 逻辑回归输出:属于正类的后验概率

- 后验概率的多类情况:一个类与剩余类的后验概率比率。

- 逻辑回归是由Logit变换反推出来的。

- 由Logit变换可知:正负类后验概率比率的对数是一个线性函数。

- 分类𝐾个类,可以构建𝐾个线性判据。第𝑖个线性判据表示𝐶𝑖类与剩余类的分类边界,剩余类用一个参考负类(reference class) 𝐶𝐾来表达。

- 对于多类分类,K个线性模型也跟每个类对应的后验概率建立起了联系。

- Softmax判据:𝐾个线性判据 + softmax函数。

- Softmax判据用于分类,等同于基于one-to-all策略的线性机。

- 适用范围:分类、回归

4.16 Softmax判据的学习

- 学什么:给定训练样本,学习K组参数

- 目标函数:最大似然估计。针对所有训练样本,最大化输出标签分布的似然函数,以此求得参数的最优值。似然函数为所有训练样本输出概率的乘积。

- 判别式学习是依赖所有类的训练样本来学习参数。

- Softmax:针对每个输出类别分别计算梯度值,但每个参数的梯度值与所有类别样本都相关。

4.17 核支持向量机

- Kernel方法的基本思想:如果样本在原始特征空间(𝑋空间)线性不可分,可以将这些样本通过一个函数𝜑映射到一个高维的特征空间(Φ空间),使得在这个高维空间,这些样本拥有一个线性分类边界。

- 核函数:在低维X空间的一个非线性函数,包含向量映射和点积功能,即作为X空间两个向量的度量,来表达映射到高维空间的向量之间的点积。

- Kernel SVM的决策是关于测试样本x与Ns个支持向量xk的核函数的线性组合,即Ns个非线性函数的线性组合。

浙公网安备 33010602011771号

浙公网安备 33010602011771号