EIK日志分析系统(Elasticsearch | Logstash | Kiabana | Filebeat)的安装与部署

EIK日志分析系统(Elasticsearch | Logstash | Kiabana | Filebeat)的安装与部署_eik学习-CSDN博客

一、ELK简介

ELK平台是一套完整的日志集中处理解决方案,将ElasticSearch、 Logstash 和Kiabana三个开源工具配合使用,完成更强大的用户对日志的查询、排序、统计需求。

1、ElasticSearch的概述

- ElasticSearch:是基于Lucene (一个全文检索引擎的架构)开发的分布式存储检索引擎,用来存储各类日志。

Elasticsearch是用Java 开发的,可通过RESTful Web接口,让用户可以通过浏览器与Elasticsearch通信。

Elasticsearch是个分布式搜索和分析引擎,优点是能对大容量的数据进行接近实时的存储、搜索和分析操作。

2、Logstash的概述

- Logstash:作为数据收集引擎数据收集引擎。它支持动态的从各种数据源搜集数据,并对数据进行过滤、分析、丰富、统一格式等操作,然后存储到用户指定的位置,一般会发送给

Elasticsearch。

Logstash由JRuby语言编写,运行在Java 虚拟机(JVM) 上,是一款强大的数据处理工具,对内存资源要求比较高,可以实现数据传输、格式处理、格式化输出<。Logstash 具有强大的插件功能,常用于日志处理。

3、Kiabana的概述

- Kiabana:是基于Node.js开发的展示工具,可以为Logstash 和ElasticSearch 提供图形化的日志分析web界面展示,可以汇总、分析和搜索重要数据日志。

4、Filebeat的概述

- Filebeat:轻量级的开源日志文件数据搜集器。通常在需要采集数据的客户端安装Filebeat,并指定目录与日志格式,Filebeat 就能快速收集数据,并发送给logstash 进行解析,或是直接发给Elasticsearch存储,性能上相比运行于JVM上的logstash 优势明显,是对它的替代。

二、为什么要使用ELK

- 日志主要包括系统日志、应用程序日志和安全日志。系统运维和开发人员可以通过日志了解服务器软硬件信息、检查配置过程中的错误及错误发生的原因。经常分析日志可以了解服务器的负荷,性能安全性,从而及时采取措施纠正错误。

- 往往单台机器的日志我们使用

grep、awk等工具就能基本实现简单分析,但是当日志被分散的储存不同的设备上。如果你管理数十上百台服务器,你还在使用依次登录每台机器的传统方法查阅日志。这样是不是感觉很繁琐和效率低“下。当务之急我们使用集中化的日志管理,例如:开源的syslog,将所有服务器上的日志收集汇总。集中化管理日志后,日志的统计和检索又成为一件比较麻烦的事情,一般我们使用grep、awk和wc等Linux命令能实现检索和统计,但是对于要求更高的查询、排序和统计等要求和庞大的机器数量依然使用这样的方法难免有点力不从心。 - 一般大型系统是一个分布式部署的架构,不同的服务模块部署在不同的服务器上,问题出现时,大部分情况需要根据问题暴露的关键信息,定位到具体的服务器和服务模块,构建一套集中式日志系统,可以提高定位问题的效率。

三、完整日志系统基本特征

| 特征 | 说明 |

|---|---|

| 收集 | 能够采集多种来源的日志数据 |

| 传输 | 能够稳定的把日志数据解析过滤并传输到存储系统 |

| 存储 | 存储日志数据 |

| 分析 | 支持UI分析 |

| 警告 | 能够提供错误报告,监控机制 |

四、ELK的工作原理

- 在所有需要收集日志的服务器上部署

Logstash;或者先将日志进行集中化管理在日志服务器上,在日志服务器上部署Logstash。 - Logstash 收集日志,将日志格式化并输出到

Elasticsearch群集中。 - Elasticsearch 对格式化后的数据进行索引和存储。

- Kibana从

ES群集中查询数据生成图表,并进行前端数据的展示。

五、ELK操作部署

环境配置

| 服务器 | IP地址 | 配置服务 |

|---|---|---|

| Node1节点(2C/4G) | node1/192.168.111.30 | Elasticsearch、Kibana |

| Node2节点(2C/4G) | node2/192.168.111.40 | Elasticsearch |

| Apache节点 | apache/192.168.111.50 | Logstash 、Apache |

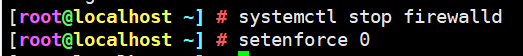

systemctl stop firewalld

setenforce 0

ELK Elasticsearch 集群部署

在Node1、Node2节点上操作

1、环境准备

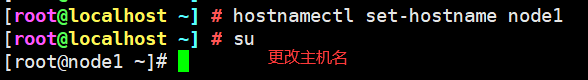

#更改主机名、配置域名解析、查看Java环境

Node1节点:hostnamectl set-hostname node1

Node2节点:hostnamectl set-hostname node2

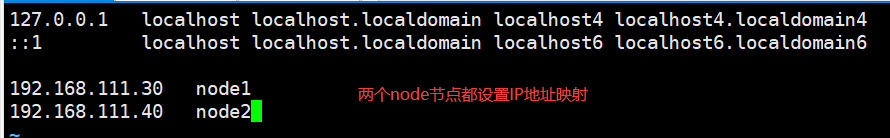

vim /etc/hosts

192.168.111.30 node1

192.168.111.40 node2

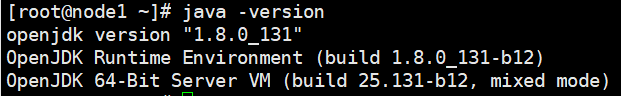

java -version #如果没有安装,yum -y install java

openjdk version "1.8.0_131"

OpenJDK Runtime Environment (build 1.8.0_131-b12)

OpenJDK 64-Bit Server VM (build 25.131-b12, mixed mode)

2、部署 Elasticsearch 软件

(1)安装elasticsearch—rpm包

#上传elasticsearch-5.5.0.rpm到/opt目录下

cd /opt

rpm -ivh elasticsearch-5.5.0.rpm

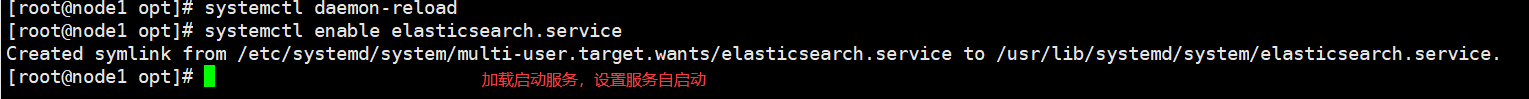

(2)加载系统服务

systemctl daemon-reload

systemctl enable elasticsearch.service

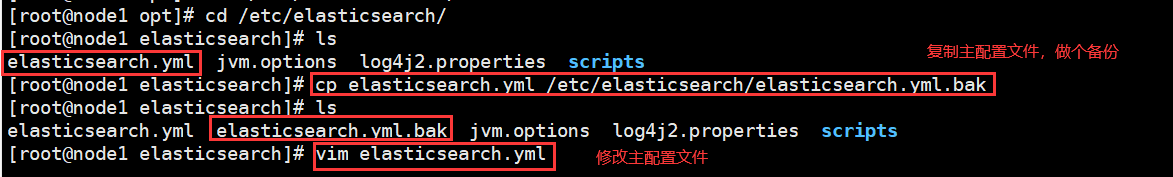

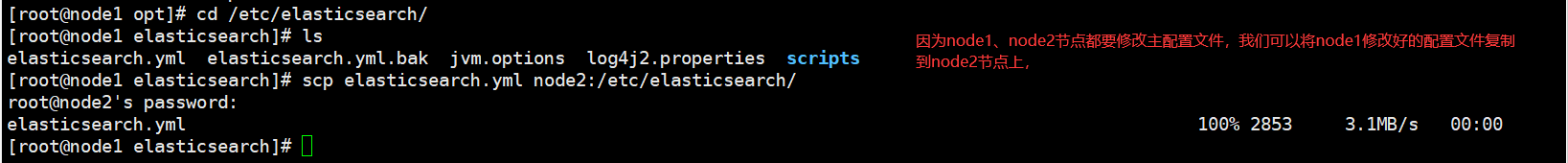

(3)修改elasticsearch主配置文件

cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

vim /etc/elasticsearch/elasticsearch.yml

--17--取消注释,指定集群名字

cluster.name: my-elk-cluster

--23--取消注释,指定节点名字:Node1节点为node1,Node2节点为node2

node.name: node1

--33--取消注释,指定数据存放路径

path.data: /data/elk_data

--37--取消注释,指定日志存放路径

path.logs: /var/log/elasticsearch/

--43--取消注释,改为在启动的时候不锁定内存

bootstrap.memory_lock: false

--55--取消注释,设置监听地址,0.0.0.0代表所有地址

network.host: 0.0.0.0

--59--取消注释,ES 服务的默认监听端口为9200

http.port: 9200

--68--取消注释,集群发现通过单播实现,指定要发现的节点 node1、node2

discovery.zen.ping.unicast.hosts: ["node1", "node2"]

grep -v "^#" /etc/elasticsearch/elasticsearch.yml

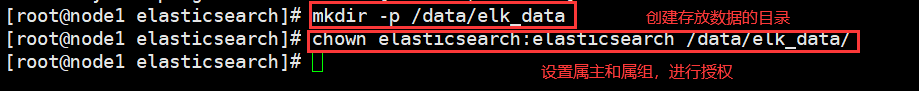

(4)创建数据存放路径并授权

mkdir -p /data/elk_data

chown elasticsearch:elasticsearch /data/elk_data/

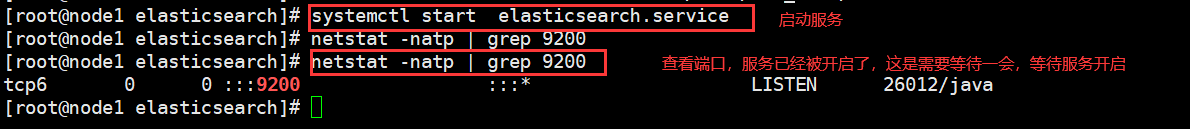

(5)启动elasticsearch是否成功开启

systemctl start elasticsearch.service

netstat -antp | grep 9200

(6)查看节点信息

浏览器访问 http://192.168.111.30:9200 、 http://192.168.111.40:9200 查看节点 Node1、Node2 的信息。

浏览器访问 http://192.168.111.30:9200/_cluster/health?pretty 、 http://192.168.111.40:9200/_cluster/health?pretty查看群集的健康情况,可以看到 status 值为 green(绿色), 表示节点健康运行。

浏览器访问 http://192.168.111.30:9200/_cluster/state?pretty 检查群集状态信息

#使用上述方式查看群集的状态对用户并不友好,可以通过安装 Elasticsearch-head 插件,可以更方便地管理群集。

3、安装 Elasticsearch-head 插件

-

Elasticsearch 在 5.0 版本后,Elasticsearch-head 插件需要作为独立服务进行安装,需要使用npm工具(NodeJS的包管理工具)安装。

-

安装 Elasticsearch-head 需要提前安装好依赖软件 node 和 phantomjs。

-

node:是一个基于 Chrome V8 引擎的 JavaScript 运行环境。

-

phantomjs:是一个基于 webkit 的JavaScriptAPI,可以理解为一个隐形的浏览器,任何基于 webkit 浏览器做的事情,它都可以做到。

(1)编译安装 node

#上传软件包 node-v8.2.1.tar.gz 到/opt

yum install gcc gcc-c++ make -y

cd /opt

tar zxvf node-v8.2.1.tar.gz

cd node-v8.2.1/

./configure

make && make install

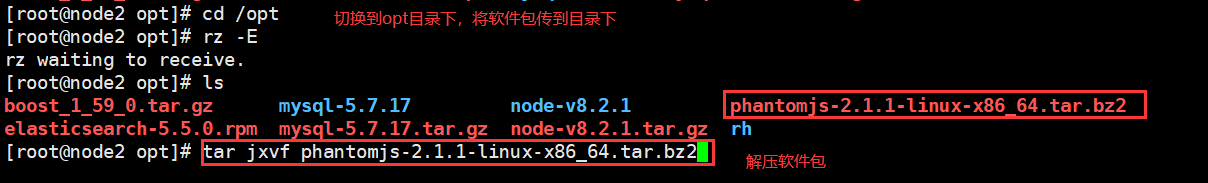

(2)安装 phantomjs

#上传软件包 phantomjs-2.1.1-linux-x86_64.tar.bz2 到opt

cd /opt

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /usr/local/src/

cd /usr/local/src/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin

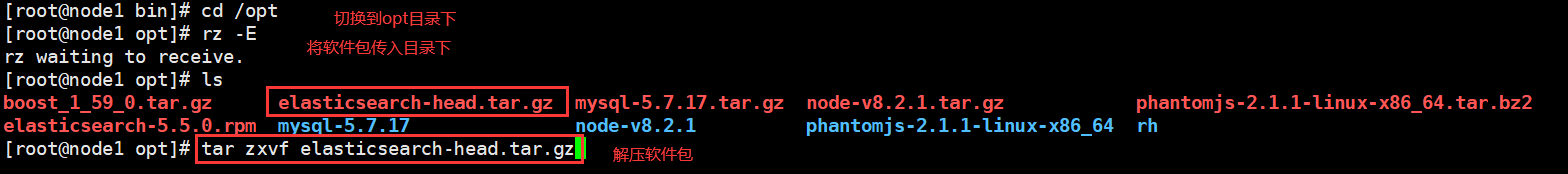

(3)安装 Elasticsearch-head 数据可视化工具

#上传软件包 elasticsearch-head.tar.gz 到/opt

cd /opt

tar zxvf elasticsearch-head.tar.gz -C /usr/local/src/

cd /usr/local/src/elasticsearch-head/

npm install

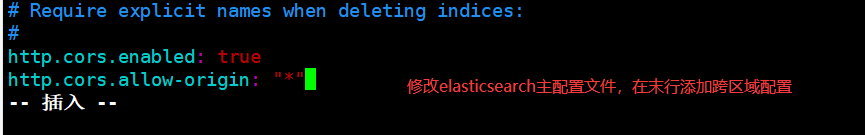

(4)修改 Elasticsearch 主配置文件

vim /etc/elasticsearch/elasticsearch.yml

......

--末尾添加以下内容--

http.cors.enabled: true #开启跨域访问支持,默认为 false

http.cors.allow-origin: "*" #指定跨域访问允许的域名地址为所有

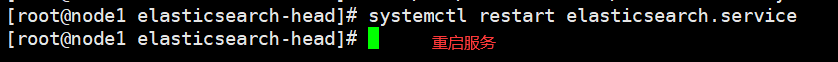

systemctl restart elasticsearch

(5)启动 elasticsearch-head 服务

#必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

cd /usr/local/src/elasticsearch-head/

npm run start &

> elasticsearch-head@0.0.0 start /usr/local/src/elasticsearch-head

> grunt server

Running "connect:server" (connect) task

Waiting forever...

Started connect web server on http://localhost:9100

#elasticsearch-head 监听的端口是 9100

netstat -natp |grep 9100

(6)通过 Elasticsearch-head 查看 Elasticsearch 信息

通过浏览器访问 http://192.168.111.30:9100/ 地址并连接群集。如果看到群集健康值为 green 绿色,代表群集很健康。

(7)插入索引

#通过命令插入一个测试索引,索引为 index-demo,类型为 test。

curl -X PUT 'localhost:9200/index-demo/test/1?pretty&pretty' -H 'content-Type: application/json' -d '{"user":"zhangsan","mesg":"hello world"}'

//输出结果如下:

{

"_index" : "index-demo",

"_type" : "test",

"_id" : "1",

"_version" : 1,

"result" : "created",

"_shards" : {

"total" : 2,

"successful" : 2,

"failed" : 0

},

"created" : true

}

浏览器访问 http://192.168.111.30:9100/ 查看索引信息,可以看见索引默认被分片5个,并且有一个副本。

点击“数据浏览”,会发现在node1上创建的索引为 index-demo,类型为 test 的相关信息。

ELK Logstash 部署

在 Apache 节点上操作

Logstash 一般部署在需要监控其日志的服务器。在本案例中,Logstash 部署在 Apache 服务器上,用于收集 Apache 服务器的日志信息并发送到 Elasticsearch。

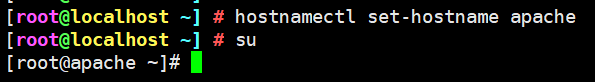

1.更改主机名

hostnamectl set-hostname apache

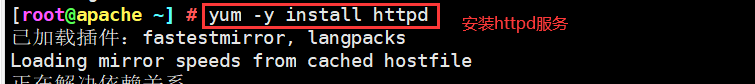

2.安装Apahce服务(httpd)

yum -y install httpd

systemctl start httpd

3.安装Java环境

yum -y install java

java -version

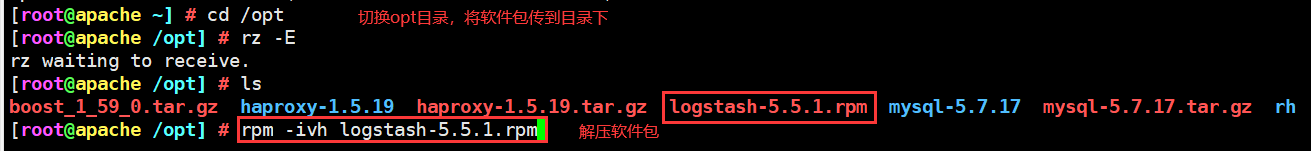

4.安装logstash

#上传软件包 logstash-5.5.1.rpm 到/opt目录下

cd /opt

rpm -ivh logstash-5.5.1.rpm

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

5.测试 Logstash

Logstash 命令常用选项:

| 选项 | 说明 |

|---|---|

| -f | 通过这个选项可以指定 Logstash 的配置文件,根据配置文件配置 Logstash 的输入和输出流 |

| -e | 从命令行中获取,输入、输出后面跟着字符串,该字符串可以被当作 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出) |

| -t | 测试配置文件是否正确,然后退出 |

定义输入和输出流:

#输入采用标准输入,输出采用标准输出(类似管道)

logstash -e 'input { stdin{} } output { stdout{} }'

......

www.baidu.com #键入内容(标准输入)

2020-12-22T03:58:47.799Z node1 www.baidu.com #输出结果(标准输出)

www.sina.com.cn #键入内容(标准输入)

2017-12-22T03:59:02.908Z node1 www.sina.com.cn #输出结果(标准输出)

//执行 ctrl+c 退出

#使用 rubydebug 输出详细格式显示,codec 为一种编解码器

logstash -e 'input { stdin{} } output { stdout{ codec=>rubydebug } }'

......

www.baidu.com #键入内容(标准输入)

{

"@timestamp" => 2020-12-22T02:15:39.136Z, #输出结果(处理后的结果)

"@version" => "1",

"host" => "apache",

"message" => "www.baidu.com"

}

#使用 Logstash 将信息写入 Elasticsearch 中

logstash -e 'input { stdin{} } output { elasticsearch { hosts=>["192.168.111.30:9200"] } }'

输入 输出 对接

......

www.baidu.com #键入内容(标准输入)

www.sina.com.cn #键入内容(标准输入)

www.google.com

//结果不在标准输出显示,而是发送至 Elasticsearch 中,可浏览器访问 http://192.168.80.10:9100/ 查看索引信息和数据浏览。

6.定义 logstash配置文件

Logstash 配置文件基本由三部分组成:input、output 以及 filter(可选,根据需要选择使用。

#格式如下:

input {...}

filter {...}

output {...}

#在每个部分中,也可以指定多个访问方式。例如,若要指定两个日志来源文件,则格式如下:

input {

file { path =>"/var/log/messages" type =>"syslog"}

file { path =>"/var/log/httpd/access.log" type =>"apache"}

}

#修改 Logstash 配置文件,让其收集系统日志/var/log/messages,并将其输出到 elasticsearch 中。

chmod +r /var/log/messages #让 Logstash 可以读取日志

vim /etc/logstash/conf.d/system.conf

input {

file{

path =>"/var/log/messages" #指定要收集的日志的位置

type =>"system" #自定义日志类型标识

start_position =>"beginning" #表示从开始处收集

}

}

output {

elasticsearch { #输出到 elasticsearch

hosts => ["192.168.111.30:9200"] #指定 elasticsearch 服务器的地址和端口

index =>"system-%{+YYYY.MM.dd}" #指定输出到 elasticsearch 的索引格式

}

}

systemctl restart logstash

浏览器访问 http://192.168.111.30:9100/ 查看索引信息

ELK Kiabana 部署

在 Node1 节点上操作

1.安装 Kiabana

#上传软件包 kibana-5.5.1-x86_64.rpm 到/opt目录

cd /opt

rpm -ivh kibana-5.5.1-x86_64.rpm

2.设置 Kibana 的主配置文件

vim /etc/kibana/kibana.yml

--2--取消注释,Kiabana 服务的默认监听端口为5601

server.port: 5601

--7--取消注释,设置 Kiabana 的监听地址,0.0.0.0代表所有地址

server.host: "0.0.0.0"

--21--取消注释,设置和 Elasticsearch 建立连接的地址和端口

elasticsearch.url: "http://192.168.111.30:9200"

--30--取消注释,设置在 elasticsearch 中添加.kibana索引

kibana.index: ".kibana"

3.启动 Kibana 服务

systemctl start kibana.service

systemctl enable kibana.service

netstat -natp | grep 5601

4.验证 Kibana

浏览器访问 http://192.168.111.30:5601

第一次登录需要添加一个 Elasticsearch 索引:

Index name or pattern

//输入:system-* #在索引名中输入之前配置的 Output 前缀“system”

单击 “create” 按钮创建,单击 “Discover” 按钮可查看图表信息及日志信息。

数据展示可以分类显示,在“Available Fields”中的“host”,然后单击 “add”按钮,可以看到按照“host”筛选后的结果

5.将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

vim /etc/logstash/conf.d/apache_log.conf

input {

file{

path => "/etc/httpd/logs/access_log"

type => "access"

start_position => "beginning"

}

file{

path => "/etc/httpd/logs/error_log"

type => "error"

start_position => "beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["192.168.80.10:9200"]

index => "apache_access-%{+YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["192.168.80.10:9200"]

index => "apache_error-%{+YYYY.MM.dd}"

}

}

}

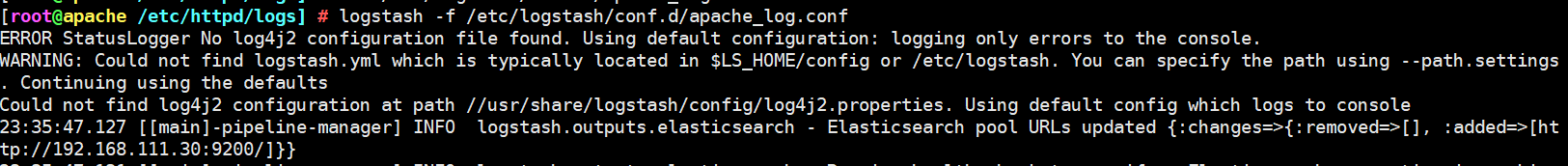

cd /etc/logstash/conf.d/

/usr/share/logstash/bin/logstash -f apache_log.conf

浏览器访问 http://192.168.111.30:9100 查看索引是否创建

浏览器访问 http://192.168.111.30:5601 登录 Kibana,单击“Create Index Pattern”按钮添加索引, 在索引名中输入之前配置的 Output 前缀 apache_access-,并单击“Create”按钮。在用相同的方法添加 apache_error- 索引。

选择“Discover”选项卡,在中间下拉列表中选择刚添加的 apache_access-* 、apache_error-* 索引, 可以查看相应的图表及日志信息。

Filebeat+ELK 部署

1、环境配置

| 服务器 | IP地址 | 安装服务 |

|---|---|---|

| Node1节点(2C/4G) | node1/192.168.111.30 | Elasticsearch Kibana |

| Node2节点(2C/4G) | node2/192.168.111.40 | Elasticsearch |

| Apache节点 | apache/192.168.111.50 | Logstash Apache |

| Filebeat节点 | filebeat/192.168.111.60 | Filebeat |

//在 Node1 节点上操作

2.安装 Filebeat

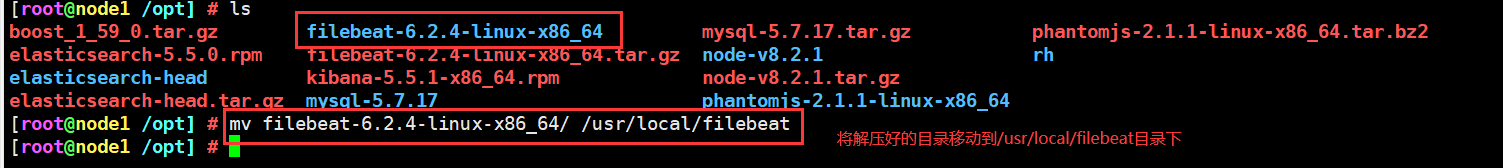

#上传软件包 filebeat-6.2.4-linux-x86_64.tar.gz 到/opt目录

tar zxvf filebeat-6.2.4-linux-x86_64.tar.gz

mv filebeat-6.2.4-linux-x86_64/ /usr/local/filebeat

2.设置 Kibana 的主配置文件

cd /usr/local/filebeat

vim filebeat.yml

filebeat.prospectors:

- type: log #指定 log 类型,从日志文件中读取消息

enabled: true

paths:

- /var/log/messages #指定监控的日志文件

- /var/log/*.log

fields: #可以使用 fields 配置选项设置一些参数字段添加到 output 中

service_name: filebeat

log_type: log

service_id: 192.168.80.13

--------------Elasticsearch output-------------------

(全部注释掉)

----------------Logstash output---------------------

output.logstash:

hosts: ["192.168.111.30:5044"] #指定 logstash 的 IP 和端口

#启动 filebeat

./filebeat -e -c filebeat.yml

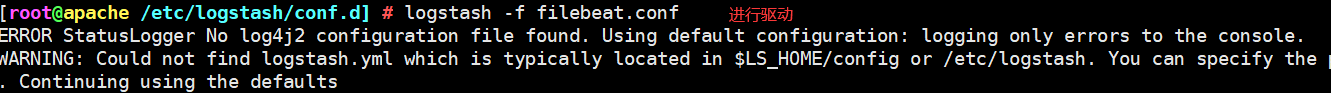

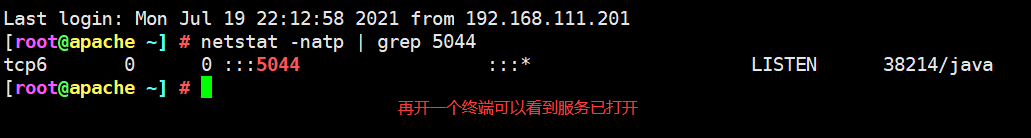

4.在 Logstash 组件所在节点上新建一个 filebeat 配置文件

cd /etc/logstash/conf.d

vim filebeat.conf

input {

beats {

port => "5044"

}

}

output {

elasticsearch {

hosts => ["192.168.80.10:9200"]

index => "%{[fields][service_name]}-%{+YYYY.MM.dd}"

}

stdout {

codec => rubydebug

}

}

#启动 logstash

logstash -f filebeat.conf

5. 访问测试

浏览器访问 http://192.168.111.30:5601 登录 Kibana,单击“Create Index Pattern”按钮添加索引“filebeat-*”,单击 “create” 按钮创建,单击 “Discover” 按钮可查看图表信息及日志信息。

elasticsearch7已配置JAVA_HOME的情况下使用自带jdk

解决此问题有两种方法:

一是安装符合条件的jdk并配置JAVA_HOME。

二是修改elasticsearh根目录下bin目录中的elasticsearch脚本。

Elasticsearch8.1基于CentOS7.9的单机安装_couldn't configure elastic generate a new enrollme-CSDN博客

最近在学习ES的认证考试,也顺便把一些ES安装实施的步骤记录下来,以给有需要的同学借鉴。

硬件配置(虚拟机):2 CPU, 12GB内存,100GB磁盘(当然可以不需要这么大)

OS: CentOS Linux release 7.9.2009 (Core)

计划安装软件:ES 8.1, Kibana8.1

JDK选择:

在elasticsearch7以上的版本中会自带Open JDK,因此建议用自带的JDK,当然也可以单独安装自定义的JDK。

1,下载安装介质

ES和Kibana都建议到官网下载,下载地址:

Elasticsearch:官方分布式搜索和分析引擎 | Elastic

上传到服务器:

[root@localhost install]# ll

total 1338300

-rw-r--r--. 1 root root 1100738560 Oct 16 11:07 elasticsearch-8.1.0-linux-x86_64.tar

-rw-r--r--. 1 root root 269678786 Oct 16 11:07 kibana-8.1.0-linux-x86_64.tar.gz

解压elasticsearch-8.1.0-linux-x86_64.tar到/app/es目录

[root@localhost es]# pwd

/app/es

[root@localhost es]# ls -ltr

total 860

-rw-r--r--. 1 root root 2710 Mar 3 2022 README.asciidoc

-rw-r--r--. 1 root root 3860 Mar 3 2022 LICENSE.txt

drwxr-xr-x. 2 root root 6 Mar 3 2022 plugins

drwxr-xr-x. 2 root root 6 Mar 3 2022 logs

-rw-r--r--. 1 root root 858797 Mar 3 2022 NOTICE.txt

drwxr-xr-x. 3 root root 4096 Mar 3 2022 lib

drwxr-xr-x. 2 root root 4096 Mar 3 2022 bin

drwxr-xr-x. 9 root root 121 Mar 3 2022 jdk

drwxr-xr-x. 66 root root 4096 Mar 3 2022 modules

drwxr-xr-x. 3 root root 210 Oct 16 11:09 config

ES默认不建议使用root账户运行。使用新建的es用户运行。

[root@localhost ~]# cd /app

[root@localhost app]# ll

total 0

drwxr-xr-x. 9 root root 155 Oct 16 11:09 es

drwxrwxrwx. 2 root root 90 Oct 16 11:40 install

[root@localhost app]# chown -R es.es es

[root@localhost app]# ll es

total 860

drwxr-xr-x. 2 es es 4096 Mar 3 2022 bin

drwxr-xr-x. 3 es es 210 Oct 16 11:09 config

drwxr-xr-x. 9 es es 121 Mar 3 2022 jdk

drwxr-xr-x. 3 es es 4096 Mar 3 2022 lib

-rw-r--r--. 1 es es 3860 Mar 3 2022 LICENSE.txt

drwxr-xr-x. 2 es es 6 Mar 3 2022 logs

drwxr-xr-x. 66 es es 4096 Mar 3 2022 modules

-rw-r--r--. 1 es es 858797 Mar 3 2022 NOTICE.txt

drwxr-xr-x. 2 es es 6 Mar 3 2022 plugins

-rw-r--r--. 1 es es 2710 Mar 3 2022 README.asciidoc

2,修改配置文件

修改系统参数,这块是必须项,否则启动会失败

ERROR: [2] bootstrap checks failed. You must address the points described in the following [2] lines before starting Elasticsearch.

bootstrap check failure [1] of [2]: max file descriptors [4096] for elasticsearch process is too low, increase to at least [65535]

bootstrap check failure [2] of [2]: max virtual memory areas vm.max_map_count [65530] is too low, increase to at least [262144]

ERROR: Elasticsearch did not exit normally - check the logs at /app/es/logs/elasticsearch.log

[2022-10-16T12:12:37,926][INFO ][o.e.n.Node ] [node-1] stopping ...

[2022-10-16T12:12:38,009][INFO ][o.e.n.Node ] [node-1] stopped

[2022-10-16T12:12:38,009][INFO ][o.e.n.Node ] [node-1] closing ...

[2022-10-16T12:12:38,028][INFO ][o.e.n.Node ] [node-1] closed

修改进程最大打开文件数数量为65536,

vi /etc/security/limits.conf

* soft nofile 65536

* hard nofile 65536

查看:

[root@goya ~]# ulimit -a

......

open files (-n) 65536

......

修改/etc/sysctl.conf文件,增加配置vm.max_map_count=262144

vi /etc/sysctl.conf

# 最后增加一行:

vm.max_map_count = 262144

# 退出执行

sysctl -p

修改配置文件/app/es/config/elasticsearch.yml

由于我们现在是基础安装,只修改基础的两个配置,其他的都使用默认。

node.name: node-1

network.host: 0.0.0.0

启动ES

自带的JDK版本检查:

[es@localhost bin]$ pwd

/app/es/jdk/bin

[es@localhost bin]$ ./java -version

openjdk version "17.0.2" 2022-01-18

OpenJDK Runtime Environment Temurin-17.0.2+8 (build 17.0.2+8)

OpenJDK 64-Bit Server VM Temurin-17.0.2+8 (build 17.0.2+8, mixed mode, sharing)

启动ES:

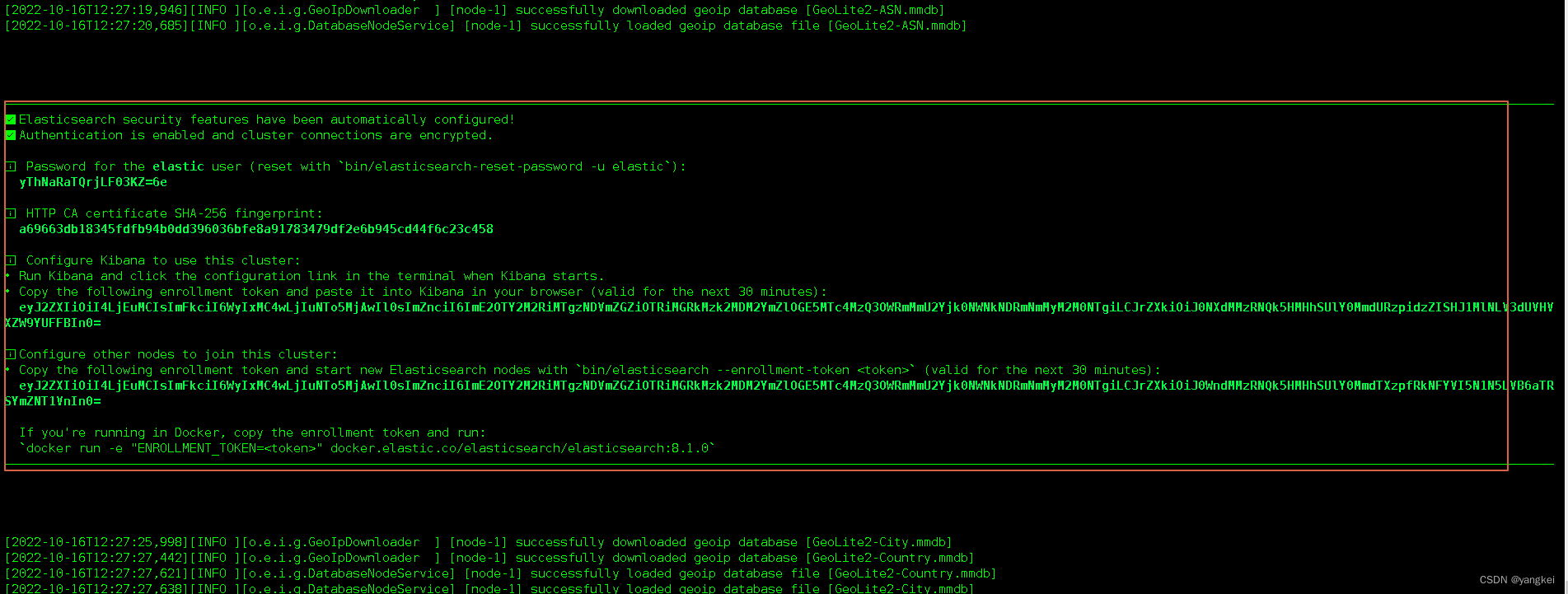

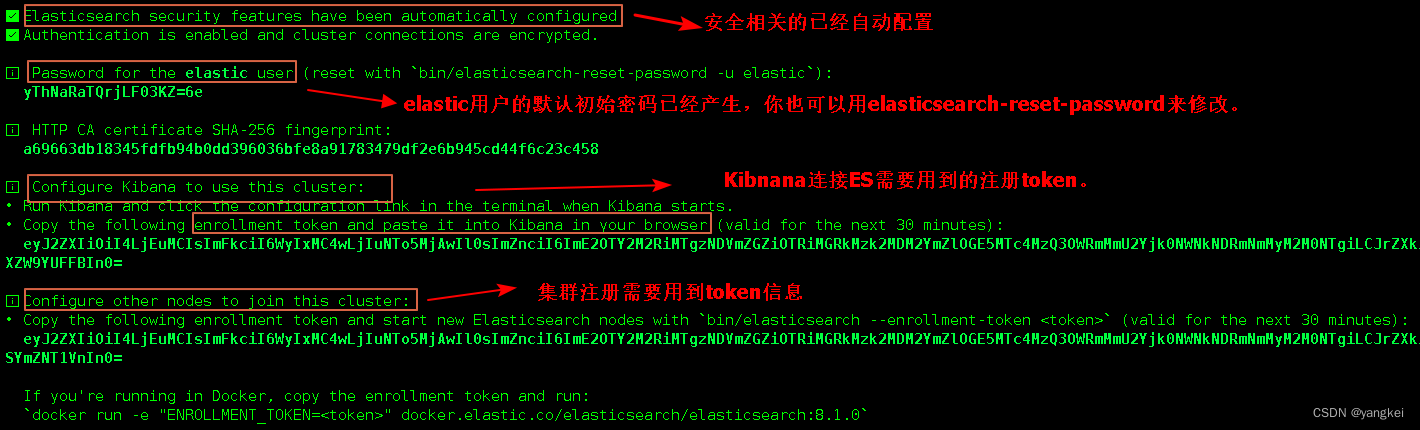

第一次启动,会打印安全相关的信息,需要拷贝记录下来。

相关信息说明:

启动后就可以通过浏览器访问了。在访问之前记得关闭防火墙。

[root@localhost ~]# systemctl stop firewalld

[root@localhost ~]# systemctl disable firewalld

Removed symlink /etc/systemd/system/multi-user.target.wants/firewalld.service.

Removed symlink /etc/systemd/system/dbus-org.fedoraproject.FirewallD1.service.

[root@localhost ~]# systemctl status firewalld

● firewalld.service - firewalld - dynamic firewall daemon

Loaded: loaded (/usr/lib/systemd/system/firewalld.service; disabled; vendor preset: enabled)

Active: inactive (dead)

Docs: man:firewalld(1)

Oct 16 10:51:39 localhost.localdomain systemd[1]: Starting firewalld - dynamic firewall daemon...

Oct 16 10:51:40 localhost.localdomain systemd[1]: Started firewalld - dynamic firewall daemon.

Oct 16 10:51:40 localhost.localdomain firewalld[799]: WARNING: AllowZoneDrifting is enabled. This is considered an insecure configuration option. It will be removed in a future release. Please ...bling it now.

Oct 16 12:53:42 localhost.localdomain systemd[1]: Stopping firewalld - dynamic firewall daemon...

Oct 16 12:53:44 localhost.localdomain systemd[1]: Stopped firewalld - dynamic firewall daemon.

Hint: Some lines were ellipsized, use -l to show in full.

启动完成后,配置文件/app/es/config/elasticsearch.yml会自动加上cert部分的内容:

访问ES。

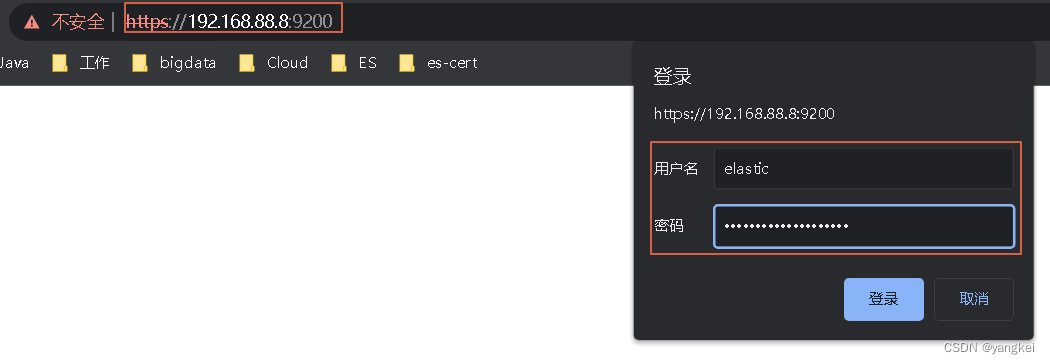

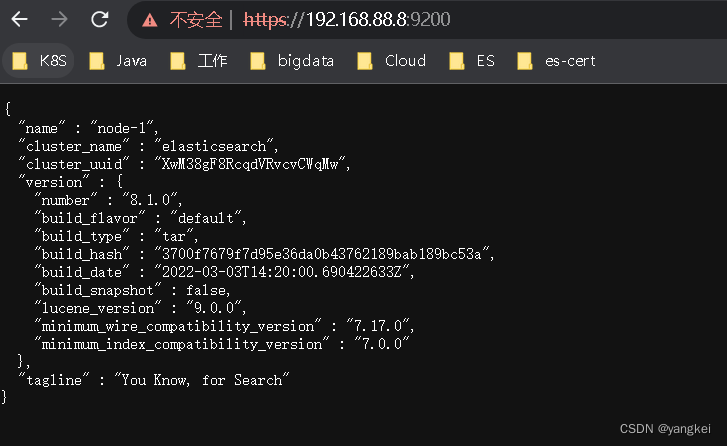

在浏览器输入:https://192.168.88.8:9200/,用户名和密码使用启动时打印信息的部分。

访问成功,单节点ES安装配置完成。

3,安装配置Kibana部分。

同理,kibnana的安装文件解压到/app/es/kibana目录

tar -xvf kibana-8.1.0-linux-x86_64.tar

[root@localhost kibana]# pwd

/app/kibana

[root@localhost kibana]# ll

total 1436

drwxr-xr-x. 2 es es 146 Mar 3 2022 bin

drwxr-xr-x. 2 es es 44 Mar 3 2022 config

drwxr-xr-x. 2 es es 6 Mar 3 2022 data

-rw-r--r--. 1 es es 3860 Mar 3 2022 LICENSE.txt

drwxr-xr-x. 2 es es 6 Mar 3 2022 logs

drwxr-xr-x. 6 es es 108 Mar 3 2022 node

drwxr-xr-x. 836 es es 24576 Mar 3 2022 node_modules

-rw-r--r--. 1 es es 1417101 Mar 3 2022 NOTICE.txt

-rw-r--r--. 1 es es 738 Mar 3 2022 package.json

drwxr-xr-x. 2 es es 6 Mar 3 2022 plugins

-rw-r--r--. 1 es es 3966 Mar 3 2022 README.txt

drwxr-xr-x. 11 es es 177 Mar 3 2022 src

drwxr-xr-x. 3 es es 79 Mar 3 2022 x-pack

修改kibana配置文件

vi /app/kibana/kibana.yml

server.host: "0.0.0.0"

其他的配置项使用默认。

启动kibana

如果要用root启动,需要运行./kibana --allow-root

这里我们使用es用户启动,就可以直接运行kibana命令。

[es@localhost bin]$ pwd

/app/kibana/bin

[es@localhost bin]$ ./kibana

[2022-10-16T13:42:19.892+08:00][INFO ][plugins-service] Plugin "metricsEntities" is disabled.

[2022-10-16T13:42:19.970+08:00][INFO ][http.server.Preboot] http server running at http://0.0.0.0:5601

[2022-10-16T13:42:20.005+08:00][INFO ][plugins-system.preboot] Setting up [1] plugins: [interactiveSetup]

[2022-10-16T13:42:20.006+08:00][INFO ][preboot] "interactiveSetup" plugin is holding setup: Validating Elasticsearch connection configuration…

[2022-10-16T13:42:20.035+08:00][INFO ][root] Holding setup until preboot stage is completed.

i Kibana has not been configured.

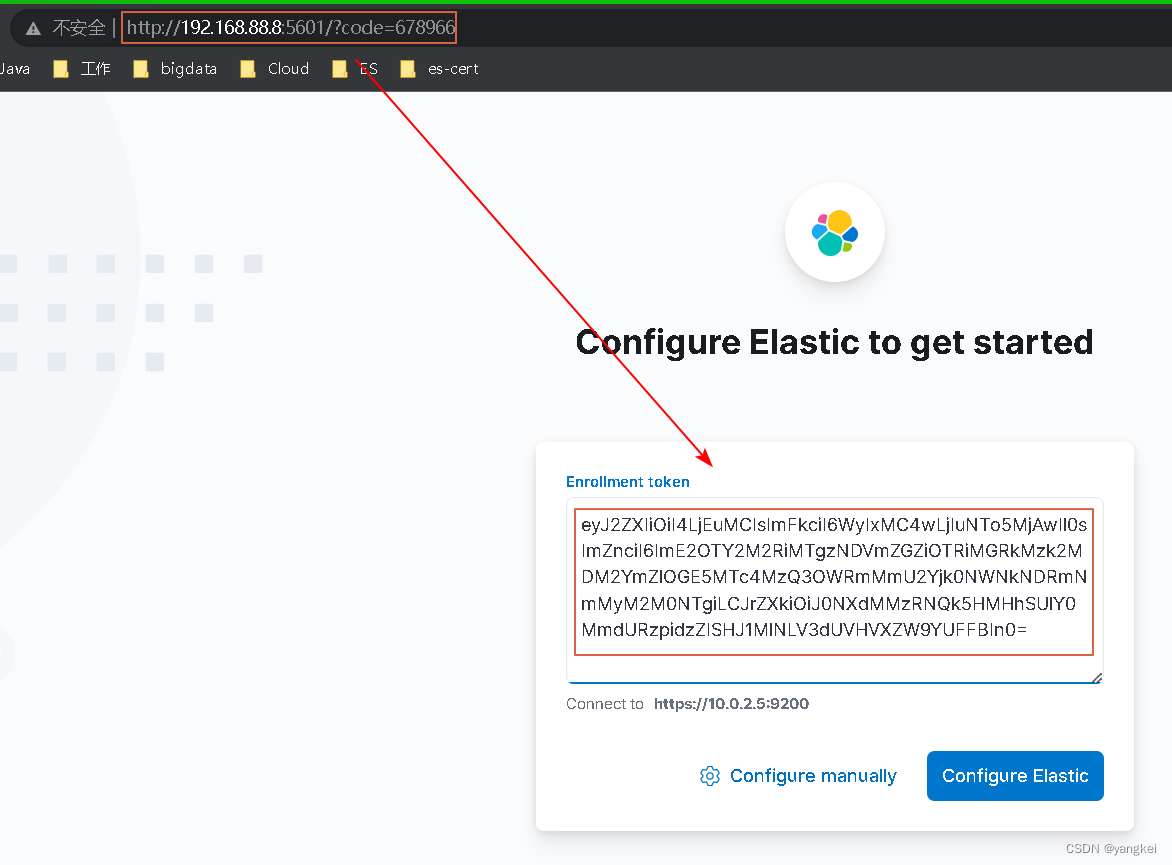

Go to http://0.0.0.0:5601/?code=678966 to get started.

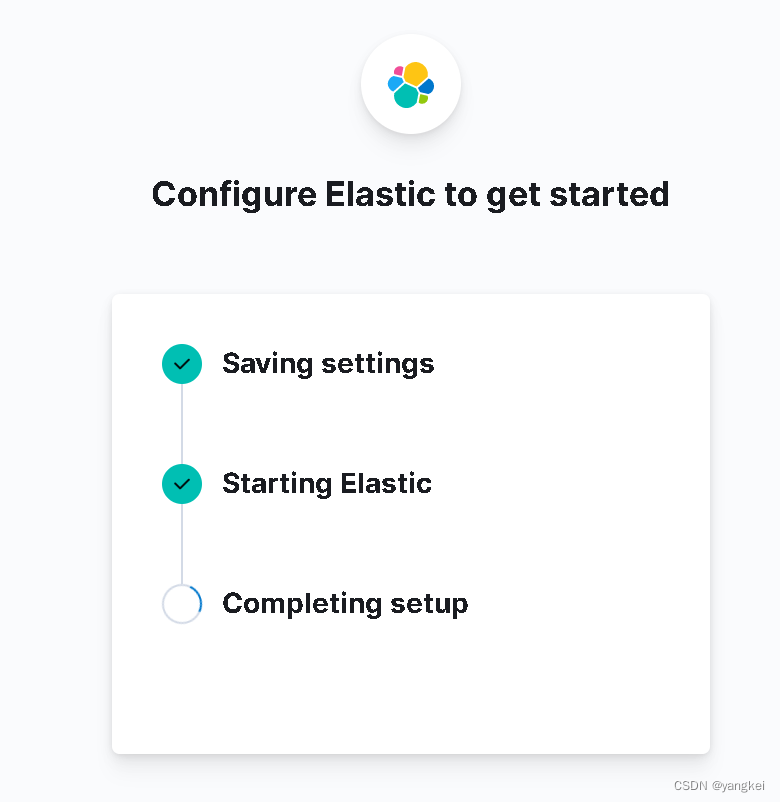

然后浏览器里输入:

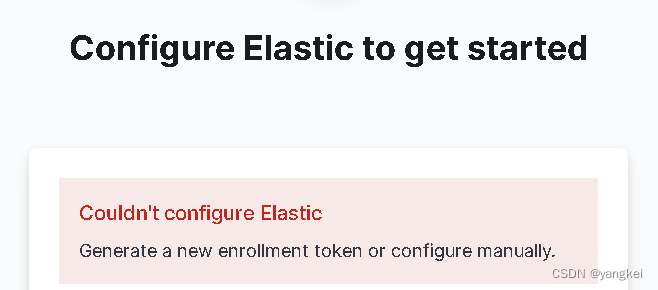

如果遇到如下报错:

Couldn't configure Elastic

Generate a new enrollment token or configure manually.

enrollment token 在第一个 Elasticsearch 启动后的有效时间为30分钟。超过30分钟的时间上述 token 将会无效。

enrollment token分两个,一个是kibana连接es使用的,另一个是es加入集群使用的

如果这种情况发生,我们可以可以使用如下的方法来生成一个新的 token:

[es@localhost bin]$ ./elasticsearch-create-enrollment-token -s kibana --url "https://0.0.0.0:9200"

eyJ2ZXIiOiI4LjEuMCIsImFkciI6WyIxMC4wLjIuNTo5MjAwIl0sImZnciI6ImE2OTY2M2RiMTgzNDVmZGZiOTRiMGRkMzk2MDM2YmZlOGE5MTc4MzQ3OWRmMmU2Yjk0NWNkNDRmNmMyM2M0NTgiLCJrZXkiOiJ1SnhkMzRNQk5HMHhSUlY0RGdRMTo1UEJycEdiZlIyaXNDQWhfRFlZQ2pnIn0=

拷贝上面的命令生成的token内容,重新注册将会成功。

这里输入elastic和之前ES启动里产生的密码。

因为默认产生的密码很复杂,这里也可以通过命令修改成自己的容易记忆的密码。

[es@localhost bin]$ ./elasticsearch-reset-password -u elastic -i

This tool will reset the password of the [elastic] user.

You will be prompted to enter the password.

Please confirm that you would like to continue [y/N]y

Enter password for [elastic]: elastic123

Re-enter password for [elastic]: elastic123

Password for the [elastic] user successfully reset.

[es@localhost bin]$

查看ES版本

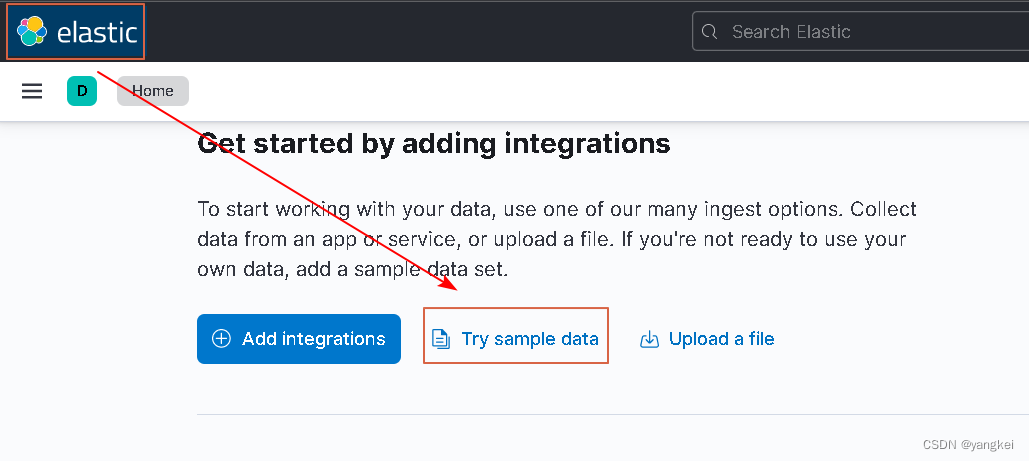

导入sample数据:

点击"Add data"

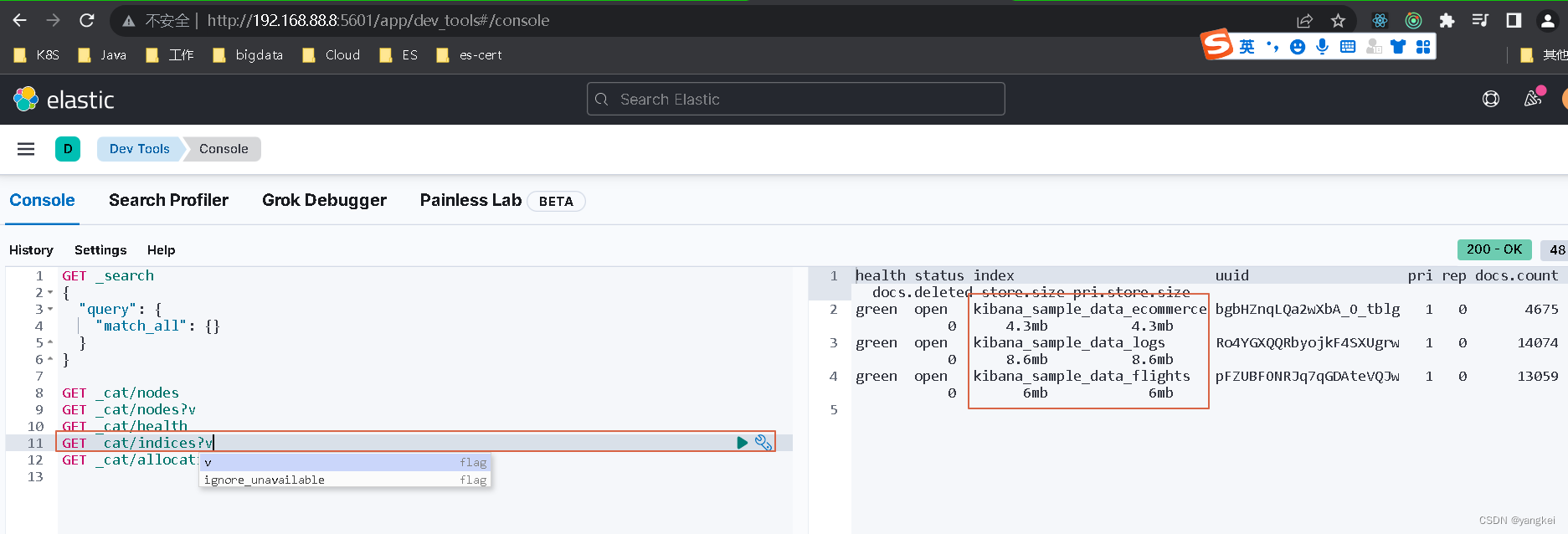

进行简单的ES数据查询

至此,Kibana部分完成。

Elasticsearch启动报错:

org.elasticsearch.bootstrap.StartupException: java.lang.RuntimeException: can not run elasticsearch as root

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:163) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.bootstrap.Elasticsearch.execute(Elasticsearch.java:150) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.cli.EnvironmentAwareCommand.execute(EnvironmentAwareCommand.java:86) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.cli.Command.mainWithoutErrorHandling(Command.java:124) ~[elasticsearch-cli-6.8.9.jar:6.8.9]

at org.elasticsearch.cli.Command.main(Command.java:90) ~[elasticsearch-cli-6.8.9.jar:6.8.9]

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:116) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:93) ~[elasticsearch-6.8.9.jar:6.8.9]

Caused by: java.lang.RuntimeException: can not run elasticsearch as root

at org.elasticsearch.bootstrap.Bootstrap.initializeNatives(Bootstrap.java:103) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.bootstrap.Bootstrap.setup(Bootstrap.java:170) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.bootstrap.Bootstrap.init(Bootstrap.java:333) ~[elasticsearch-6.8.9.jar:6.8.9]

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:159) ~[elasticsearch-6.8.9.jar:6.8.9]

... 6 more- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

解决方法有两类:

1、修改elaticsearch配置,使其可以允许root用户启动(不建议)

#在执行elasticSearch时加上参数-Des.insecure.allow.root=true,完整命令如下

./elasticsearch -Des.insecure.allow.root=true

#或者 用vi打开elasicsearch执行文件,在变量ES_JAVA_OPTS使用前添加以下命令

ES_JAVA_OPTS="-Des.insecure.allow.root=true"- 1

- 2

- 3

- 4

- 5

- 6

- 7

2、为elaticsearch创建用户并赋予相应权限

命令如下 具体介绍参考我的另一篇博客linux创建新用户并将为其赋予权限

adduser es

passwd es

chown -R es:es elasticsearch-6.8.9/

chmod 770 elasticsearch-6.8.9/- 1

- 2

- 3

- 4

- 5

- 6

- 7

这个意思是ES不能使用root用户启动,只能通过建立其它用户来启动,可以建立一个es用户来启动:

useradd es

su es- 1

- 2

- 3

原因分析:检查报错文件/home/elasticsearch/logs/my-application_server.json在系统里面的权限。通过下面的命令可以看到的owner是root账号 不是ES的启动账号,问题应该就在这里。

-

[root@testmachine ~]# cd /home/elasticsearch/logs/

-

[root@testmachine logs]# ls -lh

-

total 36M

-

-rw-rw-r--. 1 es es 40K Sep 27 10:55 gc.log

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:34 gc.log.00

-

-rwxrwxr--. 1 es es 2.3K Sep 15 11:34 gc.log.01

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:39 gc.log.02

-

-rwxrwxr--. 1 es es 2.3K Sep 15 11:39 gc.log.03

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:40 gc.log.04

-

-rwxrwxr--. 1 es es 2.3K Sep 15 11:41 gc.log.05

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:43 gc.log.06

-

-rwxrwxr--. 1 es es 38K Sep 15 11:44 gc.log.07

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:44 gc.log.08

-

-rwxrwxr--. 1 es es 3.4M Sep 18 09:15 gc.log.09

-

-rwxrwxr--. 1 es es 2.0K Sep 18 09:16 gc.log.10

-

-rwxrwxr--. 1 es es 13M Sep 21 11:04 gc.log.11

-

-rwxrwxr--. 1 es es 2.0K Sep 21 11:14 gc.log.12

-

-rwxrwxr--. 1 es es 2.7K Sep 21 11:14 gc.log.13

-

-rwxrwxr--. 1 es es 2.0K Sep 21 11:27 gc.log.14

-

-rwxrwxr--. 1 es es 20M Sep 26 21:25 gc.log.15

-

-rwxrwxr--. 1 root root 2.0K Sep 27 10:40 gc.log.16

-

-rwxrwxr--. 1 root root 2.7K Sep 27 10:40 gc.log.17

-

-rwxrwxr--. 1 root root 2.0K Sep 27 10:46 gc.log.18

-

-rwxrwxr--. 1 root root 2.5K Sep 27 10:46 gc.log.19

-

-rwxrwxr--. 1 es es 2.0K Sep 27 10:47 gc.log.20

-

-rwxrwxr--. 1 es es 94K Sep 27 10:51 gc.log.21

-

-rw-rw-r--. 1 es es 2.0K Sep 27 10:50 gc.log.22

-

-rw-rw-r--. 1 es es 61K Sep 27 10:53 gc.log.23

-

-rw-rw-r--. 1 es es 2.0K Sep 27 10:54 gc.log.24

-

-rwxrwxr--. 1 es es 8.8K Sep 16 01:23 my-application-2021-09-15-1.json.gz

-

-rwxrwxr--. 1 es es 6.4K Sep 16 01:23 my-application-2021-09-15-1.log.gz

-

-rwxrwxr--. 1 es es 1.1K Sep 17 01:23 my-application-2021-09-16-1.json.gz

-

-rwxrwxr--. 1 es es 876 Sep 17 01:23 my-application-2021-09-16-1.log.gz

-

-rwxrwxr--. 1 es es 1001 Sep 18 01:23 my-application-2021-09-17-1.json.gz

-

-rwxrwxr--. 1 es es 833 Sep 18 01:23 my-application-2021-09-17-1.log.gz

-

-rwxrwxr--. 1 es es 5.2K Sep 19 01:23 my-application-2021-09-18-1.json.gz

-

-rwxrwxr--. 1 es es 5.0K Sep 19 01:23 my-application-2021-09-18-1.log.gz

-

-rwxrwxr--. 1 es es 821 Sep 20 01:23 my-application-2021-09-19-1.json.gz

-

-rwxrwxr--. 1 es es 663 Sep 20 01:23 my-application-2021-09-19-1.log.gz

-

-rwxrwxr--. 1 es es 1.6K Sep 21 00:12 my-application-2021-09-20-1.json.gz

-

-rwxrwxr--. 1 es es 1.3K Sep 21 00:12 my-application-2021-09-20-1.log.gz

-

-rwxrwxr--. 1 es es 16K Sep 22 01:23 my-application-2021-09-21-1.json.gz

-

-rwxrwxr--. 1 es es 15K Sep 22 01:23 my-application-2021-09-21-1.log.gz

-

-rwxrwxr--. 1 es es 504 Sep 23 01:23 my-application-2021-09-22-1.json.gz

-

-rwxrwxr--. 1 es es 360 Sep 23 01:23 my-application-2021-09-22-1.log.gz

-

-rwxrwxr--. 1 es es 502 Sep 24 01:23 my-application-2021-09-23-1.json.gz

-

-rwxrwxr--. 1 es es 357 Sep 24 01:23 my-application-2021-09-23-1.log.gz

-

-rwxrwxr--. 1 es es 501 Sep 25 01:23 my-application-2021-09-24-1.json.gz

-

-rwxrwxr--. 1 es es 357 Sep 25 01:23 my-application-2021-09-24-1.log.gz

-

-rwxrwxr--. 1 es es 504 Sep 26 01:23 my-application-2021-09-25-1.json.gz

-

-rwxrwxr--. 1 es es 358 Sep 26 01:23 my-application-2021-09-25-1.log.gz

-

-rwxrwxr--. 1 root root 509 Sep 27 10:40 my-application-2021-09-26-1.json.gz

-

-rwxrwxr--. 1 root root 364 Sep 27 10:40 my-application-2021-09-26-1.log.gz

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_audit.json

-

-rwxrwxr--. 1 es es 6.2K Sep 22 09:44 my-application_deprecation.json

-

-rwxrwxr--. 1 es es 3.0K Sep 22 09:44 my-application_deprecation.log

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_indexing_slowlog.json

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_indexing_slowlog.log

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_search_slowlog.json

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_search_slowlog.log

-

-rwxrwxr--. 1 root root 5.4K Sep 27 10:46 my-application.log

-

-rwxrwxr--. 1 root root 6.1K Sep 27 10:46 my-application_server.json

实际操作执行命令修改ES所在目录的owner为ES账号,执行后通过命令重新查看owner信息,可以看到owner已经更新。

chown -R es:es /home/elasticsearch更新后的结果

-

[root@testmachine logs]# ls -lh

-

total 36M

-

-rw-rw-r--. 1 es es 48K Sep 27 10:58 gc.log

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:34 gc.log.00

-

-rwxrwxr--. 1 es es 2.3K Sep 15 11:34 gc.log.01

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:39 gc.log.02

-

-rwxrwxr--. 1 es es 2.3K Sep 15 11:39 gc.log.03

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:40 gc.log.04

-

-rwxrwxr--. 1 es es 2.3K Sep 15 11:41 gc.log.05

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:43 gc.log.06

-

-rwxrwxr--. 1 es es 38K Sep 15 11:44 gc.log.07

-

-rwxrwxr--. 1 es es 2.0K Sep 15 11:44 gc.log.08

-

-rwxrwxr--. 1 es es 3.4M Sep 18 09:15 gc.log.09

-

-rwxrwxr--. 1 es es 2.0K Sep 18 09:16 gc.log.10

-

-rwxrwxr--. 1 es es 13M Sep 21 11:04 gc.log.11

-

-rwxrwxr--. 1 es es 2.0K Sep 21 11:14 gc.log.12

-

-rwxrwxr--. 1 es es 2.7K Sep 21 11:14 gc.log.13

-

-rwxrwxr--. 1 es es 2.0K Sep 21 11:27 gc.log.14

-

-rwxrwxr--. 1 es es 20M Sep 26 21:25 gc.log.15

-

-rwxrwxr--. 1 es es 2.0K Sep 27 10:40 gc.log.16

-

-rwxrwxr--. 1 es es 2.7K Sep 27 10:40 gc.log.17

-

-rwxrwxr--. 1 es es 2.0K Sep 27 10:46 gc.log.18

-

-rwxrwxr--. 1 es es 2.5K Sep 27 10:46 gc.log.19

-

-rwxrwxr--. 1 es es 2.0K Sep 27 10:47 gc.log.20

-

-rwxrwxr--. 1 es es 94K Sep 27 10:51 gc.log.21

-

-rw-rw-r--. 1 es es 2.0K Sep 27 10:50 gc.log.22

-

-rw-rw-r--. 1 es es 61K Sep 27 10:53 gc.log.23

-

-rw-rw-r--. 1 es es 2.0K Sep 27 10:54 gc.log.24

-

-rwxrwxr--. 1 es es 8.8K Sep 16 01:23 my-application-2021-09-15-1.json.gz

-

-rwxrwxr--. 1 es es 6.4K Sep 16 01:23 my-application-2021-09-15-1.log.gz

-

-rwxrwxr--. 1 es es 1.1K Sep 17 01:23 my-application-2021-09-16-1.json.gz

-

-rwxrwxr--. 1 es es 876 Sep 17 01:23 my-application-2021-09-16-1.log.gz

-

-rwxrwxr--. 1 es es 1001 Sep 18 01:23 my-application-2021-09-17-1.json.gz

-

-rwxrwxr--. 1 es es 833 Sep 18 01:23 my-application-2021-09-17-1.log.gz

-

-rwxrwxr--. 1 es es 5.2K Sep 19 01:23 my-application-2021-09-18-1.json.gz

-

-rwxrwxr--. 1 es es 5.0K Sep 19 01:23 my-application-2021-09-18-1.log.gz

-

-rwxrwxr--. 1 es es 821 Sep 20 01:23 my-application-2021-09-19-1.json.gz

-

-rwxrwxr--. 1 es es 663 Sep 20 01:23 my-application-2021-09-19-1.log.gz

-

-rwxrwxr--. 1 es es 1.6K Sep 21 00:12 my-application-2021-09-20-1.json.gz

-

-rwxrwxr--. 1 es es 1.3K Sep 21 00:12 my-application-2021-09-20-1.log.gz

-

-rwxrwxr--. 1 es es 16K Sep 22 01:23 my-application-2021-09-21-1.json.gz

-

-rwxrwxr--. 1 es es 15K Sep 22 01:23 my-application-2021-09-21-1.log.gz

-

-rwxrwxr--. 1 es es 504 Sep 23 01:23 my-application-2021-09-22-1.json.gz

-

-rwxrwxr--. 1 es es 360 Sep 23 01:23 my-application-2021-09-22-1.log.gz

-

-rwxrwxr--. 1 es es 502 Sep 24 01:23 my-application-2021-09-23-1.json.gz

-

-rwxrwxr--. 1 es es 357 Sep 24 01:23 my-application-2021-09-23-1.log.gz

-

-rwxrwxr--. 1 es es 501 Sep 25 01:23 my-application-2021-09-24-1.json.gz

-

-rwxrwxr--. 1 es es 357 Sep 25 01:23 my-application-2021-09-24-1.log.gz

-

-rwxrwxr--. 1 es es 504 Sep 26 01:23 my-application-2021-09-25-1.json.gz

-

-rwxrwxr--. 1 es es 358 Sep 26 01:23 my-application-2021-09-25-1.log.gz

-

-rwxrwxr--. 1 es es 509 Sep 27 10:40 my-application-2021-09-26-1.json.gz

-

-rwxrwxr--. 1 es es 364 Sep 27 10:40 my-application-2021-09-26-1.log.gz

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_audit.json

-

-rwxrwxr--. 1 es es 6.2K Sep 22 09:44 my-application_deprecation.json

-

-rwxrwxr--. 1 es es 3.0K Sep 22 09:44 my-application_deprecation.log

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_indexing_slowlog.json

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_indexing_slowlog.log

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_search_slowlog.json

-

-rwxrwxr--. 1 es es 0 Sep 15 11:43 my-application_index_search_slowlog.log

-

-rwxrwxr--. 1 es es 5.4K Sep 27 10:46 my-application.log

-

-rwxrwxr--. 1 es es 6.1K Sep 27 10:46 my-application_server.json

切换到ES账号下重新启动ES,root账号下会报下面的error

-

[root@testmachine logs]# /home/elasticsearch/bin/elasticsearch -d

-

[root@testmachine logs]# uncaught exception in thread [main]

-

java.lang.RuntimeException: can not run elasticsearch as root

-

at org.elasticsearch.bootstrap.Bootstrap.initializeNatives(Bootstrap.java:101)

-

at org.elasticsearch.bootstrap.Bootstrap.setup(Bootstrap.java:168)

-

at org.elasticsearch.bootstrap.Bootstrap.init(Bootstrap.java:397)

-

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:159)

-

at org.elasticsearch.bootstrap.Elasticsearch.execute(Elasticsearch.java:150)

-

at org.elasticsearch.cli.EnvironmentAwareCommand.execute(EnvironmentAwareCommand.java:75)

-

at org.elasticsearch.cli.Command.mainWithoutErrorHandling(Command.java:116)

-

at org.elasticsearch.cli.Command.main(Command.java:79)

-

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:115)

-

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:81)

-

For complete error details, refer to the log at /home/elasticsearch/logs/my-application.log

-

2021-09-27 02:59:01,062359 UTC [1885] INFO Main.cc@106 Parent process died - ML controller exiting

切换ES账号,执行ES启动,问题成功解决。

-

su es

-

/home/elasticsearch/bin/elasticsearch -dchown es:es /ect/elasticsearch /ect/sysconf^ /var/lib/es /var/log/es

浙公网安备 33010602011771号

浙公网安备 33010602011771号