scrapy框架简介和基础应用

阅读目录:

一.什么是Scrapy?

Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架,非常出名,非常强悍。所谓的框架就是一个已经被集成了各种功能(高性能异步下载,队列,分布式,解析,持久化等)的具有很强通用性的项目模板。对于框架的学习,重点是要学习其框架的特性、各个功能的用法即可。

二.安装

Linux:

pip3 install scrapy

Windows: 以下五部必须都要安装

a. pip3 install wheel

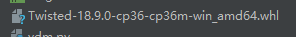

b. 下载twisted http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted

c. 进入下载目录,执行 pip3 install Twisted‑17.1.0‑cp35‑cp35m‑win_amd64.whl

d. pip3 install pywin32

e. pip3 install scrapy

三.基础使用

1.创建项目:scrapy startproject 项目名称 需要在cmd中进行创建

项目结构:

scrapy.cfg 项目的主配置信息。(真正爬虫相关的配置信息在settings.py文件中)

items.py 设置数据存储模板,用于结构化数据,如:Django的Model

pipelines 数据持久化处理

settings.py 配置文件,如:递归的层数、并发数,延迟下载等

spiders 爬虫目录,如:创建文件,编写爬虫解析规则 #爬虫文件夹

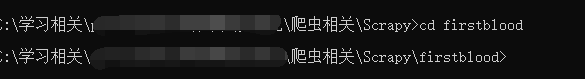

cd project_name(进入项目目录)

创建爬虫文件: scrapy genspider 应用名称 爬取网页的起始url(#后期可以修改)

(例如:scrapy genspider qiubai www.qiushibaike.com)

3.编写爬虫文件:在步骤2执行完毕后,会在项目的spiders中生成一个应用名的py爬虫文件,文件源码如下:

# -*- coding: utf-8 -*- import scrapy class FirstSpider(scrapy.Spider): #爬虫文件的名称,就是爬虫文件的一个唯一标识 name = 'first' #允许的域名,一般情况下会进行注释 # allowed_domains = ['www.yuyu.com'] #起始url列表,只要在这个列表中的URL都会被scrapy这个框架自动的发起请求发送 start_urls = ['https://www.baidu.com/','https://www.sogou.com/'] #parse方法会进行数据的解析 def parse(self, response): print(response)

4.设置修改settings.py配置文件相关配置:

修改内容及其结果如下: 19行:USER_AGENT = 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_0) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36' #伪装请求载体身份 22行:ROBOTSTXT_OBEY = False #可以忽略或者不遵守robots协议

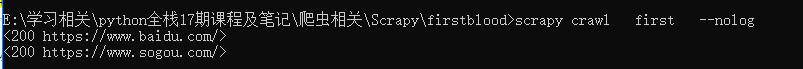

5.执行爬虫程序:scrapy crawl 应用名称 (爬虫文件名称)

scrapy crawl first --nolog (可以忽略打印日志) #不建议使用这种方法,看不到日志信息

基于糗百文字的爬取

# -*- coding: utf-8 -*- import scrapy class FirstSpider(scrapy.Spider): #爬虫文件的名称,就是爬虫文件的一个唯一标识 name = 'first' #允许的域名,一般情况下会进行注释 # allowed_domains = ['www.yuyu.com'] #起始url列表,只要在这个列表中的URL都会被scrapy这个框架自动的发起请求发送 start_urls = ['https://www.qiushibaike.com/text/'] #parse方法会进行数据的解析 def parse(self, response): div_list = response.xpath('//div[@id="content-left"]/div') names=[] for div in div_list: #特性:xpath 返回的列表元素一定是Selector对象,使用extract()就可以获取Selector中data的数据 # author=div.xpath('./div[1]/a[2]/h2/text()')[0].extract() #第一种方式 author=div.xpath('./div[1]/a[2]/h2/text()').extract_first() #第二种方式 #在基于终端指令进行持久化存储的时候必须将解析到的数据封装到字典中 dic ={ "name":author } names.append(dic) return names

基于终端指令:只可以将parse方法的返回值存储到磁盘文件中

scrapy crawl 爬虫名称(first) -o xxx.csv

浙公网安备 33010602011771号

浙公网安备 33010602011771号