论文信息

论文标题:Generalized Domain Adaptation with Covariate and Label Shift CO-ALignment

论文作者:Shuhan Tan, Xingchao Peng, Kate Saenko

论文来源:ICLR 2020

论文地址:download

论文代码:download

视屏讲解:click

1 摘要

提出问题:标签偏移;

解决方法:

原型分类器模拟类特征分布,并使用 Minimax Entropy 实现条件特征对齐;

使用高置信度目标样本伪标签实现标签分布修正;

2 介绍

2.1 当前工作

假设条件标签分布不变 ,只有特征偏移 ,忽略标签偏移 。

假设不成立的原因:

-

- 场景不同,标签跨域转移 很常见;

- 如果存在标签偏移,则当前的 UDA 工作性能显著下降;

- 一个合适的 UDA 方法应该能同时处理协变量偏移和标签偏移;

2.2 本文工作

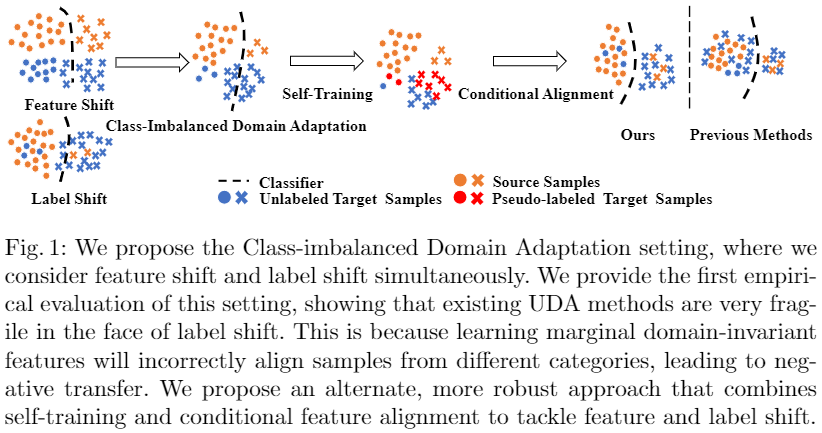

本文提出类不平衡域适应 (CDA),需要同时处理 条件特征转移 和 标签转移。

具体来说,除了协变量偏移假设 , ,进一步假设 和 。

CDA 的主要挑战:

-

- 标签偏移阻碍了主流领域自适应方法的有效性,这些方法只能边缘对齐特征分布;

- 在存在标签偏移的情况下,对齐条件特征分布 , 很困难;

- 当一个或两个域中的数据在不同类别中分布不均时,很难训练无偏分类器;

CDA 概述:

3 问题定义

In Class-imbalanced Domain Adaptation, we are given a source domain with labeled examples, and a target domain with unlabeled examples. We assume that but , , and . We aim to construct an end-to-end deep neural network which is able to transfer the knowledge learned from to , and train a classifier which can minimize task risk in target domain .

4 方法

4.1 整体框架

4.2 用于特征转移的基于原型的条件对齐

目的:对齐 和

步骤:首先使用原型分类器(基于相似度)估计 ,然后使用一种 算法将其和 对齐;

4.2.1 原型分类器

原因:基于原型的分类器在少样本学习设置中表现良好,因为在标签偏移的假设下中,某些类别的设置频率可能较低;

# 深层原型分类器

class Predictor_deep_latent(nn.Module):

def __init__(self, in_dim = 1208, num_class = 2, temp = 0.05):

super(Predictor_deep_latent, self).__init__()

self.in_dim = in_dim

self.hid_dim = 512

self.num_class = num_class

self.temp = temp #0.05

self.fc1 = nn.Linear(self.in_dim, self.hid_dim)

self.fc2 = nn.Linear(self.hid_dim, num_class, bias=False)

def forward(self, x, reverse=False, eta=0.1):

x = self.fc1(x)

if reverse:

x = GradReverse.apply(x, eta)

feat = F.normalize(x)

logit = self.fc2(feat) / self.temp

return feat, logit

源域上的样本使用交叉熵做监督训练:

样本 被分类为 类的置信度越高, 的嵌入越接近 。因此,在优化上式时,通过将每个样本 的嵌入更接近其在 中的相应权重向量来减少类内变化。所以,可以将 视为 的代表性数据点(原型) 。

4.2.2 通过 Minimax Entropy 实现条件对齐

目标域缺少数据标签,所以使用 获得类原型是不可行的;

解决办法:

-

- 将每个源原型移动到更接近其附近的目标样本;

- 围绕这个移动的原型聚类目标样本;

因此,提出 熵极小极大 实现上述两个目标。

具体来说,对于输入网络的每个样本 ,可以通过下式计算分类器输出的平均熵

通过在对抗过程中对齐源原型和目标原型来实现条件特征分布对齐:

-

- 训练 以最大化 ,旨在将原型从源样本移动到邻近的目标样本;

- 训练 来最小化 ,目的是使目标样本的嵌入更接近它们附近的原型;

4.3 标签转移的类平衡自训练

由于源标签分布 与目标标签分布 不同,因此不能保证在 上具有低风险的分类器 在 上具有低错误。 直观地说,如果分类器是用不平衡的源数据训练的,决策边界将由训练数据中最频繁的类别主导,导致分类器偏向源标签分布。 当分类器应用于具有不同标签分布的目标域时,其准确性会降低,因为它高度偏向源域。

为解决这个问题,本文使用[19]中的方法进行自我训练来估计目标标签分布并细化决策边界。自训练为了细化决策边界,本文建议通过自训练来估计目标标签分布。 我们根据分类器 的输出将伪标签 分配给所有目标样本。由于还对齐条件特征分布 和 ,假设分布高置信度伪标签 可以用作目标域的真实标签分布 的近似值。 在近似的目标标签分布下用这些伪标记的目标样本训练 ,能够减少标签偏移的负面影响。

为了获得高置信度的伪标签,对于每个类别,本文选择属于该类别的具有最高置信度分数的目标样本的前 。利用 中的最高概率作为分类器对样本 的置信度。 具体来说,对于每个伪标记样本 ,如果 位于具有相同伪标签的所有目标样本的前 中,将其选择掩码设置为 ,否则 。将伪标记目标集表示为 ,利用来自 的输入和伪标签来训练分类器 ,旨在细化决策 与目标标签分布的边界。 分类的总损失函数为:

通常,用 初始化 ,并设置 ,。

Note:本文还对源域数据使用了平衡采样的方法,使得分类器不会偏向于某一类。

4.4 训练目标

总体目标:

5 总结

略

因上求缘,果上努力~~~~ 作者:别关注我了,私信我吧,转载请注明原文链接:https://www.cnblogs.com/BlairGrowing/p/17332967.html

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 分享一个免费、快速、无限量使用的满血 DeepSeek R1 模型,支持深度思考和联网搜索!

· 基于 Docker 搭建 FRP 内网穿透开源项目(很简单哒)

· ollama系列1:轻松3步本地部署deepseek,普通电脑可用

· 按钮权限的设计及实现

· 【杂谈】分布式事务——高大上的无用知识?

2020-04-19 三角函数

2020-04-19 迷宫3---BFS

2020-04-19 迷宫2----BFS