迁移学习《Asymmetric Tri-training for Unsupervised Domain Adaptation》

论文信息

论文标题:Asymmetric Tri-training for Unsupervised Domain Adaptation

论文作者:Kuniaki Saito, Y. Ushiku, T. Harada

论文来源:27 February 2017——ICML

论文地址:download

论文代码:download

视屏讲解:click

1 介绍

简单的域分布对齐可能无法提供有效的判别表示,为学习目标域的判别表示,本文假设人工标记目标样本可以产生良好的表示。

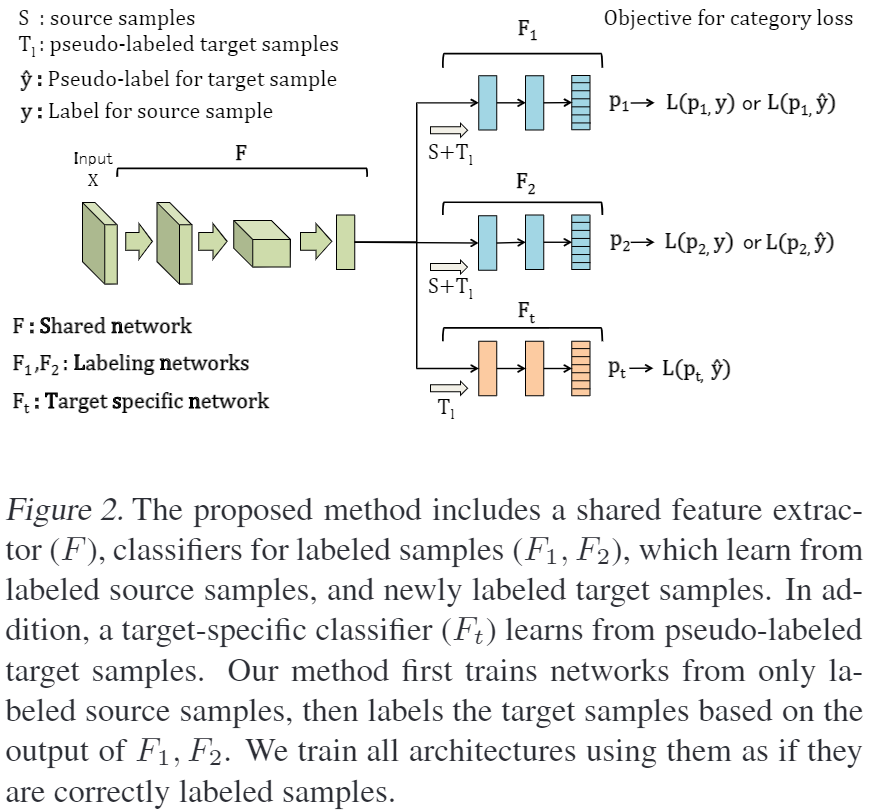

在本文中,提出了一种用于无监督域适应的非对称三重训练方法,将伪标签分配给未标记的样本,并像训练真实标签一样训练神经网络。 本文工作,不对称地使用三个网络。 不对称是指两个网络用于标记未标记的目标样本,一个网络由样本训练以获得目标判别表示。

2 相关工作

[1] 研究了伪标签在神经网络中的作用。他们认为,使用伪标签训练分类器的效果等同于熵正则化,从而导致类之间的低密度分离。

3 方法

算法伪代码:

为使 $F_{1}$, $F_{2}$ 从不同视角分类样本,将分类器权重 $\left|W_{1}^{T} W_{2}\right|$ 考虑到损失函数:

$E\left(\theta_{F}, \theta_{F_{1}}, \theta_{F_{2}}\right)=\frac{1}{n} \sum_{i=1}^{n}\left[L_{y}\left(F_{1} \circ F\left(x_{i}\right), y_{i}\right)+L_{y}\left(F_{2} \circ F\left(x_{i}\right), y_{i}\right)\right]+\lambda\left|W_{1}^{T} W_{2}\right| \quad\quad\quad(1)$

伪代码主要分为两部分:

-

- 第一部分:使用训练集训练整个网络,$F_{1}$, $F_{2}$ 使用 $\text{Eq.1}$ 优化,$F_{t}$ 使用标准的分类损失训练;

- 第二部分:为目标域样本提供伪标签,要求1:$F_{1}$, $F_{2}$ 的预测类别相同;要求2:$F_{1}$, $F_{2}$ 预测的概率大于 $0.9$ 或 $0.95$;

为防止过拟合得到伪标签,重采样参与的伪标签样本。设置 $N_{\text {init }}=5000$ ,然后逐步增 加参与的数量 $N_{t}=k / 20 * n$ , $n$ 为所有目标域样本数量。设置参与训练的价标签样本最大数量为 $40000$。

通过构建仅在目标域样本上训练的特定于目标域的网络,将学习判别性表示。但是仅使用有噪声的伪标签样本训练,网络可能无法学习有用的表示。然后我们使用源域和伪标签样本训练三个分类器以保证准确率。同随着训练, $F$ 将学习目标域判别性表示,使分类器 $F_{1}$, $F_{2}$ 的正确率提升。这个周期逐渐增强目标域上的准确率。

[1] Lee, Dong-Hyun. Pseudo-label: The simple and efficient semi-supervised learning method for deep neural networks. In ICML workshop on Challenges in Representation Learning, 2013.

因上求缘,果上努力~~~~ 作者:别关注我了,私信我吧,转载请注明原文链接:https://www.cnblogs.com/BlairGrowing/p/17291334.html

浙公网安备 33010602011771号

浙公网安备 33010602011771号