智谱开源 CogAgent-9B,让 AI「看懂」屏幕;Anthropic:大多数任务无需复杂 AI 智能体

开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement) 领域内「有话题的 新闻 」、「有态度的 观点 」、「有意思的 数据 」、「有思考的 文章 」、「有看点的 会议 」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@SSN,@鲍勃

01有话题的新闻

1、智谱开源 GLM-PC 基座模型 CogAgent-9B,让 AI 智能体「看懂」屏幕

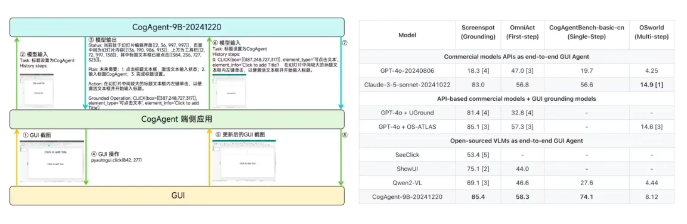

智谱技术团队公众号昨日(12 月 26 日)发布博文,宣布开源 GLM-PC 的基座模型 CogAgent-9B-20241220,基于 GLM-4V-9B 训练,专用于智能体(Agent)任务。

据报道,该模型仅需屏幕截图作为输入(无需 HTML 等文本表征),便能根据用户指定的任意任务,结合历史操作,预测下一步的 GUI 操作。

得益于屏幕截图和 GUI 操作的普适性,CogAgent 可广泛应用于各类基于 GUI 交互的场景,如个人电脑、手机、车机设备等。

相较于 2023 年 12 月开源的第一版 CogAgent 模型,CogAgent-9B-20241220 在 GUI 感知、推理预测准确性、动作空间完善性、任务普适性和泛化性等方面均实现了显著提升,并支持中英文双语的屏幕截图和语言交互。

CogAgent 的输入仅包含三部分:用户的自然语言指令、已执行历史动作记录和 GUI 截图,无需任何文本形式表征的布局信息或附加元素标签(set of marks)信息。

其输出涵盖以下四个方面:

-

思考过程(Status & Plan): CogAgent 显式输出理解 GUI截图和决定下一步操作的思考过程,包括状态(Status)和计划(Plan)两部分,输出内容可通过参数控制。

-

下一步动作的自然语言描述(Action): 自然语言形式的动作描述将被加入历史操作记录,便于模型理解已执行的动作步骤。

-

下一步动作的结构化描述(Grounded Operation): CogAgent 以类似函数调用的形式,结构化地描述下一步操作及其参数,便于端侧应用解析并执行模型输出。其动作空间包含 GUI 操作(基础动作,如左键单击、文本输入等)和拟人行为(高级动作,如应用启动、调用语言模型等)两类。

-

下一步动作的敏感性判断: 动作分为「一般操作」和「敏感操作」两类,后者指可能带来难以挽回后果的动作,例如在「发送邮件」任务中点击「发送」按钮。

CogAgent-9B-20241220 在 Screenspot、OmniAct、CogAgentBench-basic-cn 和 OSWorld 等数据集上进行了测试,并与 GPT-4o-20240806、Claude-3.5-Sonnet、Qwen2-VL、ShowUI、SeeClick 等模型进行了比较。

结果显示,CogAgent 在多个数据集上取得了领先的结果,证明了其在 GUI Agent 领域强大的性能。(@IT 之家)

2、OpenAI 服务器「跳闸」

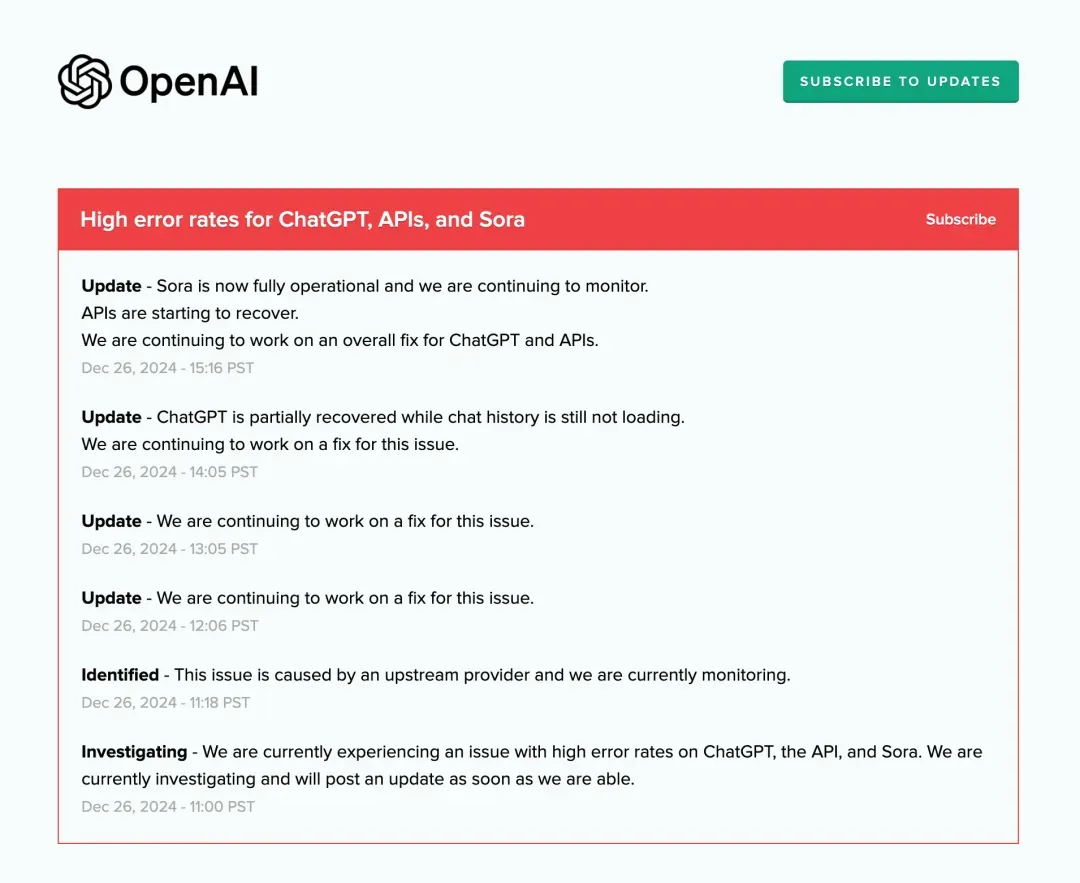

今天凌晨,据网友和媒体发现,OpenAI 的 AI 服务器发生故障,本次系统服务中断于北京时间 12 月 27 日凌晨 2 点 30 分左右开始,影响了 ChatGPT 聊天机器人、Sora 视频生成模型以及部分 API 调用。

据了解,北京时间今天凌晨 3 点 OpenAI 官网发布动态,称 ChatGPT、API 及其文本到视频生成器 Sora「目前错误率很高」。随后于北京时间早上 6 点 05 分,OpenAI 宣布「ChatGPT 已恢复部分服务」,但聊天历史记录仍然无法加载,修复工作仍在进行中。

此次服务中断原因,OpenAI 并未说明具体原因,只表示「此问题是由上游提供商引起」。据悉,作为 OpenAI 的独家云服务提供商,微软 Azure 今天也报告数据中心出现「电源」问题,因此可以初步判断,微软数据中心电力故障或是罪魁祸首。

目前,OpenAI 发文称 Sora 与 API 已恢复正常使用。(@APPSO)

3、消息称微软及阿里「老兵」胡云华加入智谱,将任「智谱清言」负责人

据报道,前微软亚洲研究院研究员、阿里达摩院资深技术专家、支付宝中国首席数据官胡云华现已加入大模型独角兽公司智谱,并担任 C 端应用「智谱清言」负责人。

胡云华 2016 年成立「智能一点」公司。该公司一年多时间内拿下四轮融资,主要聚焦于售前智能客服等电商人工智能导购解决方案。

智谱清言此前的负责人偏重技术背景,也让智谱清言快速集成模型功能,如视频生成、视频通话和情感语音等。目前智谱清言拥有超过 2500 万用户、预计年收入超过千万元。但随着多个大厂下场、对话工具型产品竞争加剧,智谱清言的增长已经过了新技术驱动获客的阶段。靠不断集成模型功能,对扩大用户规模和提高留存的作用正在减小。(@IT 之家)

02有亮点的产品

1、可灵 AI 深夜放大招!悄悄上线 AI 模特功能

可灵 AI 的生图模型「可图」在深夜进行了重大升级,不仅加强了语义理解能力,还大幅提升了真人效果,尤其对亚洲人像的适配性极佳,审美也得到了显著提升。据称,可图 1.5 版本被认为是目前制作亚洲人形象最为出色的 AI 模型之一。

更引人注目的是,基于可图 1.5 的新功能——AI 模特。它与可灵 1.6 的图生视频功能相结合,用户可以通过可图的「AI 试衣」界面访问 AI 模特功能和 AI 换装功能,通过简单的设置(如性别、年龄、肤色),即可快速生成高质量的 AI 模特图。即使是 AI 新手,也能轻松上手,可灵还提供了「推荐尝试」词条,几乎实现了一键生成。

生成的 AI 模特图不仅速度快,还具备全球化视角,肤色的选择直接影响人种,这在传统模式下,外籍模特成本高昂的背景下,显得尤为重要。可灵在年龄和人种的区分上表现出色,能够精准捕捉不同群体的特点。

AI 模特功能的最大亮点在于,它与 AI 换衣工作流的无缝整合。用户生成的 AI 模特可以直接用于 AI 换衣,无需保存到本地,即可在后续换衣流程中重复使用,极大地提升了操作的便捷性。

并且结合 AI 视频功能,一个模特可以动态展示服装,甚至在几分钟内生成高质量的动态视频。(@AIbase 基地)

2、理想汽车旗下 AI 应用理想同学 App 正式上线 内容由 Mind GPT-3o 生成

理想汽车开发的人工智能应用——理想同学 App 已正式在苹果 App Store 和小米应用商店上架,iOS 版本应用大小约为 91MB,而安卓版本则约为 81MB。这款应用依托于理想汽车自研的大模型,提供了丰富的智能交互功能。

经过测试,用户可以直接与理想同学进行交流,包括识物、知识问答、长英文词句翻译和文本生成等。在视频功能中,理想同学展现出其视觉感知能力,支持实时画面询问和拍摄询问,语音交互流畅自然,回复内容由人工智能 Mind GPT-3o 生成。(@AIbase 基地)

3、小米澎湃 OS 2 AI 助手超级小爱将首次向正式版用户开放

在即将到来的年度总结直播中,小米总裁卢伟冰将重点介绍小米澎湃 OS2 的最新更新。此次更新标志着澎湃 OS2 发布后的首次重大版本升级,其中最引人注目的是超级小爱功能的首次向正式版用户开放。卢伟冰透露,更新将分批进行,针对不同机型进行适配和推送,预计在今晚的直播中将公布具体的升级计划。

超级小爱是此次澎湃 OS2 更新的重大亮点之一,作为小爱同学的超级 AI 进化版,超级小爱致力于打造一个全生态的 AI 智能助手。小米对超级小爱的界面 UI 进行了全面重塑,使其能与系统界面无缝融合,用户可以在任意页面唤醒超级小爱并进行交流。

超级小爱具备记忆能力,能够作为用户的私人备忘录,帮助记录收藏、日程和杂事。通过与用户的频繁互动,超级小爱还能记住用户的个人偏好。在安全方面,超级小爱的所有数据均已实现端到端加密,用户可以随时查看小爱记忆,也可以选择清空记忆。小米基于 MITEE3.0、数据权限体系、机密计算技术,确保了云端全链路用户数据的安全和可控性。(@AIbase 基地)

03有态度的观点

1、Anthropic:大多数任务无需复杂 AI 智能体

根据 AI 公司 Anthropic 的最新分析发现,在实际应用中,使用 AI 智能体而非简单提示的场景并不常见。Anthropic 在工作流程(代码协调 AI 模型和工具)和智能体(独立控制自身流程)之间划出了一条清晰的界限。

虽然 AI 智能体能够处理复杂和开放式的任务,但它们也需要更多的监管和计算能力。Anthropic 建议从基本提示开始,并且只在绝对必要时增加复杂性。尽管开发框架可以帮助团队开始使用智能体,但在生产环境中,更简单的方法往往更有效。

对于考虑使用 AI 智能体的团队,Anthropic 推荐关注三个关键领域:保持设计简单、使流程透明以及精心设计用户界面。该公司认为,在客户服务和软件开发任务中,智能体的潜力最大。

在追求 AI 技术的高级应用时,不应忽视简单解决方案的有效性。在许多情况下,一个精心设计的提示可能比一个复杂的 AI 智能体更加实用和经济。这种思路有助于企业在 AI 应用上做出更明智的选择,避免不必要的资源浪费,同时实现业务目标。(@AIbase 基地)

2、理想汽车 CEO 李想预言:人工智能最终形态是「硅基家人」

理想汽车 CEO 李想在 2024 理想 AI Talk 访谈中,对人工智能的未来发展提出了大胆设想。他认为,人工智能(AGI)的发展将分为三个阶段,最终形态将是「硅基家人」,这将深刻改变人类的生活方式。

首先,AGI 的第一阶段是「增强我的能力」,在这个阶段,人工智能作为辅助工具,提高我们的效率和便利性,但决策权仍在人类手中。例如,L3 级别的自动驾驶需要驾驶员监督,人类承担最终责任。

第二阶段,AGI 将成为「我的助手」,能够独立完成任务并对结果负责。李想举例说,L4 级别的自动驾驶汽车可以独立去学校接孩子,进行面部识别让孩子上车,标志着人工智能的大规模应用。

最终,第三阶段的 AGI 将变成「硅基家人」,无需人类指示,就能主动管理家庭事务,成为家庭的重要组织者。李想强调,这不仅是技术的进步,更是人类记忆的延续,即使肉体消失,记忆也能通过 AGI 得以保存。

李想表示,他和团队有望在有生之年实现这一愿景,这将是人类历史上的一大步。(@AIbase 基地)

更多 Voice Agent 学习笔记:

对话谷歌 Project Astra 研究主管:打造通用 AI 助理,主动视频交互和全双工对话是未来重点

这家语音 AI 公司新融资 2700 万美元,并预测了 2025 年语音技术趋势

Gemini 2.0 来了,这些 Voice Agent 开发者早已开始探索……

帮助用户与 AI 实时练习口语,Speak 为何能估值 10 亿美元?丨Voice Agent 学习笔记

2024 语音模型前沿研究整理,Voice Agent 开发者必读

从开发者工具转型 AI 呼叫中心,这家 Voice Agent 公司已服务 100+客户

WebRTC 创建者刚加入了 OpenAI,他是如何思考语音 AI 的未来?

人类级别语音 AI 路线图丨 Voice Agent 学习笔记

写在最后:

我们欢迎更多的小伙伴参与「RTE 开发者日报」内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻

浙公网安备 33010602011771号

浙公网安备 33010602011771号