【Python之路】第二十四篇--爬虫

网络爬虫(又被称为网页蜘蛛,网络机器人,在FOAF社区中间,更经常的称为网页追逐者),是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本。另外一些不常使用的名字还有蚂蚁、自动索引、模拟程序或者蠕虫。

Requests 👉官方文档

Python标准库中提供了:urllib、urllib2、httplib等模块以供Http请求,但是,它的 API 太渣了。它是为另一个时代、另一个互联网所创建的。它需要巨量的工作,甚至包括各种方法覆盖,来完成最简单的任务。

Requests 是使用 Apache2 Licensed 许可证的 基于Python开发的HTTP 库,其在Python内置模块的基础上进行了高度的封装,从而使得Pythoner进行网络请求时,变得美好了许多,使用Requests可以轻而易举的完成浏览器可有的任何操作。

1、GET请求

# 1、无参数实例

import requests

ret = requests.get('https://github.com/timeline.json')

print(ret.url)

print(ret.text)

# 2、有参数实例

import requests

payload = {'key1': 'value1', 'key2': 'value2'}

ret = requests.get("http://httpbin.org/get", params=payload)

print(ret.url)

print(ret.text)

2、POST请求

# 1、基本POST实例

import requests

payload = {'key1': 'value1', 'key2': 'value2'}

ret = requests.post("http://httpbin.org/post", data=payload)

print(ret.text)

# 2、发送请求头和数据实例

import requests

import json

url = 'https://api.github.com/some/endpoint'

payload = {'some': 'data'}

headers = {'content-type': 'application/json'}

ret = requests.post(url, data=json.dumps(payload), headers=headers)

print(ret.text)

print(ret.cookies)

3、其他请求

requests.get(url, params=None, **kwargs) requests.post(url, data=None, json=None, **kwargs) requests.put(url, data=None, **kwargs) requests.head(url, **kwargs) requests.delete(url, **kwargs) requests.patch(url, data=None, **kwargs) requests.options(url, **kwargs) # 以上方法均是在此方法的基础上构建 requests.request(method, url, **kwargs)

4、响应内容

Requests 会自动解码来自服务器的内容。大多数 unicode 字符集都能被无缝地解码。

请求发出后,Requests 会基于 HTTP 头部对响应的编码作出有根据的推测。

当你访问 r.text 之时,Requests 会使用其推测的文本编码。你可以找出 Requests 使用了什么编码,并且能够使用 r.encoding 属性来改变它:

response.encoding = 'ISO-8859-1'

以字节的方式访问请求响应体

response.content

- response.url

- response.encoding 编码

- response.status_code 状态吗

- response.headers headers

- response.text 返回的文本

- response.json() json

- response.raw 原始数据

- response.raise_for_status() 错误请求信息

- response.cookies

- response.history

5、Cookie

设置cookies:

requests.get('http://www.google.com/', cookies={'key1': 'value1', 'key2': 'value2'})

如果使用Session的话,可以这样设置

session = requests.session()

cookies_dict = {'key1': 'value1', 'key2': 'value2'}

session.cookies = requests.utils.cookiejar_from_dict(cookies)

保存Cookies:

cookies_dict = requests.utils.dict_from_cookiejar(session.cookies)

普通方式:

import requests

response = requests.get('http://www.baidu.com')

cookies = response.cookies

# 字典形式存储

cookies_dict = response.cookies.get_dict()

另外提供一个Chrome浏览器中的Cookies字符串转字典的函数

def cookie_dict_form_text(cookie_text): cookies = {} for cookie_unit_text in cookie_text.split('; '): cookie_unit = cookie_unit_text.split('=') if len(cookie_unit) >= 2: cookies[cookie_unit[0]] = cookie_unit[1] return cookies

6、会话对象Session

会话对象让你能够跨请求保持某些参数。它也会在同一个 Session 实例发出的所有请求之间保持 cookie,

conn = requests.session()

r = conn.get('http://dig.chouti.com/')

print(r.request.headers)

r = conn.get('http://dig.chouti.com/')

print(r.request.headers)

#{'User-Agent': 'python-requests/2.12.4', 'Connection': 'keep-alive', 'Accept': '*/*', 'Accept-Encoding': 'gzip, deflate'}

#{'User-Agent': 'python-requests/2.12.4', 'Connection': 'keep-alive', 'Accept': '*/*', 'Accept-Encoding': 'gzip, deflate', 'Cookie': 'gpsd=6392a33cd7960ef59be44158c19f58f8; route=e7bfb38cb3b5a04758a9513df6738c7e; JSESSIONID=aaaZZDnAXDsv6eA-7rHTv'}

在第二次访问时,已经自动添加上了cookies

7、py2版本下乱码问题

response.content.decode("utf8","ignore").encode("gbk","ignore") 就不会有乱码了

这里所使用的ignore属性意思是忽略其中有异常的编码,仅显示有效的编码。py2下乱码问题可以参考 👉点我

8、使用代理proxies

import requests

proxies = { "http": "http://10.10.1.10:3128", "https": "http://10.10.1.10:1080", }

requests.get("http://example.org", proxies=proxies)

这里的可以通过ip测试网站进行验证是否成功使用了代理 http://ip.chinaz.com/(查看你访问后的网站的您的IP是多少来判断)

9、其他

requests模块已经将常用的Http请求方法为用户封装完成,用户直接调用其提供的相应方法即可,其中方法的所有参数有:

def request(method, url, **kwargs): """Constructs and sends a :class:`Request <Request>`. :param method: method for the new :class:`Request` object. :param url: URL for the new :class:`Request` object. :param params: (optional) Dictionary or bytes to be sent in the query string for the :class:`Request`. :param data: (optional) Dictionary, bytes, or file-like object to send in the body of the :class:`Request`. :param json: (optional) json data to send in the body of the :class:`Request`. :param headers: (optional) Dictionary of HTTP Headers to send with the :class:`Request`. :param cookies: (optional) Dict or CookieJar object to send with the :class:`Request`. :param files: (optional) Dictionary of ``'name': file-like-objects`` (or ``{'name': ('filename', fileobj)}``) for multipart encoding upload. :param auth: (optional) Auth tuple to enable Basic/Digest/Custom HTTP Auth. :param timeout: (optional) How long to wait for the server to send data before giving up, as a float, or a :ref:`(connect timeout, read timeout) <timeouts>` tuple. :type timeout: float or tuple :param allow_redirects: (optional) Boolean. Set to True if POST/PUT/DELETE redirect following is allowed. :type allow_redirects: bool :param proxies: (optional) Dictionary mapping protocol to the URL of the proxy. :param verify: (optional) whether the SSL cert will be verified. A CA_BUNDLE path can also be provided. Defaults to ``True``. :param stream: (optional) if ``False``, the response content will be immediately downloaded. :param cert: (optional) if String, path to ssl client cert file (.pem). If Tuple, ('cert', 'key') pair. :return: :class:`Response <Response>` object :rtype: requests.Response Usage:: >>> import requests >>> req = requests.request('GET', 'http://httpbin.org/get') <Response [200]> """ # By using the 'with' statement we are sure the session is closed, thus we # avoid leaving sockets open which can trigger a ResourceWarning in some # cases, and look like a memory leak in others. with sessions.Session() as session: return session.request(method=method, url=url, **kwargs)

更多requests模块相关的文档见:http://cn.python-requests.org/zh_CN/latest/

Scrapy

Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架。 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中。

其最初是为了页面抓取 (更确切来说, 网络抓取 )所设计的, 也可以应用在获取API所返回的数据(例如 Amazon Associates Web Services ) 或者通用的网络爬虫。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试。

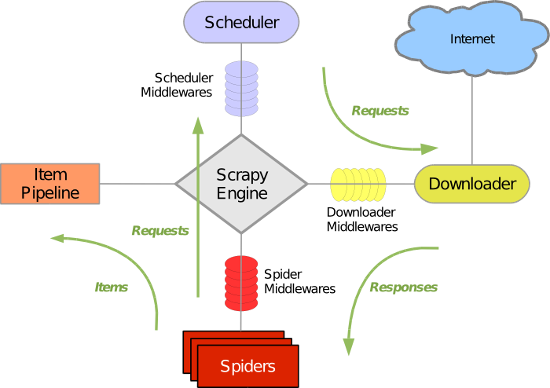

Scrapy 使用了 Twisted异步网络库来处理网络通讯。整体架构大致如下

Scrapy主要包括了以下组件:

- 引擎(Scrapy)

用来处理整个系统的数据流处理, 触发事务(框架核心) - 调度器(Scheduler)

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址 - 下载器(Downloader)

用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy下载器是建立在twisted这个高效的异步模型上的) - 爬虫(Spiders)

爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面 - 项目管道(Pipeline)

负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。 - 下载器中间件(Downloader Middlewares)

位于Scrapy引擎和下载器之间的框架,主要是处理Scrapy引擎与下载器之间的请求及响应。 - 爬虫中间件(Spider Middlewares)

介于Scrapy引擎和爬虫之间的框架,主要工作是处理蜘蛛的响应输入和请求输出。 - 调度中间件(Scheduler Middewares)

介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy运行流程大概如下:

-

引擎从调度器中取出一个链接(URL)用于接下来的抓取

-

引擎把URL封装成一个请求(Request)传给下载器

-

下载器把资源下载下来,并封装成应答包(Response)

-

爬虫解析Response

-

解析出实体(Item),则交给实体管道进行进一步的处理

-

解析出的是链接(URL),则把URL交给调度器等待抓取

一、安装

1.安装 setuptools

setuptools 官网下载

python ez_setup.py

2.安装 pip

下载pip源码 官网下载,安装

python setup.py install

3.安装 scrapy

pip install requests pip install scrapy

windows下

安装依赖scrapy的组件

http://www.lfd.uci.edu/~gohlke/pythonlibs/,Ctrl+F搜索 lxml、Twisted、Scrapy,下载对应的版本,

例如:lxml-3.7.3-cp35-cp35m-win_adm64.whl,表示lxml的版本为3.7.3,对应的python版本为3.5-64bit。

a.pip3 install wheel

b.pip3 install lxml-3.7.3-cp35-cp35m-win_amd64.whl

c.pip3 install Twisted-17.1.0-cp35-cp35m-win_amd64.whl

d.pip3 install Scrapy-1.3.2-py2.py3-none-any.whl

Srapy已经安装成功,还要下载pywin32,找到对应版本下载,一路下一步安装即可。安装完成后,就可以正常使用Scrapy了。

URL:https://sourceforge.net/projects/pywin32/files/pywin32/Build%20220/

二、基本使用

1、创建项目

scrapy startproject your_project_name

自动创建目录:

project_name/

scrapy.cfg

project_name/

__init__.py

items.py

pipelines.py

settings.py

spiders/

__init__.py

文件说明:

-

scrapy.cfg 项目的配置信息,主要为Scrapy命令行工具提供一个基础的配置信息。(真正爬虫相关的配置信息在settings.py文件中)

-

items.py 设置数据存储模板,用于结构化数据,如:Django的Model

-

pipelines 数据处理行为,如:一般结构化的数据持久化

-

settings.py 配置文件,如:递归的层数、并发数,延迟下载等

-

spiders 爬虫目录,如:创建文件,编写爬虫规则

注意:一般创建爬虫文件时,以网站域名命名

2、基本选择器Selector

一个/ 表示根目录 //div[@class='item_list']/ //div[@class='item_list']/div 孩子 //div[@class='item_list']//div 子子孙孙 # 多属性匹配 /div[@class='item_list'][@id='a1']/ # 获取内容 //div[@class='item_list']//div/text() # 获取属性 //div[@class='item_list']//img/@src //a/@href # 索引方式 //div[@class='item_list']/div[1] 默认从第1个开始 //div[@class='item_list']/div[2]

正则表达式使用:

<body>

<li class="item-"><a href="link.html">first item</a></li>

<li class="item-0"><a href="link1.html">first item</a></li>

<li class="item-1"><a href="link2.html">second item</a></li>

</body>

类型一:

ret = Selector(response=response).xpath('//li[re:test(@class, "item-\d*")]//@href').extract()

类型二:

ret = Selector(response=response).xpath('//.select('div//a[1]').re('xx:(\w+)') # 不用写.extract()

更多选择器规则:http://scrapy-chs.readthedocs.io/zh_CN/latest/topics/selectors.html

3、编写爬虫

import scrapy

class XiaoHuarSpider(scrapy.spiders.Spider):

name = "xiaohuar" # spider_name

allowed_domains = ["xiaohuar.com"]

start_urls = [

"http://www.xiaohuar.com/hua/",

]

def parse(self, response):

print(response, type(response))

current_url = response.url

body = response.body

unicode_body = response.body_as_unicode()

print(unicode_body )

4、运行

进入project_name目录,运行命令

scrapy crawl spider_name --nolog

5、两种定义查找的方式

from scrapy.selector import Selector

ret = Selector(response=response).xpath('//li[re:test(@class, "item-\d*")]//@href').extract()

from scrapy.selector import HtmlXPathSelector

hxs = HtmlXPathSelector(response)

items = hxs.select('//div[@class="item_list infinite_scroll"]/div').extract()

5、去除重复url

一般采用md5 加密url 存放到set() 或数据库里

import hashlib

url_set = set()

md5_obj = hashlib.md5()

md5_obj.update(response.url)

md5_url = md5_obj.hexdigest()

if md5_url in url_set :

pass

else:

pass

6、递归的访问

以上的爬虫仅仅是爬去初始页,而我们爬虫是需要源源不断的执行下去,直到所有的网页被执行完毕

#!/usr/bin/env python

# -*-coding:utf-8 -*-

from scrapy.selector import Selector

from scrapy.http import Request

from scrapy.selector import HtmlXPathSelector

import scrapy

import os

import requests

import hashlib

class XiaoHuarSpider(scrapy.spiders.Spider):

name = "xiaohuar"

url_set = set()

allowed_domains = ["xiaohuar.com"]

start_urls = [

"http://www.xiaohuar.com/hua/",

]

def parse(self, response):

# 分析页面

# 找到页面中符合规则的内容(校花图片),保存

# 找到所有的a标签,再访问其他a标签,一层一层的搞下去

md5_obj = hashlib.md5()

md5_obj.update(bytes(response.url,encoding='utf-8'))

md5_url = md5_obj.hexdigest()

if md5_url in XiaoHuarSpider.url_set:

pass

else:

hxs = HtmlXPathSelector(response)

items = hxs.select('//div[@class="item_list infinite_scroll"]/div') #对象

for i in range(len(items)):

src = hxs.select(

'//div[@class="item_list infinite_scroll"]/div[%d]//div[@class="img"]/a/img/@src' % i).extract()

name = hxs.select(

'//div[@class="item_list infinite_scroll"]/div[%d]//div[@class="img"]/span/text()' % i).extract()

school = hxs.select(

'//div[@class="item_list infinite_scroll"]/div[%d]//div[@class="img"]/div[@class="btns"]/a/text()' % i).extract()

print(name,school,src)

if src and name and school:

ab_src = "http://www.xiaohuar.com" + src[0]

file_name = "%s_%s.jpg" % (school[0],name[0])

file_path = os.path.join("E:/image", file_name)

f = open(file_path, 'wb')

f.write(requests.get(ab_src).content)

f.close()

current_page_urls = hxs.select('//a/@href').extract()

for i in range(len(current_page_urls)):

url = current_page_urls[i]

if url.startswith('http://www.xiaohuar.com/list-1-'):

url_ab = url

yield Request(url_ab, callback=self.parse)

以上代码将符合规则的页面中的图片保存在指定目录,并且在HTML源码中找到所有的其他 a 标签的href属性,从而“递归”的执行下去,直到所有的页面都被访问过为止。以上代码之所以可以进行“递归”的访问相关URL,关键在于parse方法使用了 yield Request对象。

注:可以修改settings.py 中的配置文件,以此来指定“递归”的层数,如: DEPTH_LIMIT = 1

7、格式化处理

上述实例只是简单的图片处理,所以在parse方法中直接处理。如果对于想要获取更多的数据(获取页面的价格、商品名称、QQ等),则可以利用Scrapy的items将数据格式化,然后统一交由pipelines来处理。

在items.py中创建类:

import scrapy

class Scrapyapp1Item(scrapy.Item):

src = scrapy.Field()

name = scrapy.Field()

school = scrapy.Field()

上述定义模板,以后对于从请求的源码中获取的数据同意按照此结构来获取,所以在spider中需要有一下操作:

#!/usr/bin/env python # -*-coding:utf-8 -*- from scrapy.selector import Selector from scrapy.http import Request from scrapy.selector import HtmlXPathSelector import scrapy import hashlib class XiaoHuarSpider(scrapy.spiders.Spider): name = "xiaohuar" url_set = set() allowed_domains = ["xiaohuar.com"] start_urls = [ "http://www.xiaohuar.com/hua/", ] def parse(self, response): # 分析页面 # 找到页面中符合规则的内容(校花图片),保存 # 找到所有的a标签,再访问其他a标签,一层一层的搞下去 md5_obj = hashlib.md5() md5_obj.update(bytes(response.url,encoding='utf-8')) md5_url = md5_obj.hexdigest() if md5_url in XiaoHuarSpider.url_set: pass else: hxs = HtmlXPathSelector(response) items = hxs.select('//div[@class="item_list infinite_scroll"]/div') #对象 for i in range(len(items)): src = hxs.select( '//div[@class="item_list infinite_scroll"]/div[%d]//div[@class="img"]/a/img/@src' % i).extract() name = hxs.select( '//div[@class="item_list infinite_scroll"]/div[%d]//div[@class="img"]/span/text()' % i).extract() school = hxs.select( '//div[@class="item_list infinite_scroll"]/div[%d]//div[@class="img"]/div[@class="btns"]/a/text()' % i).extract() # print(name,school,src) if src and name and school: from scrapyapp1 import items obj = items.Scrapyapp1Item() obj['src'] = src[0] obj['name'] = name[0] obj['school'] = school[0] yield obj

此处代码的关键在于:

-

将获取的数据封装在了Item对象中

-

yield Item对象 (一旦parse中执行yield Item对象,则自动将该对象交个pipelines的类来处理)

import os import requests class Scrapyapp1Pipeline(object): def process_item(self, item, spider): print(item['name'],item['school'],item['src']) ab_src = "http://www.xiaohuar.com" + item['src'] file_name = "%s_%s.jpg" % (item['school'],item['name']) file_path = os.path.join("E:/image", file_name) f = open(file_path, 'wb') f.write(requests.get(ab_src).content) f.close() return item

如果有多个pipelines类,到底Scapy会自动执行那个?哈哈哈哈,当然需要先配置了,不然Scapy就蒙逼了。。。

在settings.py中做如下配置:

ITEM_PIPELINES = {

'scrapyapp1.pipelines.Scrapyapp1Pipeline': 100,

....,

}

# 每行后面的整型值,确定了他们运行的顺序,item按数字从低到高的顺序,通过pipeline,通常将这些数字定义在0-1000范围内。

浙公网安备 33010602011771号

浙公网安备 33010602011771号