特征降维以及对比正规方程法和梯度下降法

特征降维

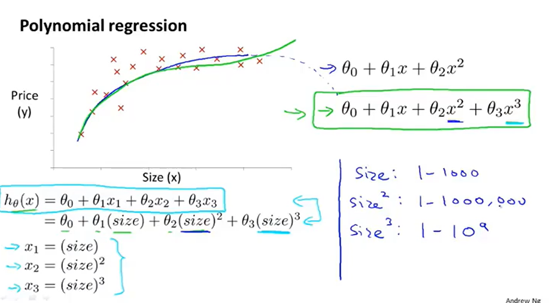

通过定义一个新的特征,可以得到一个更好的模型

对于一些不适合使用线性拟合方式的例子,可以通过使用将一个参数即面积的平方,立方看做不同的参数,然后将其看做多元线性拟合,但是其中就需要注意特征缩放了

正规方程法

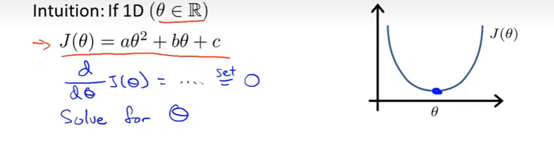

单元线性回归:

对于线性函数,只需要对函数进行求导,令导函数为0就能得到代价函数最后的最低点

多元线性回归

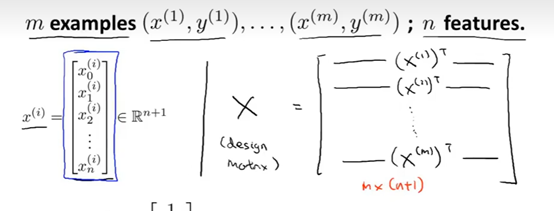

参数不再是一个实数。而是一个向量。通过对向量里面每一个参数求偏导,得出偏导等于0的参数值,最后就能得到所求的最小值的向量大小

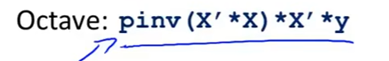

求偏导的方法太过于繁杂,就有了正规矩阵法

在所有的参数即特征值前面加上一列1,

得到的向量就是最优解

构造方法,m个向量,n个特征值,得到的矩阵是m行,n+1列的矩阵

正规矩阵法和梯度下降法对比:

梯度下降法缺点:你需要选择合适的学习率,不合适的学习率对模型影响很大

需要多次迭代才能得到最优解

优点:大数量的特征值也能很适应

正规矩阵法缺点:需要计算(xTx)-1

N特别大的时候,计算时间以三次方的速度增加

建议特征值一万以上使用前者

如果正规矩阵法公式中,xTx不可逆怎么办

计算广义逆结果是一样的

如果特征值个数n大于等于样本数量m,即n+1>m就不能使用正规矩阵法,应该删除部分特征,合并线性相关的特征或者使用正规化方法

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 终于写完轮子一部分:tcp代理 了,记录一下

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 别再用vector<bool>了!Google高级工程师:这可能是STL最大的设计失误

· 单元测试从入门到精通

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理