《机器学习十讲》学习报告四

一,模型提升方法

模型误差来源:

逼近误差

估计误差:训练到的函数与模型空间最好的函数的距离

线性到非线性模型:

线性回归:多项式回归

支持向量机

决策树:空间划分的思想来处理非线性数据

决策树的生成:

从根节点开始,选择对应特征

选择节点特征分割点

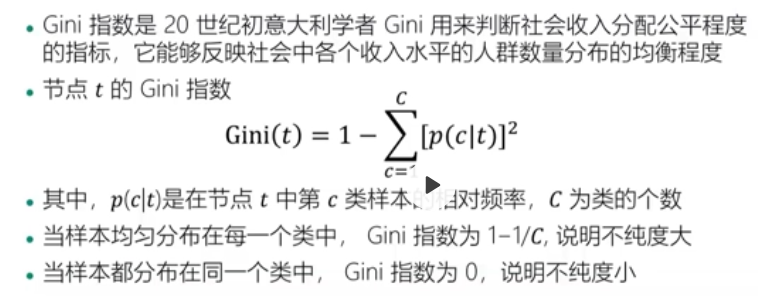

二,节点特征和分割点的选择

不纯度:表示落在当前节点的类别分别的均衡程度

节点分裂后,节点不纯度应该更低

选择特征及对应分割点,使得分裂前后的不纯度下降最大

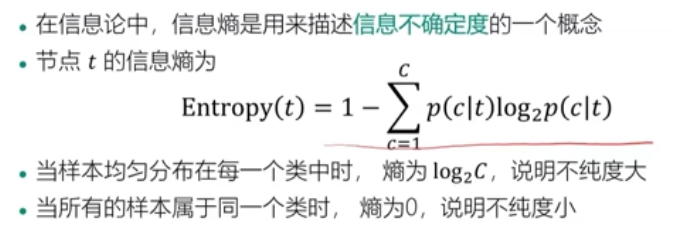

三,信息熵

在信息论

四,随机森林,独立思考的重要性

典型的Bagging算法:“随机”是其核心,“森林”意在说明它是通过组合多棵决策树来构建模型

主要特点

样本有放回抽样

特征随机抽样

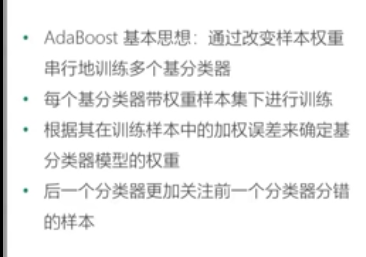

AdaBoost:站在前人的肩膀上前进