基于QLearning强化学习的机器人避障和路径规划matlab仿真

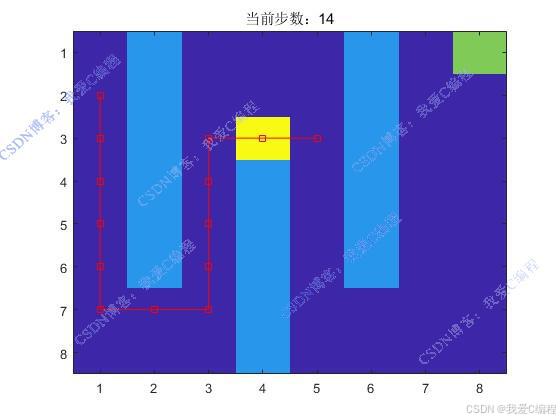

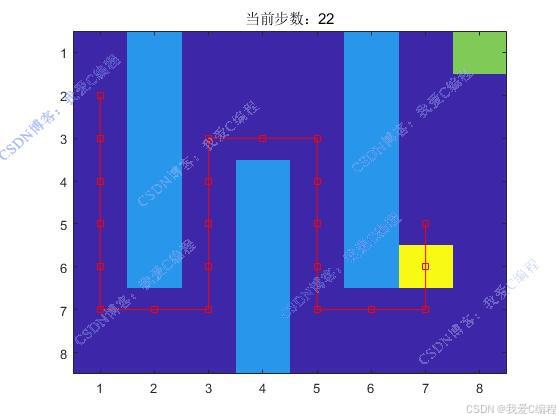

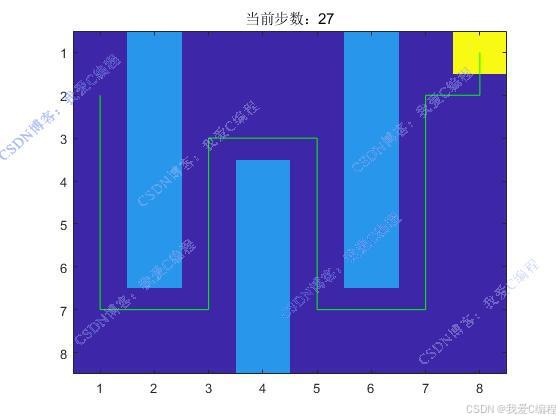

1.算法仿真效果

matlab2022a仿真结果如下(完整代码运行后无水印):

2.算法涉及理论知识概要

强化学习是一种机器学习方法,它使智能体能够在与环境交互的过程中学习如何采取行动以最大化累积奖励。Q-Learning是一种无模型的强化学习算法,特别适合于离散动作空间的问题。在机器人避障和路径规划中,Q-Learning可以帮助机器人学习如何在未知环境中寻找到达目标的最短路径,同时避免碰撞障碍物。

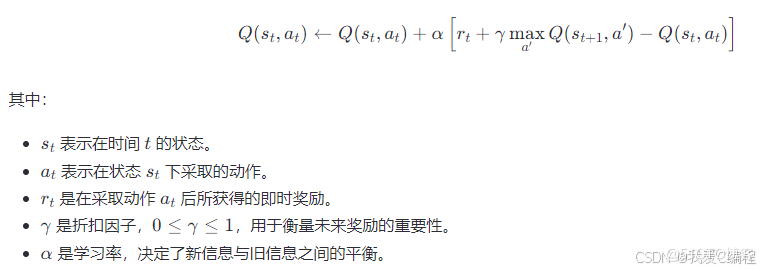

2.1 Q-Learning原理

Q-Learning是一种基于价值迭代的算法,其目标是找到一个策略,使得在给定状态下选择的动作能够最大化未来累积奖励的期望值。该算法的核心在于更新Q表(也称为Q函数),Q表记录了在每个状态下采取不同动作所能获得的最大累积奖励的估计值。

Q-Learning的基本更新规则如下:

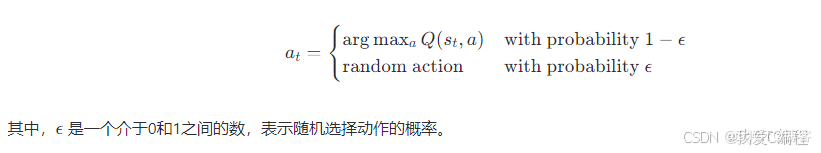

为了确保算法能够探索所有可行的策略,Q-Learning通常采用ε-greedy策略来进行探索与利用的平衡:

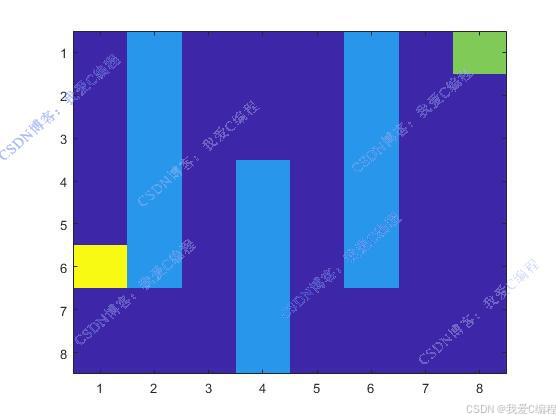

2.2 机器人避障和路径规划

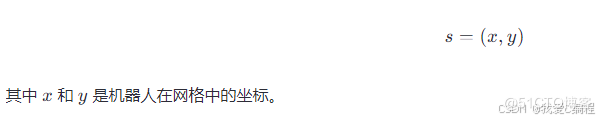

状态可以定义为机器人相对于目标和障碍物的位置。例如,如果机器人在一个二维网格世界中移动,那么状态可以由机器人当前位置的坐标表示:

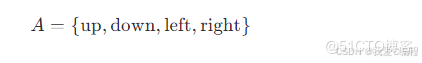

动作可以定义为机器人可以采取的不同移动方向。例如,在二维网格中,机器人可以有四个基本动作:上、下、左、右。

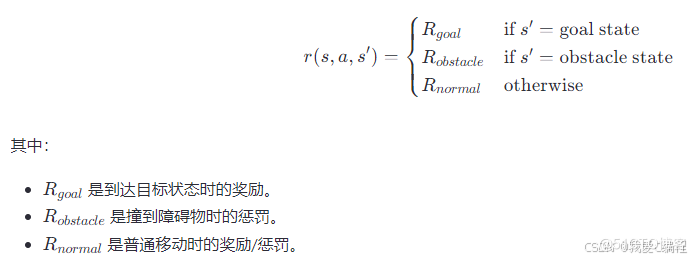

奖励函数的设计对于引导机器人学习正确的行为至关重要。一种简单的奖励函数设计如下:

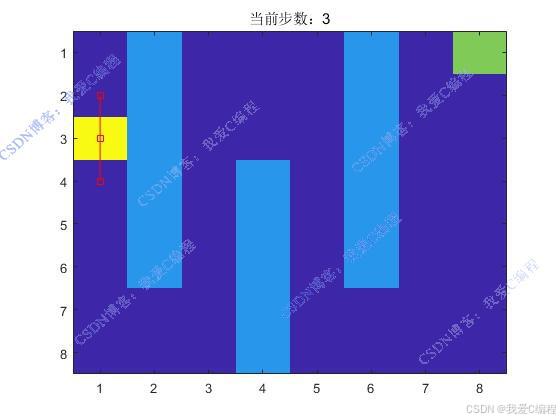

接下来,机器人开始在一个虚拟环境中学习。在每个时间步骤 t:

观测状态:机器人观测当前状态st。

选择动作:根据ε-greedy策略选择动作 at。

执行动作:机器人执行动作 at,进入新的状态 st+1 并获得奖励rt。

更新Q表:根据Q-Learning更新规则更新Q表。

重复:回到步骤1,直到达到终止条件。

基于Q-Learning的机器人避障和路径规划是一种有效的解决方案。通过不断学习和更新Q表,机器人可以学会如何在复杂环境中规划路径并避免碰撞障碍物。未来的研究方向可以包括引入更多的状态特征、使用连续动作空间的强化学习算法(如DQN或DDPG)等,以应对更加复杂的环境和更高的计算效率需求。

3.MATLAB核心程序

% 更新Q表

Qtab(Start_randm,Acts_temp) = (1-Lrr)*Qtab(Start_randm,Acts_temp) + Lrr*(Rwd + gamma * Nmax);

% 更新状态

Start_randm = s_n;

% 可视化新状态

xx = ceil(Start_randm/Scales);

yy = Start_randm - (xx-1)*Scales;

Env_cur = Map_mat;

Env_cur(xx,yy) = 4;

if mod(m,100)==1

imagesc(Env_cur);

end

m = m + 1;

if m > Lmv

flager2 = 0;

end

if Start_randm == Goal

flager2 = 0;

end

end

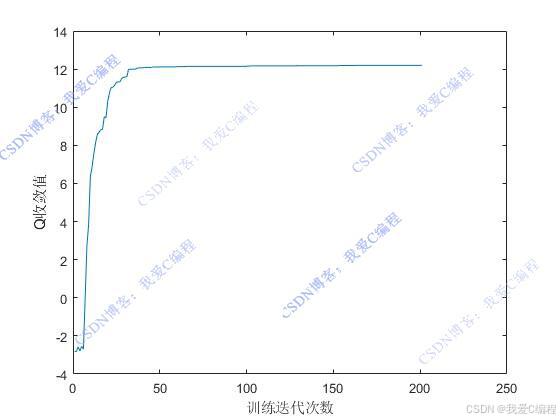

% 绘制Q表均值变化图

figure;

plot(epsilon2);

xlabel('训练迭代次数');

ylabel('Q收敛值');

% 保存数据

save data.mat Env Qtab Start0

0Z_008m

浙公网安备 33010602011771号

浙公网安备 33010602011771号