爬虫基础概念

爬虫基础概念

简介

爬虫是一个模拟人类请求网站行为的程序。可以自动请求网页、并把数据抓取下来,然后使用一定的规则提取有价值的数据;

爬虫应用场景:

- 搜索引擎(百度或谷歌等)

- 伯乐在线。

- 惠惠购物助手。

- 数据分析。

- 抢票软件等。

Python用来写爬虫的优点

语法优美、代码简洁、开发效率高、支持的模块多。相关的HTTP请求模块和HTML解析模块非常丰富。还有Scrapy和Scrapy-redis框架让我们开发爬虫变得异常简单····

关键词抽取

- 模拟:浏览器就是一个纯天然最原始的一个爬虫工具。

- -抓取:

- 抓取一整张的页面源码数据

- 抓取一整张页面中的局部数据

爬虫的分类:

- 通用爬虫:

- 要求我们爬取—整张页面源码数据

- 聚焦爬虫

- 要求爬取一张页面中的局部的数据

- 聚焦爬虫一定是建立在通用爬虫基础之上

- 增量式爬虫:

- 用来监测网站数据更新的情况,以便爬取到网站最新更新出来的数据。

- 分布式爬虫:

- 提高爬取效率的终极武器。

反爬机制

- 反爬机制

- 是作用到门户网站中。如果网站不想让爬虫轻易爬取到数据,它可以制定相关的机制或者措施阻止爬虫程序爬取其数据。

- 反反爬策略

- 是作用在爬虫程序中。我们爬虫可以制定相关的策略破击反爬机制从而爬取到相关的数据。

- 第一个反爬机制:

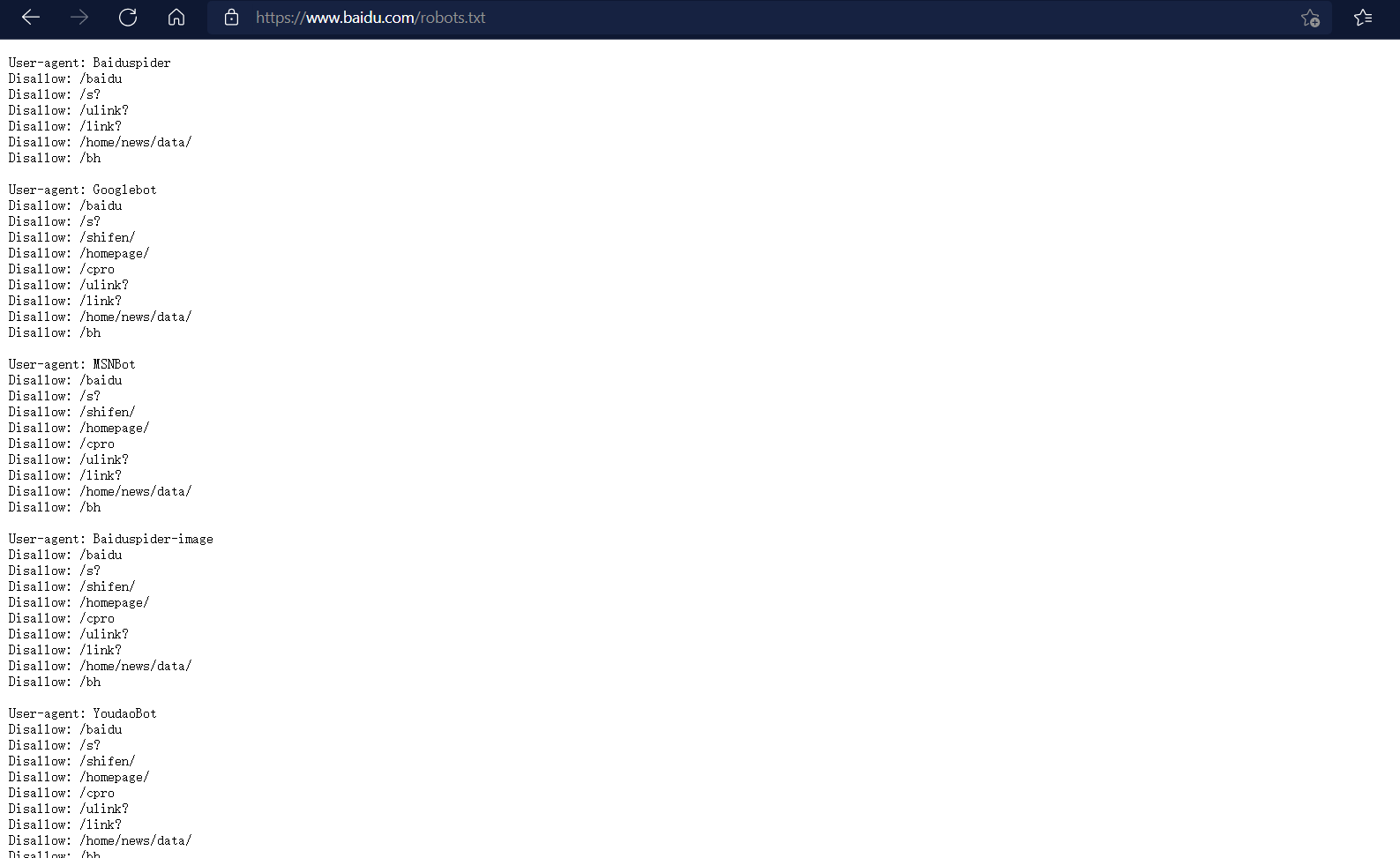

- robots协议:是一个纯文本的协议,协议中规定了该网站中哪些数据可以被哪些爬虫爬取,哪些不可以被爬取。

- 破解︰自己主观性的不遵从该协议即可

如何查看规定哪些内容不可爬取?

在爬取的url后跟robots.txt查看,百度示例:

开发工具和Chrome的安装

开发工具Anaconda和Pycharm的安装教学前面都有介绍到,Chrome安装也非常简单

ps:如果打不开说明被墙掉了,需要F墙

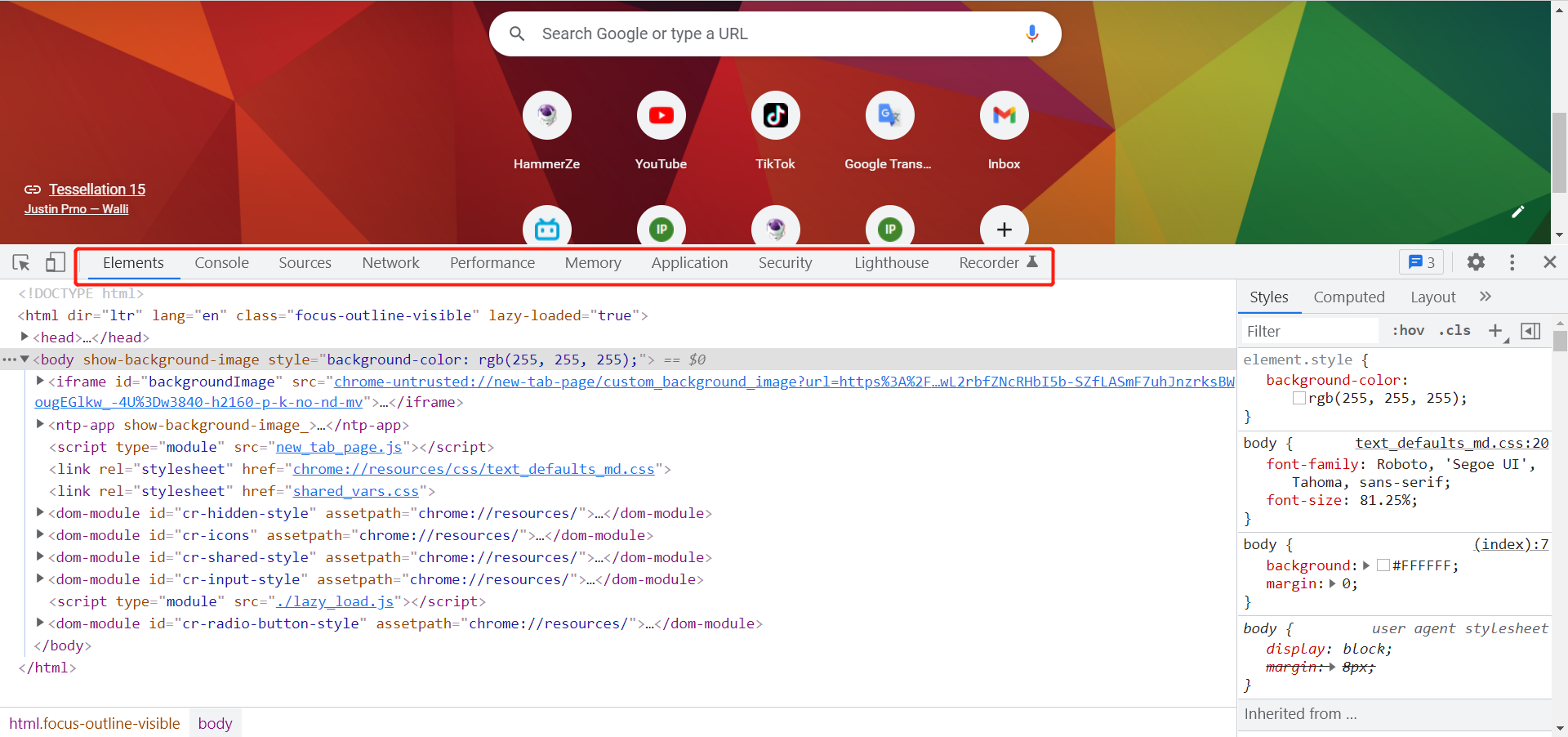

Chrome抓包工具

Elements:

可以帮助我们分析网页结构,获取我们想要的数据。但是Elements下是最终呈现的网页数据,有时候网页数据是通过ajax请求得到的,因此Elements下的数据不能完全相信。

Console:

用来打印网页的一些信息。

Sources:

整个网页所加载的所有文件。

Network:

查看整个网页发送的所有网络请求。一般我们想要去查看某个请求的信息,都可以到这个里面去看。

Http协议:

Http协议介绍:

Http协议:全称是HyperText Transfer Protocol,中文意思是超文本传输协议,是一种发布和接收HTML(HyperText Markup Language)页面的方法。服务器端口号是80端口。 2. HTTPS协议:是HTTP协议的加密版本,在HTTP下加入了SSL层。服务器端口号是443端口。

更多介绍请参考:https://baike.baidu.com/item/HTTP

URL详解:

URL是Uniform Resource Locator的简写,统一资源定位符。 一个URL由以下几部分组成:

- scheme:代表的是访问的协议,一般为http或者https以及ftp等

- scheme://host:port/path/?query-string=xxx#anchor

- host:主机名,域名,比如www.baidu.com

- port:端口号。当你访问一个网站的时候,浏览器默认使用80端口

- path:查找路径。比如:www.jianshu.com/trending/now,后面的trending/now就是path

- query-string:查询字符串,比如:www.baidu.com/s?wd=python,后面的wd=python就是查询字符串。

- anchor:锚点,前端用来做页面定位的。现在一些前后端分离项目,也用锚点来做导航。

在浏览器中请求一个url,浏览器会对这个url进行一个编码。除英文字母,数字和部分符号外,其他的全部使用百分号+十六进制码值进行编码。

常见的请求Method:

在Http协议中,定义了八种请求方法。这里介绍两种常用的请求方法,分别是get请求和post请求。

- get请求:一般情况下,只从服务器获取数据下来,并不会对服务器资源产生任何影响的时候会使用get请求。

- post请求:向服务器发送数据(登录)、上传文件等,会对服务器资源产生影响的时候会使用post请求。 以上是在网站开发中常用的两种方法。并且一般情况下都会遵循使用的原则。但是有的网站和服务器为了做反爬虫机制,也经常会不按常理出牌,有可能一个应该使用get方法的请求就一定要改成post请求,这个要视情况而定。

常见的请求头参数:

在http协议中,向服务器发送一个请求,数据分为三部分,第一个是把数据放在url中,第二个是把数据放在body中(在post请求中),第三个就是把数据放在head中。这里介绍在网络爬虫中经常会用到的一些请求头参数:

User-Agent:浏览器名称。这个在网络爬虫中经常会被使用到。请求一个网页的时候,服务器通过这个参数就可以知道这个请求是由哪种浏览器发送的。如果我们是通过爬虫发送请求,那么我们的User-Agent就是Python,这对于那些有反爬虫机制的网站来说,可以轻易的判断你这个请求是爬虫。因此我们要经常设置这个值为一些浏览器的值,来伪装我们的爬虫。

Referer:表明当前这个请求是从哪个url过来的。这个一般也可以用来做反爬虫技术。如果不是从指定页面过来的,那么就不做相关的响应。

Cookie:http协议是无状态的。也就是同一个人发送了两次请求,服务器没有能力知道这两个请求是否来自同一个人。因此这时候就用cookie来做标识。一般如果想要做登录后才能访问的网站,那么就需要发送cookie信息了。

常见的响应状态码:

- 200:请求正常,服务器正常的返回数据。

- 301:永久重定向。比如在访问www.jingdong.com的时候会重定向到www.jd.com。

- 302:临时重定向。比如在访问一个需要登录的页面的时候,而此时没有登录,那么就会重定向到登录页面。

- 400:请求的url在服务器上找不到。换句话说就是请求url错误。

- 403:服务器拒绝访问,权限不够。

- 500:服务器内部错误。可能是服务器出现bug了。

Chrome那些事,HTTP协议都在这👆

Chrome那些事,HTTP协议都在这👆

浙公网安备 33010602011771号

浙公网安备 33010602011771号