《经济学人 —— 人工智能专题报告》

原文: https://www.economist.com/sites/default/files/ai_mailout.pdf

我对这篇文章的一些个人解读:http://www.cnblogs.com/massquantity/p/8323665.html

害怕新机器某一天会取代所有人的工作、只选择性地让少数人获益、或者颠覆整个社会秩序,此类恐惧对于我们来说并不陌生。两百年前工业化进程正在英国如火如荼地展开时,这样的问题就曾引起过激烈的争论。那时的人们称之为“机器问题”而非“工业革命”。首先提出这一点的是经济学家David Ricardo,在1821年他忧心忡忡地表示:“机器对社会各阶层,尤其是劳动阶级的影响巨大,因为使用机器将会不断致使他们的利益受损。” Thomas Carlyle则于1838年猛烈地抨击“机械魔鬼“,认为其破坏性的力量是”搅乱全体工人正常生活“的罪魁祸首。

如今,机器问题正以一种崭新的姿态卷土重来。技术专家、经济学家和哲学家们正在争论人工智能(AI)可能带来的影响。这项快速发展中的新技术,使得机器能完成一些之前被认为只有人类才能完成的任务,这可能会带来深远的影响。大批工作岗位会受到威胁,范围从放射科医生延伸到法律书记员,而这些工作之前普遍被认为是不可能自动化的。牛津大学的Carl Benedikt Frey 和Michael Osborne 发表于2013年的一项被广为引用的研究表明,美国有47%的工作有很大可能会“被计算机资本取代“。最近美国银行-美林证券(Bank of America Merrill Lynch)则预测,到2025年,由AI引发的”年度创新性破坏影响(annual creative disruption impact)“将达到14至33万亿美元,其中包括9万亿人工成本,因为AI可以使知识工作自动化;8万亿生产和医疗成本;以及使用无人驾驶汽车和无人机带来的2万亿效率增益。智库麦肯锡全球研究院(McKinsey Global Institute)声称:AI正在促进社会的转型,与工业革命比起来,这次的转型“速度上快10倍,规模上大300倍,影响力则几乎超3000倍。”

与两百年前如出一辙,人们担忧机器会使数百万人下岗,造成不平等和社会动乱。两本关于自动化威胁的畅销书的作者 —— Martin Ford表示,中产阶级工作可能会消失,经济流动性会停滞以及财阀阶级“会集中居住于封闭式社区或者精英城市,并可能通过自动化军事机器人和无人机与外界完全隔离”。其他人则担忧AI会对人类造成生存威胁,因为超智能计算机可能不会与人类共享同样的终极目标,进而有一天与它们的创造者反目。物理学家Stephen Hawking曾发出过这样的警告,而更让人诧异的是,创建了火箭公司Spacex和电动汽车公司Tesla的亿万富翁企业家Elon Musk也持类似的观点。Musk的言论听上去与Carlyle遥相呼应,他警告:“与人工智能共舞,就如同我们在召唤恶魔。”纵使他的Tesla汽车使用最先进的AI技术实现自动驾驶,Musk却在苦恼超负荷使用AI可能令其在未来变得过于强大,以至于难以被人类控制。他作了个比喻:“如果你有Marcus Aurelius这样的人当国王那自然是不错,但如果是Caligula,那恐怕就不太妙了。”

It’s all Go

这些担忧都源自AI近年来取得了令人难以置信的进展,而在这之前该领域却总是因无法兑现承诺而声名狼藉。Deep Mind的董事长和联合创始人Demis Hassabis说:“在过去几年里它就这样彻底爆发了。”Deep Mind作为一家AI创业公司于2014年被Google以4亿美元收购,今年早些时候它的AlphaGo系统击败了世界上最好的围棋选手之一的李世石(译者注:指的是杂志出版的2016年),而在这以前围棋被认为太过复杂,计算机还需要至少等上10年才能完全掌握。硅谷风投公司Andreessen Horowitz的Marc Andreessen说:“一直以来我都是个怀疑论者,然而现在取得的进展都是真真切切的。结果也是真实的,真的有效果。”

特别是一项被称为“深度学习(deep learning)”的AI技术已经被广泛运用于强化网络搜索引擎,过滤垃圾邮件,建议邮件回复,网页翻译,识别语音指令,侦测信用卡欺诈以及操控自动驾驶汽车等领域,这项技术通过不断处理大量的实例来促使系统学习和改进,而非直接编写程序。“这是个大突破”,NVIDIA的CEO黄仁勋(Jen-Hsun Huang)说:“之前是人类在写程序,而现在是数据在写程序。”

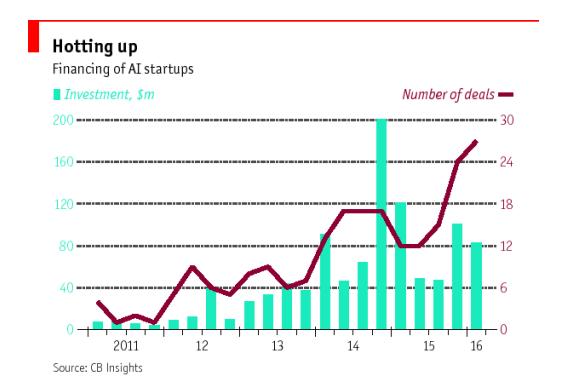

有些人看到了威胁,另一些则视此为机遇。投资者正蜂拥进入这个领域。科技巨头不断收购AI创业公司并争相吸引学术界的顶级研究者。根据数据分析公司Quid的调查结果显示,在2015年AI公司的投资额创下了85亿美元的记录,将近是2010年的4倍。AI公司的投资轮数与前一年相比提升了16%,而相比之下整个科技领域则下降了3%。创业公司的默认商业模式不再是“XX行业的Uber”,而是“XX行业+AI”。Google,Facebook,IBM,Amazon和Microsoft都尽全力在云端建立围绕AI服务的生态系统。AI创业公司MetaMind的创始人Richard Socher说:“这项技术会被应用于各行各业,只要这些行业包含多样的数据种类,比如基因测序,图像识别,语言处理等等,AI将无处不在。”

这些都意味着什么?这份专题报告将审视这项新技术的崛起,探究其对工作、教育和政策的影响,并考量它在伦理和监管方面的潜在问题。这份报告同样会回顾几百年前在面对机器问题时我们从中学到的教训。AI在世界上激起了同等程度的恐惧和热情,并引发了诸多问题。然而应当牢记,许多问题在这之前就已经被提出并回答过了。

Technology

From not working to neural networking

人工智能,这个在萌芽时期就弥漫着狂傲与失落的领域,是如何突然间成为科技界的新宠的?人工智能这个术语首先出现在1956年的一项研究计划中,该计划提出,“如果精心挑选一批科学家共同工作一个夏天,一些课题将会取得重大进展,比如使得机器能够解决一些目前只有人类才能处理的问题”。这已被证明是乐观过了头,或者至少可以这么说,尽管AI间歇性地取得过一些爆发式的进步,它给人的印象却总是承诺远大于成果。从前的研究者们大多回避这个术语,而更多地谈论“专家系统(expert system)”或者“神经网络(neural networks)”。而AI的复兴,以及当前对该领域的狂热,都可以追溯到2012年一个名为“ImageNet Challenge”的网络竞赛。

ImageNet是一个包含数百万图片的线上数据库,所有图片都有人工做的标签。指定任意一个词,比如“气球”或“草莓”,ImageNet都有几百张与之相关的图片。每年的ImageNet竞赛都鼓励参赛者相互竞争,通过使计算机自动识别和标记图片的方式来测试成果。这些系统首先使用一堆被正确标记的图片进行训练,接着尝试标记一些之前未见过的测试图片。在后续的研讨会中,胜者将分享并讨论他们所用的技术。在2010年,取胜的系统可以正确地标记72%的图片(人类的平均水平为95%)。在2012年,由多伦多大学的Geoff Hinton带领的团队通过使用一项被称为“深度学习(deep learning)”的新技术,将准确率跃升到了85%。这之后的进步越来越快,2015年ImageNet竞赛的准确率达到了96%,首次超越了人类。

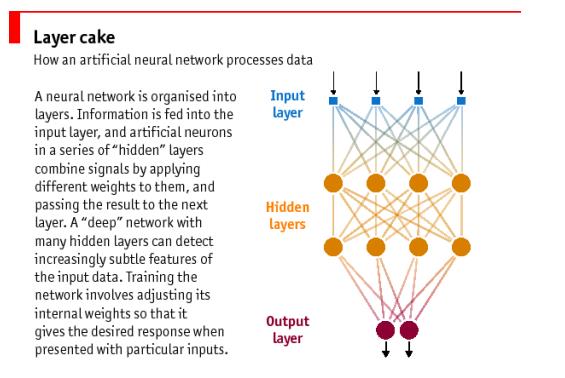

这项2012年诞生的新技术被广泛视作一个突破,但其依赖于“将过去的片段整合在一块”,蒙特利尔大学的计算机科学家Yoshua Bengio说,他与Hinton以及其他一些人,共同被视作深度学习的先驱。本质上,这项技术运用强大的计算能力和大量的训练数据来强化AI领域发展初期就已形成的一个古老想法:即所谓的人工神经网络(artificial neural network,ANN)。该想法来源于生物学上的人造神经元(脑细胞)网络。

在生物学大脑中,每个神经元都能被其他神经元传递给其的输出所触发,而这个神经元自身的输出也能继续触发其他神经元。一个简单的ANN有一个输入数据的输入层,一个产出结果的输出层,以及中间可能有几个处理信息的隐藏层。网络中的每个神经元都有一系列的“权重(weights)”和“激活函数(activation function)”来控制结果的输出。训练一个神经网络需要调整神经元的权重,以使得一个给定的输入能产生理想的输出。ANN在90年代早期开始获得一些有用的结果,比如识别手写数字。然而当人们想用这个算法执行一些更加复杂的任务时,却遇上了阻碍。

在过去十年间新技术的涌现以及对激活函数的些许调整使得训练深度网络成为了可能。而与此同时互联网的崛起所产生的数十亿文件、图像和视频则为训练提供了丰富的素材。所有这些都需要大量的数字运算能力,但马上这就不再是问题,因为一些AI研究组在2009年公布称:图形处理芯片(GPUs),一种原本使得电脑和电子游戏控制台生成炫丽图片的专用芯片,同样非常适合运行深度学习算法。斯坦福大学的吴恩达(Andrew Ng)领衔的一个AI研究组发现GPU可以将他们的深度学习系统提速将近100倍,吴恩达随后去了Google,而现在则在中国的互联网巨头百度工作(译者注:吴恩达已于2017年3月从百度离职。)。突然间,训练一个四层神经网络,之前都需要几个星期,而现在则耗时不到一天。“这像极了一个美妙的对称“,GPU芯片制造商NVIDIA的CEO黄仁勋(Hsun Huang)说:“同样一种芯片,既能使游戏者沉浸于虚拟世界,又能使计算机通过深度学习理解现实世界。”

ImageNet的结果很好地展现了深度学习的能力。突然间,不仅是AI社区,整个科技行业都开始关注这个领域。深度学习系统自那以后变得愈发强大:20到30层的神经网络已非罕见,微软的研究者甚至开发出了152层的网络。深度网络具有高度抽象化的能力并能产生更好的结果,而这些网络已被证明擅长解决各种各样的问题。

“深度学习这样一种学习技术,正因为可以应用于这么多不同的领域,所以人们才对其如此热衷。”Google的机器智能研究首脑John Giannandrea说,他现在同样负责搜索引擎。Google正在使用深度学习来加强网络搜索质量、帮助智能手机理解语音指令、协助人们通过特定的图片搜寻照片、建议邮件自动回复、改进网页翻译服务、以及引导其无人驾驶汽车理解周边环境。

Learning how to learn

深度学习可分为多种类别。其中应用最广泛的一种为“监督学习(supervised learning)”,一项使用带标签的实例来训练系统的技术。举个例子,就垃圾邮件过滤来说,可以先收集大量的样本邮件,每个都标有“垃圾邮件”或“非垃圾邮件”,这些邮件可以组成一个庞大的数据库。一个深度学习系统可以使用这个数据库来进行训练,通过不断地输入这些实例并调整神经网络里的权重,来提升检测垃圾邮件的准确率。这种方法最大的优点是不需要人类专家设定一系列规则或程序员敲代码去执行程序,系统自身就可以通过带标签的数据进行学习。

用带标签的数据训练后的系统可用于图片分类、语音识别、监测信用卡交易欺诈、识别垃圾邮件和恶意程序、精准广告投放 —— 这些应用的共同特点是大量过往案例的正确答案都是已知的。Facebook可以通过你上传的照片来识别和标记你的朋友和家人,最近甚至发布了一个为盲人描述照片内容的系统(比如可以这么描述:“两个人,微笑着,戴太阳眼镜,室外,水”)。

吴恩达说,目前有很大存量的数据可以用于监督学习。这项技术的频繁使用促使一些原属于金融服务、电脑安全或营销领域的企业将自己重新定位为AI公司。

另一项技术,非监督学习(unsupervised learning),同样是让神经网络接触大量的实例来进行训练,却不告诉它要寻找什么。神经网络将自动识别特征并将相似的实例聚类,进而展现数据中隐藏的群组,关联或模式。

非监督学习可以用来搜寻你不知道其具体样貌的东西:比如监控网络流量模式来防止网络攻击,或者检查数额庞大的保险理赔要求来识别新型欺诈手段。举一个著名的例子,在2011年吴恩达还在Google工作时,他领导了一个被称为Google大脑(Google Brain)的的项目,这个项目是一个巨大的非监督学习系统,用于在成千上万个未标签的YouTube视频中识别普遍的模式。有一天他的一个博士生给了他一个惊喜。“我记得他把我叫到他电脑跟前说,‘看这个’,”吴恩达后来回忆。在屏幕上显现出一张毛茸茸的脸,这是一个从成千上万个实例中提取出来的模式。这个系统成功识别出了猫。

强化学习(reinforcement learning)介于监督学习和非监督学习之间。神经网络通过不断与环境交互进行训练,而该环境只以奖励的形式给予偶然的反馈。本质上来说,训练就是通过调整神经网络中的权重来寻找能持续产生更高奖励的策略。DeepMind是这方面的专家。在2015年2月它在Nature上发表了一篇论文,描述了一个强化学习系统能够学会玩49种经典的雅达利(Atari)电子游戏,使用频幕像素和游戏分数作为输入,而其输出则与一个虚拟控制器相连。这个系统从零开始玩这49种游戏,最终在其中的29种达到或超越了人类水平。

Gaming the system

电子游戏是做AI研究的理想载体,DeepMind的Demis Hassabis说,因为“它们就像是真实世界的缩影,但却更加地纯净和有序。”游戏引擎能够方便地产生大量训练数据。Hassabis在攻读认知神经科学的博士学位和创立DeepMind之前,就曾经在游戏行业工作。DeepMind目前位于伦敦的国王十字站附近,是Google AI研究的一部分。

DeepMind于2016年3月上了头条,它的AlphaGo系统在首尔的一场5局比赛中,以4:1击败了当今最佳围棋选手之一的李世石。AlphaGo是一个强化学习系统,但却有着一些不同寻常的特征。它由几个相互连结的模块组成,其中包括两个深度神经网络,分别有着不同的功能,就像人脑中的模块一样。其中一个通过分析数百万的棋局进行训练,进而提出几个备选的下法,另一个网络则使用一种基于随机抽样的技术来评估这些下法。这样系统就结合了源自生物学和非生物学的技术。AI研究者对哪种技术更好已经争论了几十年,但AlphaGo却二者兼顾。“这是个复合系统,因为我们认为解决智能问题光靠深度学习显然是不够的,“Hassabis说。

他以及其他的研究者已经将目光投向了下一步,“迁移学习(transfer learning”)。这将使得强化学习系统构建于过去习得的知识基础之上,而不是每次都从头开始训练。Hassabis指出,人类能毫不费力地做到这一点。Giannandrea回忆起他四岁的女儿能够识别出pennyfarthing是一种自行车,尽管她之前从来没见过这种东西。“计算机就做不到这一点。”他说。

MetaMind,一家最近被Salesforce收购的AI创业公司,正在研发一种相关的技术 ——“多任务学习(multitask learning),这种技术使得同一个神经网络架构能够解决多种不同的问题,因为在一个问题上获得的经验能用来更好地解决下一个。与DeepMind一样,他们正在探索模块化架构;其中一个被称为“动态记忆网络”,可以吸纳一系列语言陈述,回答相应问题,并推断出它们的逻辑联系。MetaMind同样将自然语言和图像识别网络整合到了一个系统中,这个系统可以回答与图像相关的问题(“这辆车是什么颜色的?”)。这种技术可以用于强化自动化客户服务聊天机器人,或者Salesforce的客户呼叫中心。

按过往的规律,许多有前景的AI新技术到后来都会迅速陨落,但深度学习却不同。“这东西真的有用。”MetaMind的Richard Socher说。人们天天都在使用这项技术却毫无察觉。Hassabis, Socher和其他人的愿景是开发出“通用人工智能(artificial general intelligence,AGI)” —— 一个可以完成多种任务的系统 —— 而非为每个问题都单独开发一个AI新系统。Socher说,许多年来,AI研究都聚焦于解决某个特定的问题,但现在研究者们正在”提取这些更加先进的乐高积木并将它们以新的方式组合在一起。“但即使是他们当中最乐观的人也认为至少还需要十年才能实现人类水平的AGI。但是Hassabis说,” 我想我们已经掌握了一些关键信息 ,能够帮助我们向真正实现AGI技术靠拢。“

而与此同时AI的作用已然开始凸显,进步也越来越快。比如Google的智能回复系统(Smart Reply system),使用两个神经网络来建议邮件回复,仅耗时4个月就从一个深度学习研究项目转化成了真正的产品(尽管刚开始它的表现令人气馁,对几乎每个邮件都回复“我爱你”)。Socher说:“在学术期刊上发表了一篇论文,一个月后就会有公司开始使用这个系统。” AI公司,不论大小,都能稳定地产出学术论文。AI研究者们被允许在同行评议期刊上发表他们的成果,甚至在他们转投工业界之后。许多研究者都既保有学术职位又同时在公司工作。“如果你不让他们继续发表论文,他们是不会为你工作的。” Andreessen Horowitz如此解释道。

Google, Facebook, Microsoft, IBM, Amazon, 百度以及其他一些公司已将它们的深度学习软件开源并免费提供下载。部分原因是这些公司的研究人员想要公布自己的工作内容,这样有利于招募员工。而从一个更加犬儒的角度来看,这些大型互联网公司之所以可以免费开放自家的AI软件,是因为在其他层面他们手握巨大优势:即能够获取大量用于训练的用户数据。“这在特定领域内是一个很大的优势”,投资基金公司Bloomberg Beta的Shivon Zilis说,“但创业公司也在积极寻找进入特定市场的途径”。举例来说,无人机初创公司就可以运用模拟数据来学习如何在拥挤的环境中飞行。“其实有大量的数据可以在互联网上获取”,创业孵化器Y Combinator的总裁Sam Altman说。同时他指出人类就可以从少量数据中学习,这表明即使没有大量训练数据,智能依然可能实现。所以如今像Numenta 和 Geometric Intelligence这样的创业公司正在探索降低数据依赖性的方法。

Pick and Mix

各家公司正排着队供应各种部件以期参与这股AI热潮。这其中名字出现地最频繁的是NVIDIA,似乎每个AI创业公司都在使用它的GPU芯片来训练神经网络。GPU容量同样可以在Amazon和Microsoft的云端租用。与此同时,IBM和Google正在开发一种新型定制芯片(译者注:即传说中的TPU),能够提升AI软件的运行速度和效率。Google,Microsoft,IBM正将它们的语音识别、句法剖析、图像分析等AI服务免费在网上开放,这样创业公司就能通过整合这些基础部件来开发新的AI产品和服务。已经有来自各行各业的300多家公司在IBM的Waston平台上开发了AI驱动的app,其中包含各种功能,从筛选应聘者到挑选红酒。

对于大部分人来说,所有这些AI领域的进展都表现为每天使用的互联网服务正在逐渐进步。搜索引擎会产生更多相关的结果;推荐系统会变得更加精准。Hassabis预测,几年之内所有东西都会在某种程度上被打上智能化的烙印。AI技术能让计算机界面变得更具对话性和预测性,而不是简单的菜单和图标。而这种人机对话模式可以让一些没有读写能力或无法使用互联网的人有机会使用计算机。

然而量变会引发质变,当AI技术不断进步并跨过了特定的门槛,机器就能够执行一些之前专属于人类的任务。自动驾驶汽车的性能正迅速得到优化,不久之后就有取代出租车司机的可能,至少在市中心这样的受控环境中。运输无人机,无论是地上跑的还是天上飞的,都可以与人类送货员竞争。改进过的视觉系统和机器人技术使得机器人能够堆垛超市货架和移动仓库货物。Dixon说,未来必定还会有更多让人意想不到的突破。

其他人则担心AI技术会极大扩增工作中的计算机化和自动化部分,这似乎会让许多人面临失业的危险,就如同200年前蒸汽机以及其他新型机器的出现一样。那时,英国诗人Robert Southey宣称:“蒸汽加速了一个已经在运行的进程,却似乎变得过快了。”他担心“这种强大力量的发现”已经早于“我们知道如何正确使用它”。许多人对今天的AI技术都心存同样的顾虑。

The impact on jobs

Automation and anxiety

端坐于旧金山的办公室,Igor Barani在他的屏幕上调用了一些医学扫描成像。他是Enlitic的CEO,Enlitic作为众多将深度学习应用到医疗领域的创业公司之一,最开始的业务主要为X光和CT扫描的图像分析。这是个自然而然的实际应用,主要有三个原因 ——深度学习因在特定形式的图像识别领域表现卓越而名声大噪;医疗领域又有着大量带标签的训练数据;以及医疗服务在准确性和效率方面存在巨大的进步空间。

Barani博士(曾经是个肿瘤学家)指着一张显示病人肺部的CT图,这张图从三个不同的角度拍摄。屏幕上闪烁的红色小点意味着Enlitic的深度学习系统正在进行检查和比较,辨别其是血管、无害的成像制品,还是恶性的肺部肿瘤。系统最终会标明一个特征以留待进一步检查。三个放射科专家组成的团队曾与Enlitic的系统进行过一次比赛,Enlitic的系统在辨别恶性肿瘤的准确率上要高于人类专家50%;而假阴性率仅为0,人类专家为7%。Enlitic的另一个系统,主要通过X光检测腕部骨折,同样轻易地战胜了人类专家。该公司的技术目前正在澳大利亚的40家诊所中进行测试。

这样一台能提供专业放射学建议的计算机仅仅是一个缩影,折射出即使是那些需要高度训练的白领工作也能被自动化,而主要契机则来源于深度学习和其他形式AI的飞速进步。体力工作可以由机器执行,这个想法并不新鲜;但现在越来越聪明的机器已经可以执行一些脑力工作了。专家说,判断一项工作是否易受自动化的威胁,不在于这是体力还是脑力工作,而在于其是否具有例行的流程。以前机器就能做许多具有固定流程的体力劳动,而现在执行一些流程化的脑力任务也都不在话下。吴恩达说:“事实上,如今一个训练有素的专业放射科医生可能比他的助手更容易被机器取代。助手能做那么多不同的事情,我不认为在不久的将来所有这些事情都能被机器自动化。”

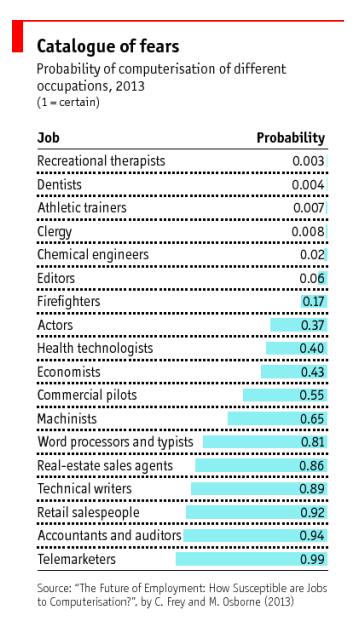

那么哪些工作更容易被取代呢?在发表于2013年的一项著名研究中,Carl Benedikt Frey和Michael Osborne研究了702种职业被计算机化的概率,发现在美国有47%的职业有被自动化的风险。他们得出结论,“在不久的将来,机器学习的飞速发展将使大批职业身处威胁之中。”随后的研究表明,在英国受威胁职业占35%(那里的人更多地在创造性领域工作,因而较少受自动化影响),而日本则是49%。(译者注:我怎么觉得这是在黑腐国。)

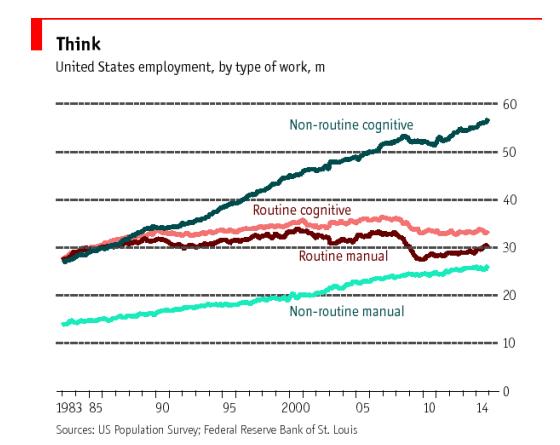

经济学家们已经在忧虑“职业两极化(job polarisation)”,中等技能的工作(比如制造业)正在减少,而低技能和高技能的工作却在增加。事实上,整个劳动力大军正在二分成两类非流程化工作:一类是高薪高技能工作(比如建筑师和高级经理),另一类是低薪低技能工作(比如路边烤羊肉串的)。许多西方国家中层阶级的薪资都保持万年不变,这被认为是自动化正在扮演越来越重要角色的证据 —— 尽管也不能完全排除离岸外包的影响,许多流程化的工作(如制造和呼叫中心之类的)都已经被转移到了低薪资的发展中国家。据圣路易斯联邦储备银行发布的数据显示,在美国,非流程化的脑力和体力岗位自上世纪八十年代以来一直在稳定增长,而流程化的岗位则几乎没怎么变化过(见图)。随着越来越多的工作被自动化,这个趋势貌似会持续下去。

而这仅仅是个开始。“我们看到的不过是冰山之一角,没有任何办公室工作是安全的。” Sebastian Thrun说,他是斯坦福的一个人工智能教授,以无人驾驶汽车方面的研究出名。如今自动化将“无视衣领的颜色”,另一个斯坦福学者Jerry Kaplan如此宣称。而其中最为悲观的则是Martin Ford,一个软件行业企业家,同时是畅销书《Rise of the Robots》的作者。他警告在未来人类的工作可能会彻底消失,并指出大部分工作可以被分解成一系列流程化任务,而这种任务正是机器最拿手的。

在之前的自动化风潮中,工人们可以从一个行业的流程化工作转移到另一个行业的流程化工作;而如今“大数据”这个曾经极大改善公司的营销和客户服务系统的技术,同样为这些公司提供了许多训练机器学习系统的素材,而这些系统正在慢慢取代越来越多人的工作。比如“E-discovery”软件可以从成堆的法律文件中搜寻信息,其速度要比人类的办事员或律师助理快得多。新闻业的一些工作,比如撰写市场或体育报告,同样可以被自动化。

自动化会使大批工人失业,这样的预测在几百年前就有过。工业革命时期,纺织工人,特别是卢德分子(the Luddites),曾激烈抗议机器和蒸汽机将会摧毁他们的生计。继而在上世纪20年代(纽约时报1928年某一期的标题称“机器的降临创造了许多闲置的手”)、30年代(约翰·梅纳德·凯恩斯(John Maynard Keynes)在此期间创造了词汇“技术性失业(technological unemployment)”)、40年代(纽约时报称之为“旧议题”的死灰复燃),这种忧虑持续阴魂不散。

随着计算机和机器人开始分别出现在办公室和工厂车间里,约翰·F·肯尼迪 (John F. Kennedy)总统宣称60年代最大的国内挑战是“在自动化正在取代人的同时... 保持100%就业率”。在1964年一群诺贝尔奖得主联手向林登·约翰逊总统提交了一份备忘录,提醒其“计算机和自控机器组合在一起”将引发的革命的危险性。他们称,这场革命,可能会通往生产力的新纪元,人力需求将变得越来越少,整个社会被分化成拥有高技术的精英和无技术的下层阶级。而到了80年代个人计算机的出现则进一步激发了这种面临失业风险的绝望情绪。

然而不可否认的是,从过往来看,新技术总是在毁灭许多旧工作的同时创造出更多新工作。这是由自动化本身的运作方式所导致的,MIT的一个经济学家David Autor如是说。自动化一项工作能提高速度和降低成本,同时也需要更多人类工作者去做一些与之相关且没有被自动化的工作。

从历史上来看,在纺织业有很多例子可以佐证这个观点,波士顿大学法学院的经济学家James Bessen说。在工业革命时期,纺织过程中越来越多的任务可以被自动化,促使工人们致力于做一些机器无法做的事情,比如同时操作几样机器并使他们平稳地运行。带来的结果则是产量的爆发式增长,在19世纪的美国,每个纺织者的单位小时织布量提高了50%,而生产每码布所需要的劳动力则下降了98%。这使得布料更加便宜,对布料的需求也不断增长,进而增加了纺织工人的工作岗位 : 1830到1900年间增长了4倍。换句话说,新技术逐渐改变了纺织工作的本质以及从事这项工作所需的技能,而不是完全取代了它。

在一个更现代的例子中,自动取款机(ATM)曾被认为会给银行柜员带来毁灭性的打击,因为其会接手他们的一些流程化任务,而事实上在美国柜员的平均数量就从1988年的每分行20个下降到了2004年的每分行13个。不过运营一个分行的成本却降低了,这使得银行能够开设更多的分行以满足客户需求。在同一时间段分行的数量上升了43%,所以员工的总数量也上升了。ATM并非摧毁了银行工作,而是改变了银行职员的工作内容,使他们远离那些琐碎的流程化任务,更加专注于销售或者客户服务这些机器没办法做的任务。

同样的模式随着各行各业逐渐引进电脑之后周而复始:与其说自动化令工作消亡,不如说是重新定义了工作,结果则是成本的降低和需求的增长。在最近的一项关于1982年至2012年间的美国劳动力分析中,Bessen发现那些使用计算机频率越高的的职业(比如平面设计),其就业机会的增长也越快,因为自动化加速了工作的某一部分,使得员工能更好的做其他部分。最终在一个行业中使用计算机多的工作取代了使用计算机少的工作。计算机对工作进行了重新洗牌,进而需要让员工学习一些新技能。这一点对于大量的职业都适用,不仅仅是软件开发这类重度依赖计算机的行业,在行政、医疗和其他领域也同样是如此。唯一的例外是在这期间制造业职位增长的速度慢于劳动力增长的速度,但那主要是商业循环和业务外包到中国的缘故,Bessen说。

目前来看,同样的情况似乎在那些应用AI的领域不断上演。举例来说,能够分析大量法律文件的软件可能会导致法律文员和助理失业,因为这些人的主要工作就是在案件的“探索”阶段充当人工搜索引擎;但事实上自动化降低了探索的成本并提高了其需求。Bessen说:”法官们现在更愿意让他们去探寻,因为这种事正变得越来越快捷方便。“在2000到2013年间美国法律文员的数量增长了1.1%。类似地,电子商务和更加精准的推荐系统的盛行,促使人们更多地购物并提高了零售业的总体就业率。Barani说,在放射学界,Enlitic的技术能够强化从业者,将一般的工作者提高到专家级别。新技术并没有使他们失业,而是显著增加了产能,而这可能对发展中国家极有帮助,因为那里往往缺少专家。

人们很容易就能发现,在一些领域自动化可能会显著降低人力需求,然而不那么显而易见的一点是,新技术同样可能会创造新工作。西北大学的经济史学家Joel Mokyr说:“我们无法预测未来会有什么样的工作被创造出来,但这很正常,想象一下告诉一百年前的某个人,他的重孙会成为一个电子游戏设计师或者网络安全顾问,过去没人能预测这些工作的出现。“

类似地,正如今天的人们对于无人驾驶汽车的潜在影响忧心忡忡,一百年前的人们更加担忧从马车转换到汽车的影响。与马有关的工作减少了,但一系列新工作产生了,比如汽车旅馆和服务汽车及卡车司机的快餐行业。而随着这些行业的衰落,新的又将开始繁荣。无人驾驶汽车能使人们有更多时间进行消费,进而刺激经济增长;而自动化的运输工具能使食物之类需要本地配送的产品更易获得,进而其需求也会增长。

Only humans need apply

在AI领域自身也会有一些新工作被创造出来。无人驾驶汽车可能需要远程操作员来协调紧急情况,或者需要搬运工来帮忙敲门和搬运包裹。企业聊天机器人和客户服务AI需要用于训练的对话材料(据说AI公司纷纷在忙着招聘诗人);它们也需要持续的更新和维护,就如同今天的各大网站一样。不管AI变得多么先进,有一部分工作最好还是交给人类去做,主要是那些需要共情和社会互动的工作。医生、治疗师、美发师、个人教练就属于这一类。在咨询公司德勤的一项关于英国劳动力的分析中,重点强调了过去20年间“关怀”类工作的井喷式增长:护士助理、教师助理和医院护理员的数量分别增长了909%、580%、168%。

“仅仅聚焦于工作会被AI取代的人忽视了一个核心经济学原理,那就是自动化会影响劳动力的整体需求”,Autor说,“而这在客观上提升了那些只有人类才能完成的工作的价值。” 他说,那些担心自动化将会导致大规模失业的人都陷入了经济学家所谓的“劳动合成谬误(lump of labour fallacy)”中。这个观点认为所有工作的总量是固定的,如果你自动化了其中一些,那么留给人能做的就变少了,而这是完全错误的。那些言之凿凿的关于技术性失业的警告“基本上都忽略了一点,那就是自动化产生的经济整体反应。” Bessen说。

但这一次会与以往不同吗?正如Ford在Rise of the Robots中指出的那样,自动化带来的影响前所未有的广阔: 在200年前并不是每个行业都被影响了,但如今每个行业都需要使用计算机。在之前的自动化浪潮中,工作者可以从一种流程化工作转换到另一种;但这一次工作者需要从流程化低技能的工作转换到非流程化高技能的工作。在这种背景下,如何帮助员工快速获取新技能已经变得前所未有地重要。然而到目前为止,Autor说, “没有任何证据”证明AI对于工作的影响与以往有什么巨大的不同。更何况尽管人人都在担心AI,更多的国内工人实际上是被海外的廉价劳动力替代了。(译者注:看到这句话我第一个就想到了川普当选的原因。)

另一个不同点是,从农业转向工业往往需要几十年,而软件的部署则要迅速的多。比如Google的Smart Replay,从开发出来到几百万人成为其用户,仅花费了几个月时间。尽管如此,大部分公司仍倾向于缓慢的践行新技术,而这更多地是因为存在一些非技术性的原因。比如Enlitic和其他一些公司主要为医疗领域开发AI,这意味着需要不断地与恶心的政府监管和碎片化的市场环境进行缠斗,尤其是在美国。流程的改变,标准的建立,新技能的学习,这些都需要时间。“发明和实际执行的区别是非常重要的,然而这一点却经常被忽略。”Bessen说。

还有一点令人担心的地方,那就是这些崭新的高科技行业不再是劳动力密集型的了?Frey引用了一篇他去年写的的论文,显示只有0.5%的美国工人就职于2000年后开始兴盛的行业。新技术创造的工作可能会越来越少,因为其大部分都依赖于自动化。一个经常被提及的例子是照片分享app —— Instagram。Instagram于2012年被Facebook以10亿美元收购,当时它有上千万的用户,却只有13名员工。而大约在同一时期,影像巨头柯达公司申请了破产,其鼎盛时期曾雇佣过14.5万员工。然而这样的对比是误导性的,Marc Andreessen说。实际上是智能手机,而不是Instagram,暗中摧毁了柯达,而且在智能手机行业及其周边生态系统中就职的人要远多于曾经就职于柯达公司或者传统摄影行业的人。

Is this time different?

那么究竟谁才是正确的:悲观主义者(其中许多是技术专家)—— 认为这次会与之前不同,机器真的会取代所有人的工作;还是乐观主义者(大部分是经济学家和历史学家)—— 坚持说最终新技术会在毁灭旧工作的同时创造出更多新工作?事实真相可能介于二者之间。AI不会导致大规模失业,但会加速目前的计算机自动化趋势,并像从前的技术变革那样对劳动力市场产生破坏性的影响,同时更要求工作者快速地学习新技能。Bessen预测这将是一个“艰难的转变”,而不是“与历史的快速决裂”。但尽管存在各方观点,基本上所有人都认同一个应对方法:企业和政府应该让工作者更加方便地获得新技能和转换工作岗位。只有这样我们才能更好地应对可能的最坏的情况 —— 即悲观主义者被证明是正确的,AI最终产生的影响比乐观主义者预计的要剧烈地多。

Education and policy

Re-educating Rita

2011年7月,斯坦福大学教授Sebastian Thrun在YouTube上发布了一个短视频,宣布他和他的同事Peter Norvig,已将他们的课程“人工智能导论(Introduction to Artificial Intelligence)”在网上免费开放。到了10月课程正式开始时,已有来自190个国家的16万人报名参加了该课程。在同一时间,同为斯坦福大学教授的吴恩达也将他的一门关于机器学习的课程在网上免费开放,总计10万人参加。这两个课程都持续了10周。最终23000人完成了Thrun的课程,13000人完成了吴恩达的课程。

这类在线课程,包含短视频、学生讨论板块、自动作业评分系统等元素,最终演变成了现在为人所熟知的“大型开放式网络课程(Massive Open Online Courses,MOOCs)。2012年Thrun创办了一家名为Udacity的在线教育公司,而吴恩达则联合创办了Coursea。同年哈佛大学和MIT共同成立了edX,一个非盈利MOOC提供组织,由MIT的人工智能实验室首脑Anant Agarwal领衔。当时甚至有人认为MOOCs会取代传统的大学教育。但自那以后,关于MOOC最初的喧嚣却渐渐平静了下来(虽然仍有数百万的学生曾参加过某种形式的在线课程)。尽管如此,MOOC的这股热潮彰显了在线教育的巨大潜力,以这种袖珍课程的模式。

事实上Udacity,Coursera和edX都发端于AI领域凸显了AI圈子里的一个普遍看法,那就是教育体系需要彻底的改造。Thrun说他将Udacity视作“正在上演的AI革命的处方”,因为在此环境中工作者需要在其职业生涯内不断获取新技能。类似地,吴恩达认为既然他们的工作可能对劳动力市场造成巨大的影响,AI研究者们“在道义上有责任来站出来解决自己酿成的问题”;他说,Coursera就是他的相应贡献。此外,AI技术在教育上有着巨大的潜力。“适应性学习(Adaptive Learning)” —— 一种能够根据每个学生的具体情况定制课程、以其最易理解的方式展示概念、并让其按自己的步伐学习的软件 —— 已经被提出来好几年了。然而新的机器学习技术可能使其最终得以实现。

Adapt and survive

目前来看,适应性学习技术主要适用于大量学生学习同一材料的情景,这样可以采集大量数据,吴恩达说。Geekie —— 一家来自于巴西的适应性学习创业公司,运用巴西几千所学校的教学大纲来指导学生。该领域的其他创业公司包括:Knewton,Smart Sparrowand和DreamBox。教育界巨头同样在紧盯这个市场。比如McGraw-Hill于2013年收购了另一个适应性学习系统ALEKS; Pearson最近宣布了与KnewTon的进一步合作。在二月的一份报告中,Pearson称AI可以使学习“更个性化、弹性化、具包容性和趣味性”。这样的系统不会取代教师,但能帮助他们成为良师益友而不仅仅是个讲课的。

甚至在人工智能领域之外,也存在广泛的共识认为技术性的进步尤其是人工智能,将导致教育界的巨大变革,正如19世纪的工业革命那样。当时因为工厂工作数量逐渐超越了农业工作,读写与算术能力变得重要起来。雇主们意识到受教育程度更高的工人产出也更高,但却因为害怕工人们跳槽所以不愿意给他们培训。这促使了全面国家教育体系的引入,创办了很多能给工人提供合适教育的学校。工业化不仅改变了教育的具体需求,也建立起了新的教育模式。同样人工智能的崛起可能会带来类似的结果,旧有的教育模式会被改革,而适应性学习可能是使其成为现实的的途径之一。

“旧系统需要彻底的整改,”西北大学的Joel Mokyr说。他指出,自1945年以来,教育系统就一直致力于专业化教育,所以学生们在一个狭小的领域里越学越多。随着知识过期的速度越来越快,未来最重要的将是学习如何重新学习,而不是学会只在一件事情上做得很好。Mokyr认为目前的教育把人视作黏土 —— “捏几下,烤几下,然后就永远不变了”。在未来,随着越来越多的工作受到自动化的影响,留给人类能做的工作将不断改变。吴恩达说:“你需要一辈子不断学习,从长远来看这一点已经是再明显不过了。在大学里所学的不足以让你在后40年持续保持竞争力”。

教育将与全职工作交织在一起。“人们需要不断学习新技能以跟上时代的步伐。”Thrun说。因此他的公司提供“纳米学位(nano-degrees)”,仅需数月就能完成,可以半工半读。学习一个纳米学位,比如数据科学或网站编程,每月需要花费200美元,但若学生能在12个月内完成课程则会获得50%的返还款。目前许多网站都提供各种各样的课程,涉及客户体验设计到项目管理到领导力。一些网站比如Udacity是按课程收费;其他的比如商业社交网站LinkedIn旗下的Lynda.com,则每月付费进而获得所有课程权限。很多时候用户和他们的潜在雇主很难分辨这么多课程里面哪些课程对他们最有价值,因此政府、课程提供者和雇主之间需要进一步合作来改善这个局面。

美国和其他发达国家同样应该加重职业和技术教育的力度,就像德国那样,而不是鼓励每个人都一窝蜂去上大学,MIT的David Autor说。但这并不意味着更多的包含五到七年训练期的学徒制。“如果你需要的技能每三到五年就会变,这种制度就没有任何意义,”波士顿法学院的James Bessen说。社区大学同样在建立各种各样的方案,将教育和工作中的学习结合起来。

随着工作中所需的技能转瞬即逝,具有坚实的读写和数字能力将变得更加重要。然而传授“软技能”的重要性同样越来越高。在2013年发表的一篇论文中,美国国家经济研究局的James Heckman和Tim Kautz提出更多的重点应该放在“性格技能(character skills)”上,比如毅力、社交能力和好奇心这些雇主非常看重的品质,而这些素质同样与工作者的适应能力和学习能力高度相关。他们说,性格是一项技能,而不仅仅是特征,对该技能的培训无疑是影响长远的。

Basic attraction

对于AI和自动化的忧虑同样引发了一些呼吁,主要是关于建立一个安全网络保护人们免受劳动力市场瓦解的影响,并帮助他们找到新工作。特别地,很多AI评论者都支持实行全球基本收入的想法:这是一种对现行福利系统的极大简化,每个人,不管什么情况,都会得到固定数额的钱(比如每年10000美元),除此之外再无其他福利金。在工业革命时期Thomas Paine和John Stuart Mill以及其他一些人都宣扬过类似的观点。那些预测大部分工作都将消失的人认为这种体系可以维持消费经济运转并给没有工作的人群提供支持。因为如果大部分工作都被自动化了,社会需要另一种机制来重新分配财富。

想要全面整改教育系统是非常复杂的,而与之相比,基本收入制度似乎提供了一个更简单、有吸引力和易于理解的解决方案。这个想法得到了科技行业界的广泛支持:Y Combinator,一家创业孵化器(译者注:指为创业者提供培训和指导的公司),甚至在资助一项关于该想法的研究,地点位于加州奥克兰市。Y Combinator的总裁Sam Altman认为在这样一个技术飞速变化的世界,基本收入有助于确保“向未来工作的平稳过渡”。这种想法似乎更受技术控的青睐,部分是因为他们喜好简洁和优雅(对比来看,如今的福利和税务系统则像是写得很糟糕的程序代码,而且只写了一行),部分则是因为他们的乌托邦主义。而从一个更加阴暗的角度来看,人们对于科技造成的破坏和不平等怨恨已久,而这种制度有助于进一步激发人们的不满,这样极客们就能在创造未来的道路上畅通无阻。不过Altman说他接触过的那些支持基本收入的技术控基本上是出于“完全慈善性的原因”。(译者注: 这算是《经济学人》的冷幽默么。)

尽管这大体上是个吸引人的想法,但魔鬼却暗藏于细节中。用全球基本收入制度取代现行的福利预算体系将是一种大幅度的退步。如果将现在所有的社会救济金、养老金和福利金(不包含医保)平均分配,在美国平均每人每年会得到大约6000美元的基本收入,在英国则是6200美元(以相同的购买力计算)。与现行的福利体系相比,这种制度会减少穷人的收入,而富人则觉得这些钱很鸡肋。然而若先对个人经济情况进行调查再决定其收入金额,则会使这种制度丧失简洁性,本来很低的行政成本也会相应增加。如果要确保基本收入能维持比较好的生活水平,无疑税收将比现在大幅提高。而像负所得税(negative income tax)或者劳动所得税扣抵制(earned-income tax credits)这样的制度,虽然不那么优雅,但却更实际。

许多国家,特别是芬兰和荷兰,正在计划于明年实验一定程度的基本收入制。经济学家们对此的一大顾虑是基本收入可能会让一些人失去进一步进修的动力,甚至是不想再工作了 —— 为什么不整天玩游戏呢?—— 尽管之前的研究显示人们拿到基本收入后只是稍许减少了工作时间,而不是完全放弃了工作。另一个问题则是边境开放和自由移民会对基本收入制产生不利的影响;如果不对移民或所得权益进行限制,可能会吸引大量吃白食者涌入国内,并造成国内纳税人纷纷逃离出去。

这预示了另一个亟待政策制定者解决的领域:自动化带来的地缘政治影响,即某些国家的人会比其他国家的人获益更多。Autor说,自动化对于发展中国家的影响要比发达国家大得多,因为前者所提供的基本上都是廉价劳动力:比如低薪工人生产的便宜商品,呼叫中心之类的廉价服务,或者在工地上搬砖。如果自动化使发达国家在这些领域更加自给自足,那么它们对发展中国家产品和服务的需求就会减少,进而导致发展中国家的出口和发展速度减缓。所以自动化可能会逐渐“侵蚀发展中世界的比较优势(comparative advantage)”。另一个问题则是发达国家坐拥机器人和AI的技术与专利,并能从中获益良多。而对于发展中国家来说,如果机器最终在大量的领域中都表现优于人类,那么与发达国家之间进行AI相关的交易将变得异常艰难。

自动化带来的风险是其可能剥夺贫穷国家通过工业化促进经济发展的机会。经济学家们都在谈论“过早地去工业化(premature deindustrialisation)”;哈佛大学的Dani Rodrik指出一战爆发前不久英国的制造业工作者最高占比45%,而现在巴西、印度和中国的制造业工作者数量已经到达了顶峰,比例却不到总人口的15%。这是因为制造业比过去自动化程度高多了。根据花旗银行的报告,中国最近取代了美国成为最大的工业自动化市场。工业自动化可能意味着其他的一些新兴经济体,比如非洲和南美洲的一些国家,更加难以通过从农业向工业转化来促进经济增长,进而不得不寻求新的增长模式。Tyler Cowen认为,如果没有制造业工作作为中产阶级形成的根基,这些国家的“核心经济结构中可能会嵌入极大的收入不平等”。

在工业革命时期,John Stuart Mill写道:“立法者应当更加关注那些生计被机器破坏的人,除此以外再去特别关注其他事情都是不合常理的”。现如今大多是发达国家比较关注自动化对于教育、福利制度和经济发展的影响。但是发展中国家的政策制定者有朝一日同样将不得不面对这个问题。

Ethics

Frankenstein’s paperclips

如果是像《DOOMSDAY SCENARIOS》里的情景,那听上去也没那么可怕。牛津大学的一位哲学家Nick Bostrom提出过一个名为“回形针极大化(paperclip maximizer)”的思维实验。他说,想象一个人工智能体,决定收集尽可能多的回形针。它用尽一切办法来获取回形针,并不断自我进化以发掘新的获取回形针的方式,并抵制任何会偏离其目标的意图。最终它会“先后把整个地球和部分太空都转化为回形针制造工厂”。这个看上去非常可笑的情景实际上是为了揭示一个严肃的观点,即AI们不见得会拥有和人类一样的意欲和心理。它们可能不会犯一些人类易犯的错误,但却可能会犯其他类型的错误,比如疯狂收集回形针。尽管它们的目标刚开始看上去无伤大雅,但若AI能够自我复制并不断进化,那将是危险的。就算是一个“被囚禁的超人工智能”,虽然只能在一台被隔离的计算机上运行,仍可能会劝说它的人类操作者给它自由。Bostrom表示,对人类来说先进的AI不仅仅是一项新技术,更可能会扮演毁灭者的角色。

机器会反噬自己的创造者,这类场景可以追溯到 Mary Shelley的《弗兰肯斯坦(Frankenstein)》(1818年)或者更久以前;而AI通过不断自我进化达到“智能爆炸(intelligence explosion)”,这个概念最早于1965年就被提出过。然而AI领域最近的飞速发展又引发了新的忧虑,Bostrom已经成为了AI威胁论的知名倡导者,但他更倾向于称之为“超级智能(superintelligence)”,这同样是其畅销书的书名。

他对于AI的兴趣来源于其对人类存在性威胁的研究。与大规模流行病、小行星撞击或超级火山喷发不同,人类可以在某种程度上控制超级智能危机。Bostrom的书促使Elon Musk宣称AI“可能比核武器更加危险”。物理学家Stephen Hawking和英国皇家学会前首脑Lord Rees同样表达了类似观点。这三人以及其他一些AI社区的人共同签署了一封公开信,要求相关研究应保证AI系统“稳健和有利” —— 也就是说AI不会变得邪恶。很少有人会不同意AI需要往有利于人类的方向发展,但关于如何实现这个目标却很难达成共识。

Musk认为开放性是关键。他和其他一些人于2015年12月联合创办了OpenAI公司,融资10亿美元,而且OpenAI作为一家非盈利人工智能研究机构,会将其所有项目开源。Musk说:“我们认为AI会对未来的文明产生巨大的影响,所以我们尽可能采取一切措施使AI往好的方向发展。”在他看来,AI技术应该被广为应用。科幻作品中的邪恶AI,比如《2001太空漫游》里的HAL和《终结者》里的SKYNET,都是巨大的集中型机器,因而一旦变坏后果就很严重。而一种更加分散的模式则会使AI的好处遍及所有人,而且就算是其中一个AI变坏了也不会产生严重的后果,Musk如此论证道。

然而并非每个人都这么认为。一些人声称Musk的真正顾虑是市场集中化 —— 比如Facebook或Google在AI领域形成的垄断,而Musk则对此嗤之以鼻。目前Google,Facebook和其他公司都争先恐后地将它们的AI源代码和研究项目在网上免费开放。另一方面,Bostrom却不认为将AI技术广为散布是件好事。在最近的一篇论文中他指出多个AI的存在“不能保证它们会按人类的利益行事或保持受人类控制”,相反,这种不断增生可能会使技术更难控制和监管。

处在AI研究最前沿的人普遍不认为AI会变得邪恶。DeepMind的Demis Hassabis说:“大量危言耸听的言论都来自于一些外行,所以他们想到的大多是些科幻场景。我不认为使用非常情绪化的字眼会对现在的形势产生什么帮助,那样只会引起不必要的恐慌”。Hassabis认为“回形针场景”非常地不现实,但不否认Bostrom强调AI动机问题的合理性。他说,这是一个有趣的研究问题,关于如何给AI设定正确的目标和价值观,并让它们一直保持下去。2009年在加州阿西洛马召开的AI专家会议同样将AI安全性视作研究的一个方面,但并非首要考量因素。从另一层面来看,这个会议召开的地点意义重大,因为在1975年正是生物学家们聚集于此起草了自愿性准则以确保DNA重组技术的安全性。

Sci-fi scenarios

Bostrom对此的回应是“一些AI研究者事实上和他有着同样的顾虑”,但同时也强调他仅仅是在意AI可能引发的潜在风险,而非宣称目前的AI已经很危险了。吴恩达则反驳说担忧今天的人工智能 —— ”就像是担忧火星上的人口爆炸,特别是考虑到目前还没人登上过火星”。这显然是对Musk的嘲讽,因为Musk在对AI大放厥词之前,一直努力追求在火星上殖民,他将这视为地球被毁灭后人类的新去处。Marc Andreessen说,AI让人们感到害怕的主要原因是其结合了两种由来已久的恐惧:卢德分子(the Luddite)害怕机器会取代所有工作,以及弗兰肯斯坦情结(the Frankenstein scenario)认为AI某一天会突然“觉醒”并一发不可收拾。几十年来这两种心理一直来来回回阴魂不散。在这期间诸多科幻小说同样制造了了某种具象化的恐惧,而相比之下诸如气候剧变这类对人类威胁性大得多的问题,则渐渐被淡忘。

AI研究者指出AI——至少目前阶段的的AI——其危险性是被过分夸大了,并列出了几个技术层面的理由。首先,吴恩达说,“智能”和“知性”以及“意识”都不是一码事,尽管这三个概念经常被混用。在IBM研究AI伦理学的Francesca Rossi说,认为机器“某一天醒来之后会突然性情大变”,这是根本不现实的。其次,“智能爆炸”也被认为是不大可能的,因为这需要AI不断缩短新版本的升级时间。然而大部分的计算问题,即使是那些比设计AI简单得多的问题,在加大规模后也要耗费更多的运算时间。

第三,尽管机器可以从过去的经验和环境中学习,这并不意味着它们无时无刻不在学习。比如一辆自动驾驶汽车,不会每上一次马路就将自己重新训练一遍。相反,深度学习系统有一个训练期,主要通过调节神经网络的参数并建立模型来执行特定任务。这是一个需要大量运算的过程,通常要在计算机上跑好几天。训练好的模型被部署到一个实地系统中,使得深度学习模型能被用于无人车、无人机、app和其他产品。但是这些无人车、无人机不会在野外擅自自己学习。它们在外执行任务时收集到的数据会被传回来用于改进模型,随后训练好的新模型会被重新部署到系统中。所以一个个体系统不会在特定环境下“学坏”,因为在那个时候它根本没有学习的心思。

The black-box problem

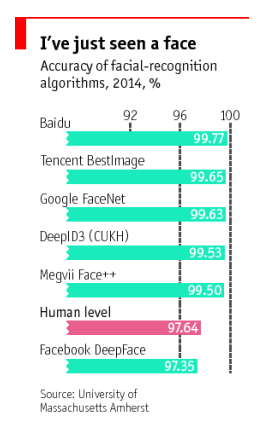

人们普遍担忧在未来AI会变得邪恶,然而AI技术引发的一些近在咫尺的道德和监管难题却越来越受到忽视,这其中的例子就有:基于深度学习的人脸识别技术能极大强化监控系统。Google的FaceNet系统可以辨别两张图片是否显示是同一人,准确率高达99.6%(人类水平约为98%)。Facebook的DeepFace系统准确率也差不多,社交网络巨头最近发布了一个名为Moments的app,能自动收集同一个人的照片,但为了避免违反隐私法,其不得不在欧洲禁用一些人脸识别功能。

与此同时,在俄罗斯一款名为FindFace的app所引起的抗议正愈演愈烈,通过这款app,用户在拍下陌生人照片后可以匹配其社交网络上的个人头像,进而获取身份信息。app的开发者称,这只是一个让那些在街上或酒吧里擦肩而过的人们重获联系的新方式。俄罗斯警方则已经开始使用它来识别嫌疑犯和证人。这其中的暗示已经很明显了 —— 公共匿名性的终结(the end of public anonymity)。一旦有游行或抗议爆发,从几百米之外拍摄的超高像素照片,就能从人群中分析出是谁参与了这些活动,即使过了很多年之后也照样能被发现。实际上,深度学习已经打消了一切想要参加一个集会后不留下任何记录的想法,除非你准备直接戴个面具。一家日本公司正开始售卖一种看上去非常搞笑的护目镜,能用来阻隔人脸识别系统。

因具有模式识别和聚类相似实例的能力,所以深度学习可以被用来打击犯罪。然而很多极权政府同样可以运用深度学习分析人们的社交媒体档案,进而识别谁可能是异见份子,斯坦福法学院的AI伦理学专家Patrick Lin说。与此同时,美国加州警方一直在测试一个名为“Beware”的系统,该系统通过分析警方文件、资产记录和社交发帖来评估一个嫌疑犯的危险性。另一个名为“COMPAS”的系统,通过预测罪犯再次作案的可能性,为该罪犯的判刑提供参考。Patrick Lin说,这些系统在得到深度学习的助推后,将极大挑战“法律正当程序(due process)”这一基本理念。

另一个与之相关的隐患是,随着机器学习系统被嵌入越来越多的商业流程,它们可能会对特定类人群差别对待。在一个臭名昭著的例子中,Google不得不为其app中的自动标记系统公开道歉,因为黑人在该系统中被标为“大猩猩”。“COMPAS”则曾被指控歧视黑人。AI技术正变得与人们的生活息息相关,因此保证它不含偏见是非常重要的。虽说没人会将AI系统预先设定为种族歧视者,但如果输入垃圾数据进行训练,预测结果就会很糟。于是渐渐地,AI的发展不仅关乎增强智力,也关乎道德和决策考量。Patrick Lin说:“AI的考量过程实际上像是个黑盒子。”

幸运的是,目前有办法可以观测这些黑盒子的内部并知晓它们的决策过程。比如一个图像处理神经网络,可以将输入层图片中对最终决策影响最大的区域标记出来。许多研究者正在开发各种各样被称为“规则提取(rule extraction)”的技术,这些技术旨在让神经网络解释其推理过程。毫无疑问,对这个问题关注最密切的领域就是 —— 无人驾驶汽车。

当然除此以外这些无人车也会遭遇其他一些道德难题,尤其是紧急情况下该如何行动。举例来说,无人车应该冒车内人受伤的风险去避免撞一个快步跑到其面前的儿童吗?Hassabis说,该由谁为一场交通事故负责、需要做多少测试、如何设定标准,这些都已不再是理论上的问题了,而是现在就应该讨论。吴恩达则从另一个角度看待这个问题,认为AI研究者在道义上有义务尽快制造出无人驾驶汽车以拯救生命:世界上平均每天的车祸死亡人数为3000人,而大部分是由于司机的个人失误造成的。但就算是无人车要安全得多,态度仍然需要转变。人们似乎能容忍人类司机造成的道路死亡,但对机器却要严苛得多。“在我们心目中机器的比较对象是完美主义,而不是做同样事情的人类。”牛津大学的经济学家Daniel Susskind说。

(译者注:这种情况下AI反而更有优势,因为可以精确计算并做出最优的方向盘和油门刹车操控以把损失降到最小,而相比之下人类司机碰到这种情况能保持冷静就已经很不错了。)

Killer app

许多人担忧AI的军事用途,尤其是那些不需要人类干预就能直接决定生死的自主性武器。蒙特利尔大学的Yoshua Bengio说他想对AI军事化施以“彻底的禁令”。性命攸关的决策应由人类作出,而非机器 —— 最大的原因是机器无法在事后被追究责任。Hassabis也认同这个观点,当Google收购他的公司时,他坚持要Google保证自己的技术不会被用于军事上。他和Bengio共同签署了一封公开信,要求禁止研发“攻击性自主武器”。而Ronald Arkin则认为事实上运用AI的军事机器人可能在道德判断上强于人类士兵;毕竟它们不会强奸、掠夺或者在重压之下做出错误判断。

Hassabis的另一个想法,是在DeepMind成立一个AI伦理委员会,其中包括一些独立审查者(不过他因拒绝透露成员姓名而被外界抨击)。虽然AI公司普遍不认同那些危言耸听者的观点,但对它们来说,对外展现出它们至少考虑过其中的一些问题,并在外界对它们正式实施监管之前先一步参与其中,这不失为明智的举动。然而AI界貌似不大可能最终建立起自己独立的监管机构,类似于美国联邦航空管理局(Federal Aviation Authority )或美国食品和药物管理局(Food and Drug Administration)那样,只因其应用范围实在太广了。最有可能的情况是AI将会促使现有的法律重新修订,而非重新起草通过一些新法案。史上最著名的AI系统管理规则,自然是非艾萨克·阿西莫夫作品中的“机器人三定律”莫属。这些故事有趣的地方在于,机器人时常在出人意料的地方出现问题,仅仅是因为很多时候三定律并不适用于实际情况。然而不久之后,就到了人类不得不真正敲定一些普适性法则的时候了。

Conclusion

Answering the machinery question

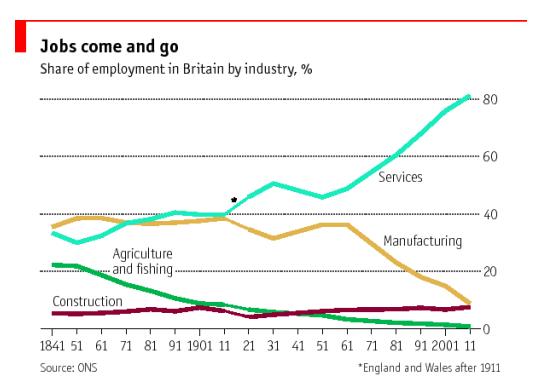

原初的“机器问题”,在当时看上去是如此重要和紧迫,最终却自我解决了。尽管David Ricardo和其他一些人都提出过“用机器取代人力可能会导致人口冗余”这样的观点,机械化的整体影响却是前所未有的新工作井喷式增长。机器提高了单个工人的产量,降低了许多商品的价格,拉动了内需并加大了工人的总需求量。随着企业的发展壮大,也会需要经理、会计和其他员工。而随着铁路、电报、电气的到来,崭新的、前所未见的行业开始兴起。

不过可以肯定的是,这一切都需要时间。工业化将劳动力市场的剧变渗透进了社会的方方面面,一些工作消失了,一些变得面目全非,全新的工作则开始显现。工厂的整体情况已然相当严峻,直到几十年后经济的发展才反映在工人工资水平的大幅提高上 —— 这种延迟现象如今被称为“恩格斯停滞(Engels’ pause)”。

对失业的忧虑逐渐让位于就业环境这样一个更广阔的话题,促使了社会主义和共产主义的崛起,并激发了现代工人运动。到了19世纪末机器问题已变得鲜有人关注,因为在那个时候答案已经很明显了。1896年美国经济学家Arthur Hadley清晰地表达了当时的普遍观点:“机械化并没有摧毁工作,而是带动了就业机会的显著增长,特别是那些机械化进步最大的领域。“

所有这些过往事件能给今天的我们带来什么启示?与历史作类比从来都不可能完美,但却能得到很多信息。如今人工智能引发了多种忧虑,很多都与200年前人们对于机械化的恐惧如出一辙。19世纪工业化的经验显示:工作会被重新定义,而不是被摧毁;新兴行业会涌现;娱乐活动会更新;教育和福利体系会变革;地缘政治和政府监管也会随之而产生变化。

从许多方面来看,关于AI的两大争议 —— 是否会毁灭工作,是否会毁灭人类 —— 其实都取决于变化的速率。如果你认为AI的发展速度太快以至于人类水平的通用人工智能[artificial general intelligence (AGI) ]已经是近在眼前了,那你更可能会担忧突然爆发的大范围失业以及技术突然失控的可能性。然而概率更高的情况是,AI会逐渐进步,而其对后十年二十年的影响,纵使很大,也不能和农耕经济转为工业经济的划时代转变相提并论。

AGI可能还在千里之外,甚至更远,所以关于它可能做什么不可能做什么,以及社会该如何应对,还完全处于理论上的假设。因此本篇专题报告着力于聚焦AI近期产生的实际影响。计算机在工作和日常生活中的应用将越来越广泛和活跃,而与之对应的是,人们需要比从前更快速和高频地更新自己的技能。只要教育系统得到升级并变得更加灵活(这已经开始发生了),这一切都是完全可行的。

到目前为止,关于人工智能的讨论主要集中于一些悲观的未来预期,比如大规模失业和邪恶AI。而一些比较乐观的场景,如AI能大幅促进世界往好的方向发展,则鲜有人问津。所以这里列举三个例子。第一,AI能够改变运输业和都市生活,而这首先要归功于无人驾驶汽车。能够随时随地叫车将会降低汽车的整体需求,大幅减少道路上的车辆数量,以及消除车祸事故。伴随而来的是污染的降低,以及原先被停车场占据的区域被重新用于建设公园、住宅和人行道路,而这一切都将使城市环境焕然一新。

第二,不久以后AI就能使人们与一系列事物进行对话:如他们的车和房等,就如同“星际迷航(Star Trek)”中人类与虚拟计算机对话一样,而且未来还可能会出现AI顾问和AI导师。很多AI驱动的个人助理,如 Alexa, Cortana, Siri和Viv等,已经在争相扮演这类角色,并且可能成为与计算机交互和获取信息的重要新型模式,就像之前的网络浏览器和触摸屏一样。然而语音并非总是与计算机交互的最佳途径,所以对话经常会与图像相结合(可能会以“增强现实(augmented reality)”的形式)。AI同样有巨大的潜力促进人类之间的相互交流,这主要是通过实时翻译各种不同的语言。这项技术的雏形现今就已存在,而在将来则会变得更好。

第三,AI能够极大加速科学和医学研究。“最让我兴奋的一点是AI能帮助加速科学创新。”,DeepMind的Demis Hassabis说。在各个领域,从癌症研究到气候变化,AI都可以扮演一个永不停歇的研究助理来帮助解决问题,通过筛选数据、阅读海量科学论文、提出值得进一步研究的科学假设等等。IBM已经开始布局这个领域,运用其Waston AI技术分析大量医学数据。与此同时深度学习将被用于分析来自“100,000 Genomes”项目的数据,该项目目前由英国的国民医疗服务体系(National Health Service)主导;而同样的技术也能帮助物理学家们分析粒子对撞机中产生的海量数据,以期获得新发现。

人们之前对AI多年来的龟速进展大失所望,然而讽刺的是,现在很多人却认为它发展地太快了。本篇文章在冷静客观地评估后得出结论,人们应该欢迎AI,而不是恐惧它。在19 世纪 40 年代,约翰·斯图尔特·密尔( John Stuart Mill )写道,“机械的出现会最终给体力劳动者带来巨大的好处,如果站在未来回望过去的话,这将被证明是毋庸置疑的。”一位未来的经济学家可能会对AI持同样的观点,但与此前不同的是,AI带来的好处将遍及世界上每一个人。