机器学习-基础算法最小二乘回归

线性回归——最小二乘回归

统计回归方法之一,通过最小化误差的平方进行最佳匹配。

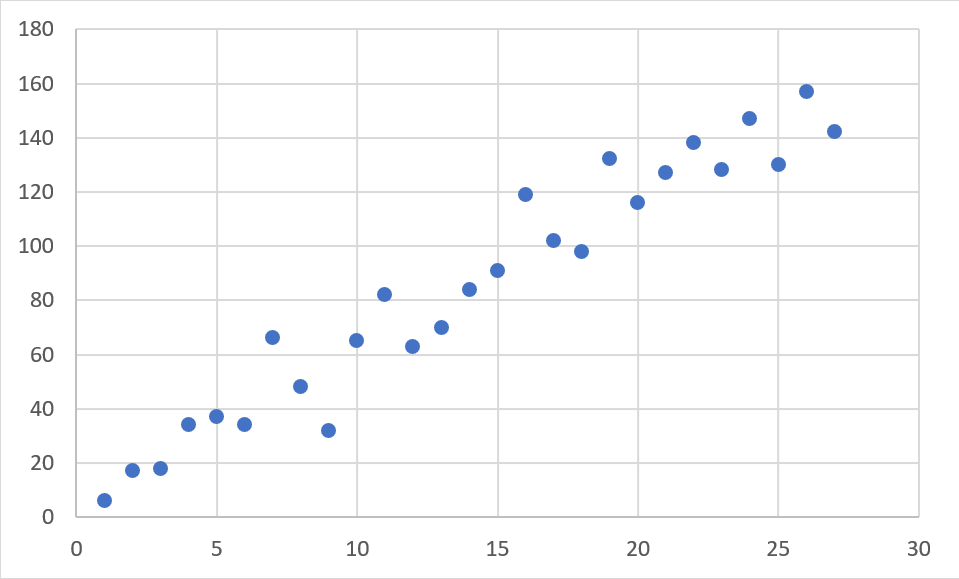

如图

设一元线性函数为y=a0+a1x

则有y'=a0+a1x+ε,其中y为真实值,y‘为预测值,a0为截距,a1为斜率,ε为误差

![]()

若使真实值与预测值相差最小,即使∑ε最小,有min∑ε

这里我们考虑如下情况:

若y=1 y'=2;y=2 y'=1 则有∑ε=0

发现ε存在正负值,需要进行处理,在此我们先考虑加绝对值

加上绝对值后确实解决了上述问题,但是面临另一个问题即去掉绝对值相对麻烦

我们考虑平方,为减少计算量,二次方即可。

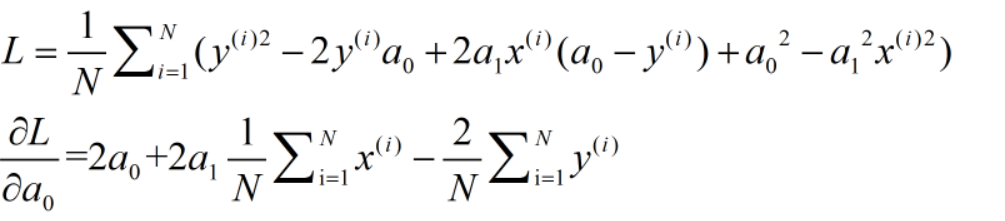

即有:

![]() 需要求解在L最小情况下的 a0、a1,即分别对 a0、a1求解偏导令偏导函数为0,求解a0、a1。

需要求解在L最小情况下的 a0、a1,即分别对 a0、a1求解偏导令偏导函数为0,求解a0、a1。

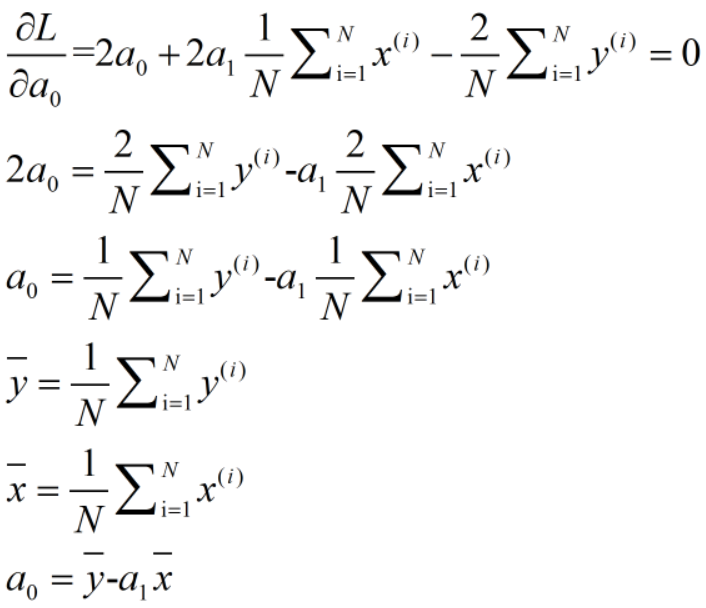

对a0求偏导,有:

对a1求偏导,有:

令a0偏导为0,有:

令a0偏导为0,有:

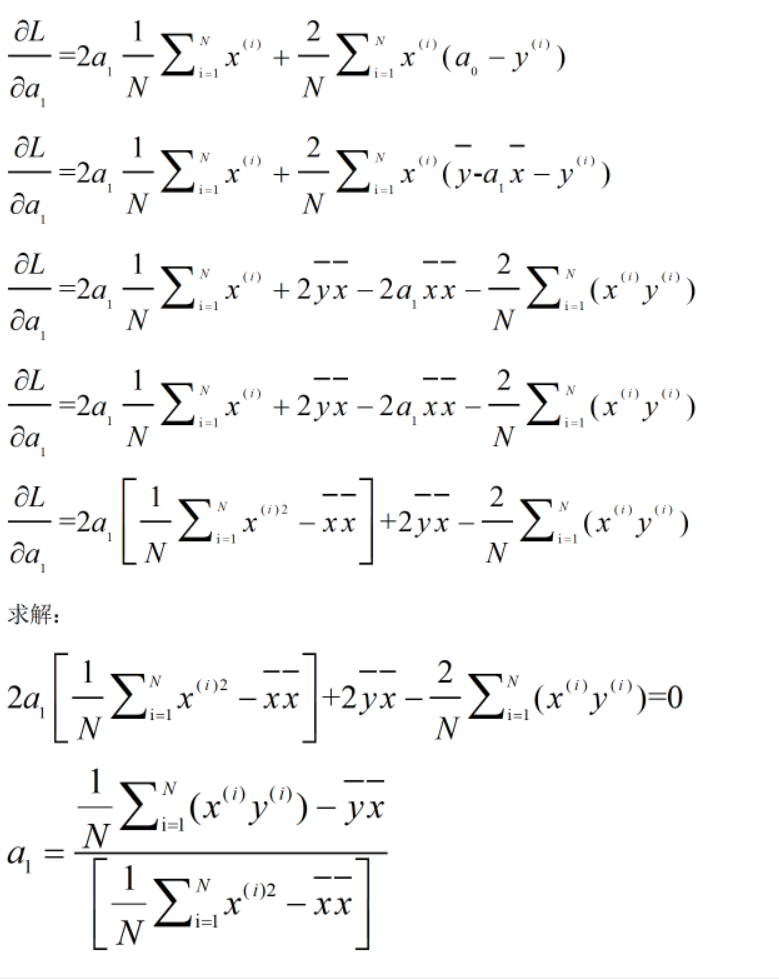

令a1偏导为0,有:

令a1偏导为0,有:

由此,我们可知在L最小时:

回归学习最常用的损失函数是平方损失函数,因此最小二乘回归使解决问题的常用且有效算法。